Moteurs IA publics vs privés : comparatif & optimiser en 2025

Comparatif 2025 des moteurs de recherche IA publics vs privés : audience, données, sécurité, UX, optimisation et outils de mesure (Geneo inclus) pour choisir et performer.

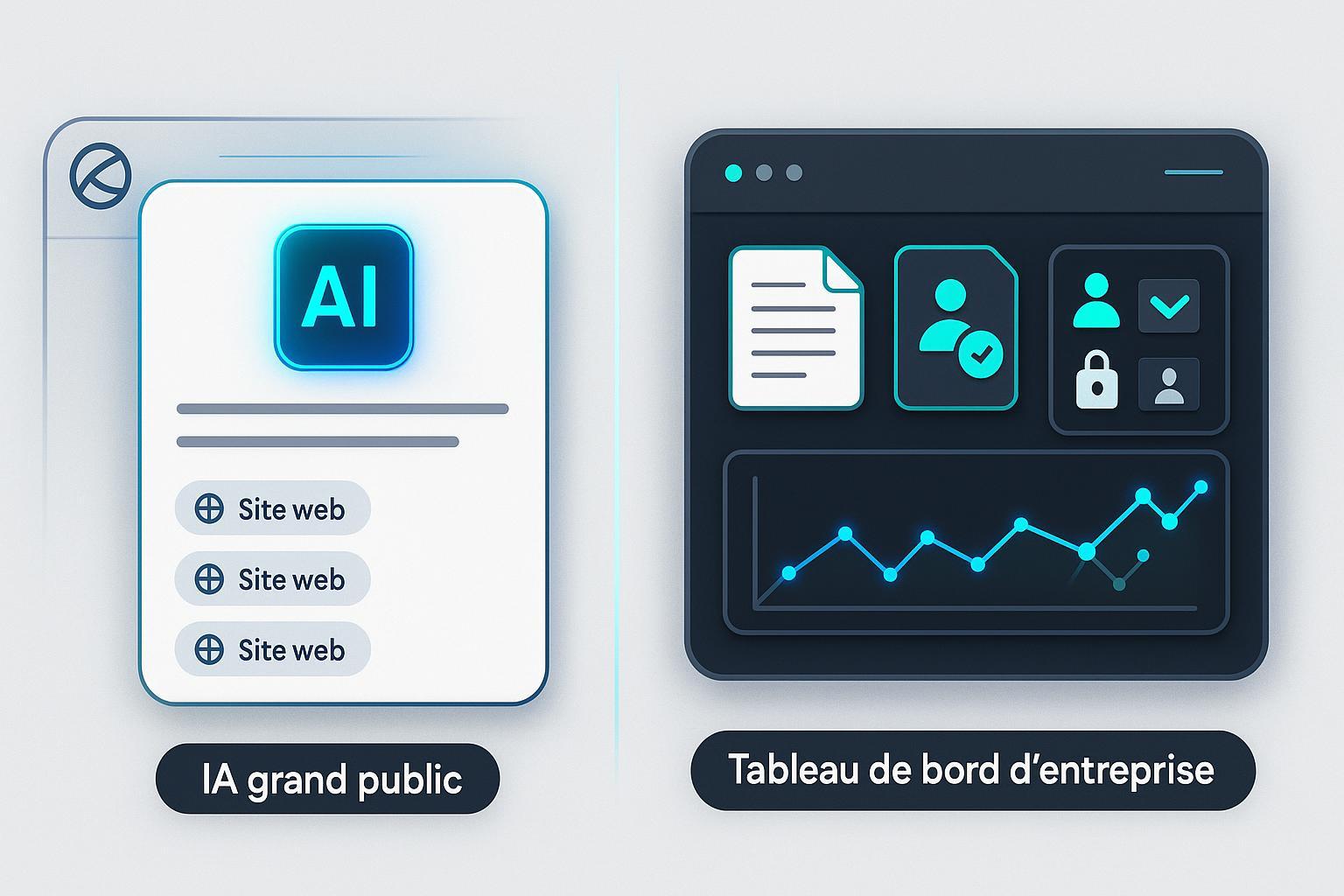

En 2025, la frontière entre « recherche » et « réponse » s’estompe. Les moteurs IA grand public synthétisent le Web avec citations, tandis que la recherche d’entreprise (privée) s’appuie sur RAG et permissions pour servir des réponses contextualisées aux collaborateurs. Comprendre cette dichotomie n’est pas théorique : elle conditionne vos tactiques d’optimisation, vos KPIs, et la manière de piloter marque, trafic et productivité.

- Selon le billet produit de Google de mai 2025, AI Mode découpe les requêtes complexes et met en avant des liens dans les AI Overviews, que Google affirme « obtenir plus de clics » que s’ils figuraient en résultats classiques, une affirmation à remettre en perspective avec vos données internes et tests A/B, cf. Google — mise à jour AI Mode (mai 2025).

- Plusieurs analyses 2024–2025 constatent néanmoins une compression du CTR organique lorsque des résumés IA s’affichent, avec des baisses de 18 % à 64 % selon thématiques, et une progression du « zero‑click » sur un an, cf. Similarweb — évolution du zero‑click 2024–2025 et Search Engine Land — chute du CTR organique (2024).

Objectif de cet article : poser un cadre clair « public vs privé », fournir des playbooks d’optimisation adaptés, et proposer un cadre de mesure pragmatique.

Public vs privé : définitions rapides et exemples (2025)

- Moteurs IA publics (grand public) : plateformes de réponse synthétique qui citent des sources Web. Exemples : Google AI Overviews/AI Mode, Perplexity, Bing Copilot/ChatGPT Search, Brave, You.com. Voir la présentation officielle de Google — AI Mode (2025) et l’aperçu de Microsoft — Copilot/Bing.

- Moteurs IA privés (entreprise/interne) : recherche sémantique et assistants RAG sur données internes avec respect des permissions (RBAC/ABAC) et exigences de conformité. Exemples : Microsoft Copilot pour M365/Graph, Glean, Coveo, Elastic AI Search, Amazon Kendra, IBM watsonx Discovery. Voir les pages techniques de Microsoft Graph — aperçu, Elastic — recherche vectorielle, AWS — Kendra et IBM — évaluation & analytics Discovery.

Matrice comparative essentielle

-

Audience et objectif

- Public : atteindre des utilisateurs finaux, capter l’attention et la demande; objectifs de notoriété, considération, trafic et conversions.

- Privé : servir collaborateurs/équipes; objectifs de productivité, support, prise de décision, réduction du temps de recherche, conformité.

-

Sources de données

- Public : Web ouvert, signaux d’autorité, contenus multimédias (YouTube, Reddit, docs officiels), fraîcheur.

- Privé : dépôts internes (M365/SharePoint, Google Drive, Confluence, Slack, bases de connaissances), métadonnées, taxonomies.

-

Mécanisme de réponse

- Public : LLM + synthèse avec citations/liens sortants (ex. AI Overviews). Voir Google — Generative AI in Search (2024).

- Privé : RAG sur index vectoriel + respect des permissions; intégration aux outils de travail. Références: AWS Kendra — présentation, Elastic — vector search.

-

Sélection/ranking

- Public : pertinence, autorité, fraîcheur, diversité; préférences de certaines plates-formes selon requêtes.

- Privé : pertinence sémantique, qualité documentaire, métadonnées, règles de sécurité; re‑ranking (BM25 -> cross‑encoder) et ajustements de pertinence, cf. Azure Cognitive Search — tuning (2025).

-

Expérience utilisateur

- Public : réponse concise + liens; parfois conversationnelle (AI Mode).

- Privé : réponse contextualisée au sein de Teams/Slack/M365, avec actions (créer un résumé, retrouver un fichier, enclencher un workflow).

-

Mesure & KPIs

- Public : taux de citation/mention, sentiment, visibilité par moteur, corrélation avec clics et conversions.

- Privé : adoption, CSAT, précision/recall, nDCG/MRR, temps gagné, résolution au premier contact; journaux d’audit.

-

Risques

- Public : variabilité des modèles, zero‑click, attribution incertaine, copyright.

- Privé : fuites si permissions mal réglées, réponses hallucinéess sans bon grounding, adoption faible sans UX/formation.

Optimiser pour les moteurs IA publics

- Cadrer vos contenus pour l’intent et le format réponse

- Couvrez l’intent principal et les sous‑intentions. Les réponses IA favorisent les contenus structurés en Q&A, les résumés, FAQ, schémas, définitions claires, données vérifiables et citations vers sources primaires.

- Travaillez l’E‑E‑A‑T et les entités : auteurs identifiés, preuves, mentions sur sites d’autorité, et contenus multimédias (vidéos démonstratives).

- Technique et signaux d’autorité

- Vitesse, indexation, données structurées, balisage, canonical/nettoyage des duplicats, sitemap net; liens éditoriaux de qualité.

- Actualisez régulièrement les pages « money » et guides; utilisez des extraits de code, chiffres clés, visuels originaux.

- Plateforme par plateforme

- Observez quelles sources sont fréquemment citées par moteur (YouTube pour « how‑to », Reddit pour avis, docs officielles pour définitions) et créez/optimisez ces actifs.

- Suivez l’évolution des directives et fonctionnalités, par exemple les annonces 2025 autour d’AI Mode et d’AI Overviews dans Google — AI Mode (mai 2025) et les mises à jour Search Central.

- Mesure et itération

- Mesurez le taux de citation/mention par requête et moteur; mappez le sentiment associé; reliez ces signaux au trafic/conversions. Plusieurs études 2024–2025 signalent une hausse du « zero‑click », rendant ces métriques encore plus critiques, voir Similarweb — zero‑click 2025.

- Outils de monitoring

- Exemple: Geneo. La plateforme suit les citations/mentions de marque dans ChatGPT, Perplexity et AI Overviews, analyse le sentiment, conserve l’historique des requêtes et génère des suggestions de contenu pour améliorer la présence cross‑IA et SEO traditionnel; voir la page d’accueil Geneo — plateforme de visibilité IA.

- Alternatives et compléments: outils de suivi de visibilité IA proposés par des éditeurs tiers; vérifiez la couverture exacte des moteurs et la profondeur d’analyse avant choix.

Checklist express (public)

- Couvrir l’intent et structurer en Q&A/FAQ; ajouter données et sources primaires.

- Optimiser E‑E‑A‑T, profils auteurs, et actifs multimédias (ex. vidéo YouTube).

- Renforcer signaux techniques et d’autorité; actualiser contenus stratégiques.

- Surveiller les plateformes cibles et leurs sources préférées; créer ces actifs.

- Monitorer citations/mentions et sentiment; corréler avec clics et conversions.

Optimiser pour la recherche IA privée (entreprise)

- Gouvernance des données et qualité documentaire

- Cartographiez les dépôts (SharePoint, Drive, Confluence, Slack…) et nettoyez les contenus obsolètes. Normalisez métadonnées, taxonomies et politiques de rétention.

- Sémantique et RAG

- Choisissez des embeddings adaptés au domaine et mettez‑les à jour. Soignez le chunking (taille, overlap), la réécriture de requêtes et le grounding avec citations de passages.

- Mettez en place un pipeline de re‑ranking (BM25 -> cross‑encoder) et calibrez la pertinence avec des listes de jugement et tests A/B, cf. Elastic Search Labs — judgment lists (2024–2025) et Azure Cognitive Search — tuning (2025).

- Sécurité, permissions et conformité

- Appliquez RBAC/ABAC, SSO/SCIM, étiquetage de sensibilité, et journaux d’audit. Intégrez les politiques de confidentialité et de conservation (PII, GDPR, ISO).

- Adoption et expérience utilisateur

- Intégrez l’assistant là où travaillent les équipes (Teams, Slack, M365). Prévoyez onboarding, formation et feedback in‑app pour créer une boucle d’amélioration continue.

- Mesure et évaluation

- Suivez adoption, CSAT/NPS, temps gagné, résolution au premier contact; évaluez précision/recall, nDCG, MRR. Voir les guides d’évaluation de IBM — Discovery analytics et d’AWS — Kendra tuning.

Checklist express (privé)

- Gouvernance: taxonomies, métadonnées, nettoyage, cycle de vie document.

- RAG: embeddings, chunking, réécriture, grounding avec citations.

- Sécurité: RBAC/ABAC, SSO/SCIM, audit et étiquetage sensibilité.

- UX: intégration dans outils de travail, formation, feedback.

- Mesure: mix usage (adoption/CSAT) + pertinence (nDCG/MRR) + temps gagné.

Mesure et pilotage : quel cadre en 2025 ?

- Côté public, combinez visibilité/citations, sentiment et impact business. Les signaux de clic se déforment avec les réponses synthétiques; triangulez avec vos analytics Web et des tests avant/après. Les controverses 2025 sur l’effet des AI Overviews soulignent la nécessité d’une mesure de marque dédiée, cf. Google — AI Mode (mai 2025) et les analyses agrégées de Search Engine Land — CTR en baisse (2024).

- Côté privé, mettez en place un cadre d’évaluation continu mêlant métriques automatiques (nDCG, MRR, Precision@k), feedback humain et analytics d’usage. Référez‑vous aux bonnes pratiques documentées par Azure Cognitive Search — tuning et Elastic — calibration & vector search.

Cas d’usage rapides par persona

-

SEO/Content Lead (PME/ETI)

- Objectif: maintenir la visibilité dans AI Overviews/Perplexity et transformer en clics/conversions.

- Actions: structurer contenus Q&A, enrichir preuves et multimédia, surveiller citations/sentiment par requête; prioriser les pages qui gagnent des mentions mais peu de clics.

-

CMO/Brand Manager

- Objectif: protéger la marque et harmoniser le message dans les réponses IA publiques.

- Actions: monitorer mentions multi‑plateformes, analyser le sentiment, lancer des initiatives de preuve (études, livres blancs), dialoguer avec les équipes social/PR pour renforcer les actifs sources.

-

Data/Knowledge Management (grande entreprise)

- Objectif: améliorer la recherche interne et la qualité RAG en respectant la conformité.

- Actions: gouvernance documentaire, embeddings de domaine, tests A/B de pertinence, intégration dans l’environnement de travail et formation.

-

IT/Sécurité

- Objectif: réduire les risques de fuite et assurer la traçabilité.

- Actions: SSO/SCIM, RBAC/ABAC, journaux d’audit, étiquetage de sensibilité; revues régulières des accès.

Recommandations par scénario

-

Startup B2B

- Miser tôt sur la structuration Q&A et les actifs techniques (docs, démos) souvent cités par les moteurs IA publics; mesurer via un outil de monitoring des citations/mentions et itérer rapidement.

-

PME e‑commerce

- Travailler guides d’achat, comparatifs, fiches enrichies; créer vidéos how‑to; suivre le sentiment et corréler aux conversions post‑vue IA.

-

Grand compte multi‑pays

- Priorité au privé: gouvernance et RAG de qualité; déploiement progressif avec évaluation continue. Côté public, aligner PR, contenu et social pour garantir la cohérence des réponses IA dans les marchés clés.

-

Secteur régulé (santé, finance, public)

- Renforcer sécurité et conformité (privé); côté public, s’appuyer sur sources primaires officielles et mentions d’autorités pour minimiser le risque d’info erronée reprise par les synthèses IA.

FAQ express

-

Peut‑on « opt‑out » des AI Overviews ?

- Il n’existe pas, à date, de mécanisme d’opt‑out spécifique communiqué par Google pour AI Overviews; les contrôles classiques (robots.txt, noindex, data‑nosnippet) s’appliquent sans garantie d’exclusion dédiée. Surveillez les mises à jour Search Central.

-

Comment attribuer l’impact business des réponses IA ?

- Croisez le suivi de citations/mentions et sentiment avec vos analytics (post‑impression IA -> recherche de marque -> sessions) et des tests avant/après sur les pages optimisées.

-

Quelles métriques pour juger la qualité en privé ?

- Mélangez nDCG/MRR/Precision@k, CSAT, adoption, temps gagné, et évaluations humaines régulières.

Ressources officielles à consulter

- Guides et annonces publiques: Google — AI Mode (mai 2025); Search Central — mises à jour; Similarweb — zero‑click 2025; Search Engine Land — CTR en baisse (2024).

- Recherche d’entreprise/RAG: Microsoft — Copilot overview; Microsoft Graph — overview; Elastic — vector search; Azure Cognitive Search — tuning; AWS — Kendra; IBM — Discovery analytics.

Liens utiles

- Suivre votre visibilité IA publique et le sentiment multi‑plateformes: Geneo — plateforme de monitoring cross‑IA