Tester vos prompts IA pour évaluer la présence de marque : meilleures pratiques 2025

Découvrez les meilleures pratiques pour tester vos prompts IA et optimiser la présence de marque sur ChatGPT, Perplexity, Google AI Overviews. Méthodes, KPI, workflow, et usage de Geneo pour les professionnels du marketing digital.

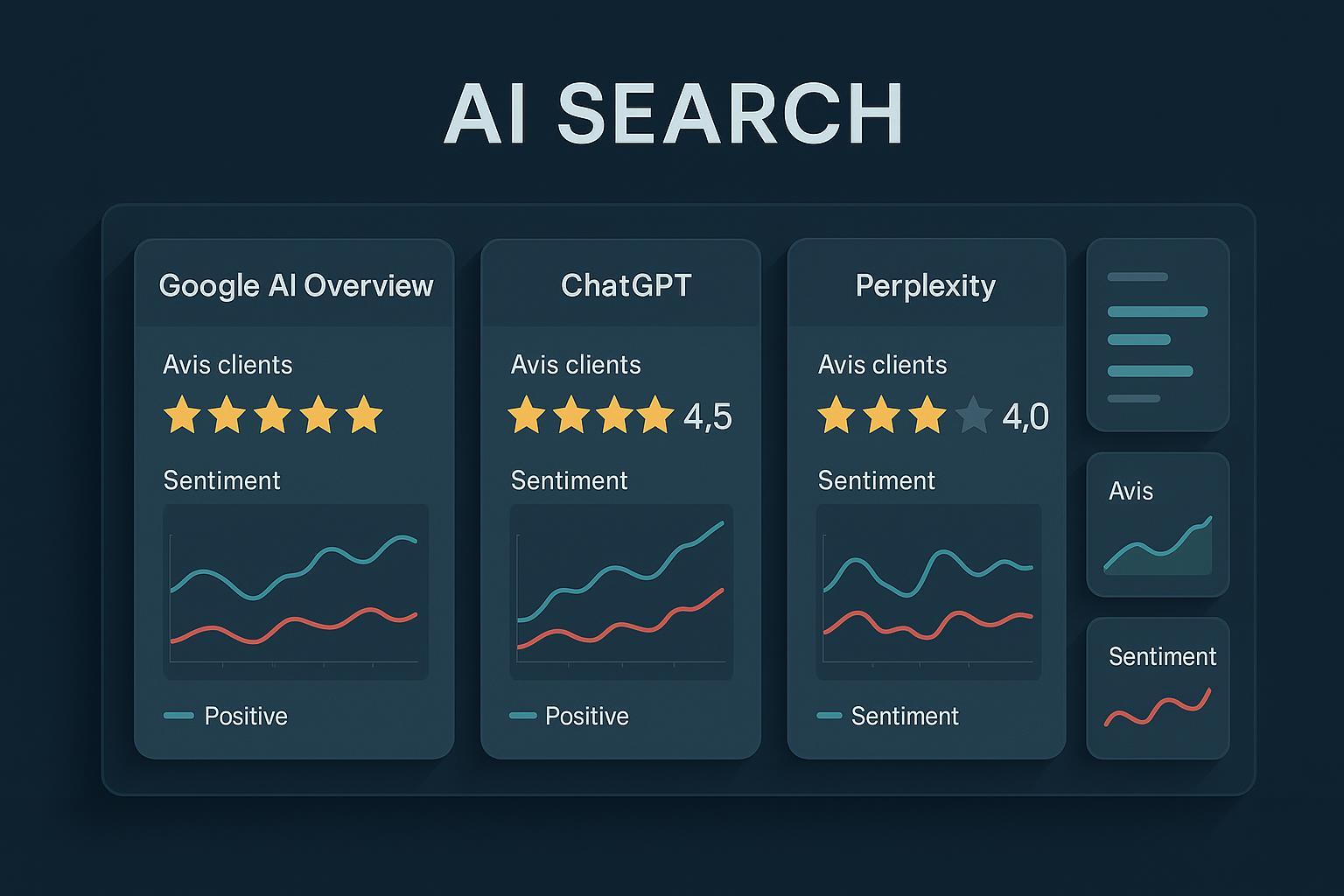

La recherche générée par l’IA n’est plus un sujet de demain. En 2025, les réponses synthétiques de Google (AI Overviews), les moteurs de réponse comme Perplexity et les capacités de recherche de ChatGPT redessinent la façon dont les marques sont découvertes et citées. Pour les équipes marketing, l’enjeu est double :

- mesurer objectivement la présence de marque dans ces réponses,

- et mettre en place un cycle d’optimisation qui améliore la fréquence et la qualité des citations.

Dans cet article, je partage une méthode éprouvée, basée sur des protocoles de test multi-plateformes, des KPI concrets et un workflow d’itération. J’illustre aussi comment centraliser le suivi avec un outil spécialisé comme Geneo pour gagner en vitesse et en fiabilité opérationnelle.

Pourquoi c’est prioritaire en 2025

- Selon les synthèses publiées en 2024–2025, l’apparition d’AI Overviews peut réduire le CTR organique classique malgré davantage d’impressions, avec des effets mesurés par BrightEdge, Ahrefs et Amsive sur des panels US en 2024–2025, comme le rapportent Search Engine Land dans ses analyses 2025 sur l’« impact CTR » et la « position des Overviews » (Search Engine Land – données BrightEdge/Ahrefs/Amsive 2025, Search Engine Land – position/part des requêtes 2025).

- Google indique que ses AI Overviews cherchent à « mettre en avant plus de liens utiles » et à aider à l’exploration, tout en s’appuyant sur un ensemble de pages web plus large que la SERP traditionnelle (Google – annonce AI Overviews 2024, et principes techniques dans Google Search Central – fonctionnalités IA (FR)).

- Perplexity revendique la transparence des sources et l’affichage natif des références, ce qui crée une opportunité claire de mesurer la « part de voix IA » sur des requêtes ciblées (Perplexity Hub – About Perplexity).

- Côté ChatGPT, la visibilité dépend du mode utilisé : la recherche web (introduite fin 2024 sous l’appellation ChatGPT Search) active l’insertion de sources, contrairement au mode purement conversationnel qui n’en affiche pas par défaut (OpenAI – Introducing ChatGPT Search 2024).

- Le protocole de test multi-plateformes (6–12 semaines) Objectif : établir une ligne de base, mesurer, puis optimiser. Voici le protocole que nous utilisons avec les équipes marketing et agences.

Étape A — Constituer un corpus de prompts (30 à 100)

- Couvrir 4 intentions :

- informationnelles (ex. « Qui est [marque] ? », « [marque] est-elle adaptée à [use case] ? »),

- comparatives (« [marque] vs [concurrent] pour [besoin] »),

- transactionnelles (« meilleur [produit] pour [segment] », « alternatives à [marque] »),

- navigationnelles/FAQ (« tarifs [marque] », « intégrations [marque] »).

- Varier la longueur et la précision : prompts courts, longs (8+ mots), avec termes techniques.

- Définir un set de concurrents (3–5) par segment.

Étape B — Plateformes et modes à tester

- Google: requêtes FR en environnement FR, observer quand l’AI Overview s’affiche et quelles sources sont citées. Les Overviews ne s’affichent pas systématiquement; ils privilégient des liens d’appui, parfois au-delà du top 10 organique (Google Search Central – fonctionnalités IA 2025; constats marché synthétisés par Search Engine Land – citations au-delà du top 100, 2025).

- Perplexity: tester Focus Web/Academic/YouTube/Reddit selon la nature du besoin; noter les sources citées et leur diversité (Perplexity Hub – modes Focus).

- ChatGPT: comparer mode conversationnel vs mode avec recherche (ChatGPT Search); le second produit des liens sourcés (OpenAI – ChatGPT Search 2024).

Étape C — Cadence de test

- Semaine 0: baseline sur l’ensemble du corpus (toutes plateformes/modes définis).

- Semaines 1–5: re-tests hebdomadaires sur un échantillon stable (ex. 50 prompts) + 10 nouveaux prompts pertinents.

- Semaines 6–12: re-tests bimensuels; consolidation mensuelle des tendances.

Étape D — Journalisation et traçabilité

- Consigner chaque prompt, captures d’écran, liens cités, polarité du discours, time-to-answer.

- Centraliser les résultats par plateforme et par concurrent.

- Exemple d’outillage: un tableur structuré ou, plus efficace, un outil spécialisé GEO comme Geneo pour automatiser le suivi des mentions, des liens et du sentiment, et conserver l’historique multi-marques.

- Les KPI qui comptent (et comment les scorer) Pour sortir de l’impressionnisme, scorez chaque requête sur une échelle 0–5 et calculez des moyennes pondérées par intention.

- Taux de citation (Citation Rate)

- Définition: % de prompts où la marque est citée (et/ou où un lien officiel est présent).

- Mesure: 1 si la marque est citée, 0 sinon; privilégier 2 points si un lien vers un domaine officiel (site, doc, chaîne YouTube) est inclus.

- Précision factuelle

- Définition: % de réponses sans erreurs sur la marque/produit.

- Méthode: contrôle par expert produit; noter 0–5 selon gravité et nombre d’erreurs.

- Pertinence/contextualisation

- Définition: adéquation de la réponse à l’intention (informationnelle, transactionnelle, comparative, etc.).

- Méthode: grille 0–5; 5 si la réponse résout clairement l’intention et met en perspective la marque.

- Sentiment

- Définition: polarité (positif/neutre/négatif) et intensité du propos.

- Méthode: 0–5 en pondérant la tonalité et la visibilité de la marque dans la réponse.

- Cohérence inter-plateformes

- Définition: stabilité du message entre ChatGPT, Perplexity et AI Overviews.

- Méthode: variance normalisée (0 = incohérent, 5 = messages alignés).

- Part de voix IA (SOV-IA)

- Définition: part de mentions/citations de la marque vs 3–5 concurrents sur le corpus.

- Méthode: (Mentions marque) / (Mentions totales sur le corpus) par intention et par plateforme.

- Stabilité temporelle

- Définition: volatilité des résultats semaine à semaine.

- Méthode: écart-type de vos scores; suivre les cassures de tendance.

Pourquoi ces KPI maintenant?

- Les Overviews élargissent l’éventail de sources et modifient la relation classement→clic, ce qui rend des indicateurs comme le Citation Rate, la diversité des sources et la SOV-IA particulièrement utiles en complément du CTR, comme le montrent les synthèses 2025 de Search Engine Land basées sur BrightEdge/Ahrefs/Amsive (Search Engine Land – analyses 2025).

- Exemples de prompts (FR) par intention Utilisez ces modèles comme base et adaptez-les à votre contexte secteur/persona.

- Informationnel

- « Qui est [marque] et que propose-t-elle pour [use case] ? »

- « Quels sont les points forts/faiblesses de [marque] pour [segment] ? »

- Comparatif

- « [Marque] vs [Concurrent] : quelle solution choisir pour [besoin] en France ? »

- « Quelles alternatives crédibles à [marque] pour [cas d’usage] ? »

- Transactionnel

- « Meilleur [type de produit] pour [persona] en 2025 »

- « Tarifs et intégrations de [marque] pour [outil écosystème] »

- FAQ/navigationnel

- « La feuille de route 2025 de [marque] »

- « [marque] est-elle compatible avec [réglementation/standard] ? »

Conseils pratiques

- Spécifiez la langue, la région (ex. France), le contexte d’usage et les contraintes (« cite tes sources » pour Perplexity/ChatGPT Search).

- Pour ChatGPT sans recherche, demandez explicitement l’appui sur des sources et lister les références; sinon, aucun lien n’apparaîtra par défaut (OpenAI – ChatGPT Search 2024).

- Grille d’évaluation (0–5) et calculs rapides

- Par prompt et par plateforme, notez chaque KPI 0–5.

- Moyenne par intention (info, comparatif, transactionnel, FAQ) et par plateforme.

- SOV-IA: calculez la part de mentions par marque sur l’ensemble du corpus, puis suivez l’évolution par mois.

- Tableau minimal:

- Lignes: prompts; Colonnes: Citation (0/1/2), Précision (0–5), Pertinence (0–5), Sentiment (0–5), Cohérence (0–5), Temps de réponse (s), Sources (nb/diversité), Liens officiels (nb).

- Optimiser vos prompts et vos sources « citation-friendly » L’ingénierie de prompts ne suffit pas si l’IA ne trouve pas de sources solides. Les meilleures améliorations viennent de l’écosystème de citations.

- Renforcer les sources canoniques

- Pages de référence (site officiel, docs, FAQ, études) structurées, avec données claires et schémas; faciliter l’extraction et l’attribution. Bonnes pratiques globales alignées sur Search Central (Google Search Central – fonctionnalités IA (FR), 2025).

- Wikipédia

- Page stable, bien sourcée, au ton neutre. Dans la pratique, de nombreux LLM exploitent fréquemment Wikipédia et d’autres sources de confiance, comme le rappellent des analyses de 2025 sur les « sources IA » (Les Leaders Visionnaires – cartographie des sources 2025).

- YouTube et communautés

- Publiez des démonstrations avec chapitrage; intervenez sur Reddit/communautés spécialisées de manière qualifiée. Ces formats sont régulièrement utilisés par Perplexity et d’autres moteurs de réponse (Perplexity Hub – Focus YouTube/Reddit).

- Relations presse et médias d’autorité

- Obtenez des mentions sur des médias reconnus; les LLM y piochent volontiers. La presse/les backlinks éditoriaux figurent parmi les recommandations opérationnelles pour « positionner une marque sur les IA » en 2025 (Réacteur – Positionner une marque sur les IA, 2025).

Astuces de prompt

- Contraintes explicites: « réponds en 120 mots, liste 3 sources officielles, montre 2 concurrents comparables ».

- Contexte: « tu es un acheteur B2B en France dans [secteur] » pour orienter la pertinence.

- Format: bullet points + tableau de pour/contre lorsque la plateforme le permet.

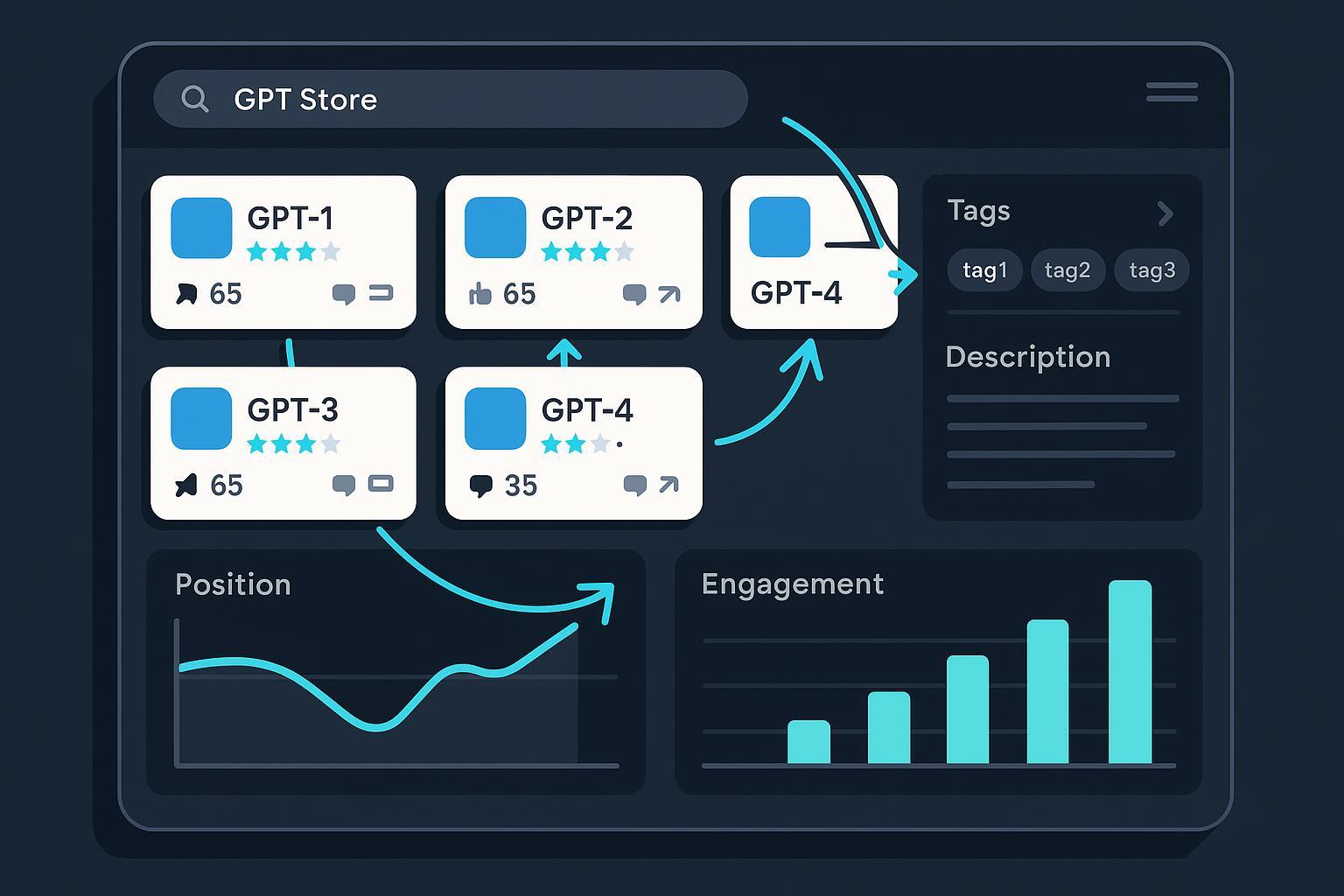

- Centraliser et automatiser le suivi avec Geneo Pourquoi outiller? Parce que la variabilité est forte et les volumes de tests élevés. Un outil spécialisé évite la perte d’information et accélère l’itération.

Comment Geneo aide concrètement

- Suivi multi-plateformes (ChatGPT, Perplexity, Google AI Overviews): monitoring en temps réel des mentions et liens cités, multi-marques/équipes.

- Analyse de sentiment: polarité et tendance visibles par prompt et par plateforme; utile pour détecter les biais négatifs.

- Historique des requêtes: rejouer et comparer les tests; visualiser l’évolution 6–12 semaines.

- Recommandations d’optimisation: suggestions de contenus et de sources à renforcer lorsque la marque n’est pas citée ou mal contextualisée.

- Gouvernance: tags par intention, exports, alertes; utile pour agences et organisations multi-lignes.

Scénario type

- Semaine 0: import de votre corpus; exécution des tests; Geneo calcule le Citation Rate, la SOV-IA et le sentiment par plateforme.

- Semaine 2: Geneo remonte des trous de couverture (ex. faible présence sur Perplexity/Focus Academic); vous publiez un livre blanc et renforcez Wikipédia/YouTube.

- Semaine 6: la courbe de citations sur AI Overviews progresse; vous lancez des RP ciblées pour capter des médias d’autorité. Les scores de pertinence/sentiment s’améliorent.

- Cas d’usage métier (exemples opérationnels)

- E-commerce (catalogue large)

- Objectif: capter les requêtes « meilleur [catégorie] pour [persona] ». Actions: travailler guides d’achat et comparatifs sur votre .fr, vidéos YouTube chapitrées, FAQ produit enrichie. KPI: Citation Rate sur prompts transactionnels, SOV-IA vs 3 concurrents, sentiment.

- Agence multi-marques

- Objectif: industrialiser le GEO pour 10–20 clients. Actions: définir un corpus commun + variantes sectorielles, cadencer les re-tests, produire des rapports mensuels consolidés. KPI: progression de la SOV-IA et de la stabilité; temps de cycle d’itération.

- Communication corporate

- Objectif: corriger des messages imprécis/négatifs. Actions: audit de précision factuelle, renforcement des pages « À propos », dossiers presse, données publiques; coordination RP. KPI: score de précision et sentiment, cohérence inter-plateformes.

- Checklist actionnable

- Avant de tester

- Définir clairement vos personas, intentions et concurrents.

- Créer un corpus de 30–100 prompts couvrant info/comparatif/transactionnel/FAQ.

- Choisir les modes de test: AI Overviews FR, Perplexity (Focus adaptés), ChatGPT Search vs sans recherche.

- Pendant le test

- Journaliser prompts, réponses, sources, liens officiels, sentiment.

- Noter 0–5 par KPI; calculer SOV-IA et suivre la variance.

- Centraliser l’historique; taguer par intention/persona.

- Après le test

- Prioriser les manques: où la marque n’est-elle pas citée? quelles erreurs reviennent?

- Optimiser les sources: Wikipédia, YouTube, pages canoniques, RP/médias d’autorité.

- Relancer un cycle de test 2–4 semaines plus tard; comparer les tendances.

Erreurs fréquentes à éviter

- Se focaliser uniquement sur le CTR organique. Avec les AI Overviews, le CTR se comporte différemment; complétez avec Citation Rate/SOV-IA, comme le soulignent les analyses 2025 de Search Engine Land consolidant plusieurs études marché (Search Engine Land – guide AI SEO 2025).

- Tester sans consigner les sources exactes. Sans preuve, pas d’itération fiable.

- Ignorer le mode de la plateforme (ex. ChatGPT sans recherche) et conclure trop vite sur « l’absence de citation ».

- Sous-estimer l’impact des communautés et de Wikipédia dans les résultats IA, point déjà remonté par des décryptages 2025 sur les sources privilégiées par les LLM (Les Leaders Visionnaires – sources IA 2025).

- Trade-offs et réalités du terrain

- Variabilité: les réponses fluctuent selon le temps, la localisation et le contexte utilisateur. Il faut des fenêtres d’observation de 6–12 semaines pour voir une tendance solide.

- Politiques de plateformes: AI Overviews évoluent en fréquence d’apparition et en position dans la SERP; certaines analyses 2025 notent des apparitions en position 1 majoritaires mais pas exclusives (Search Engine Land – position des Overviews 2025).

- Attribution/ROI: difficile de relier directement une amélioration de la présence IA à une conversion. Utilisez des proxys: trafic référent depuis les liens cités, hausse des requêtes de marque, conversions assistées. Contexte FR: l’actualité SEO 2025 souligne l’essor de la recherche Google face à ChatGPT et les tensions sur le trafic éditeur (Abondance – point de situation 2025).

- Passer à l’action dès cette semaine (plan 30–60 jours)

- Jours 1–3: constituer le corpus de prompts; configurer le suivi (tableau + Geneo); définir concurrents/personas.

- Semaine 1: baseline multi-plateformes; scoring 0–5; identification des trous (absence de citation, erreurs factuelles).

- Semaine 2: corriger 3 sources prioritaires (Wikipédia, page « À propos », vidéo YouTube phare); briefer les RP.

- Semaines 3–4: re-test ciblé; prioriser 2 nouvelles opportunités de citation (ex. étude sectorielle, FAQ technique).

- Semaines 5–8: second cycle d’optimisation; suivi SOV-IA et sentiment; préparer le rapport aux parties prenantes.

Ressources utiles pour cadrer votre démarche

- Les principes officiels côté Google sur l’intégration IA dans la recherche et les attentes en matière de sources sont détaillés dans la documentation 2024–2025 (Google Search Central – fonctionnalités IA (FR)) et dans l’annonce produit (Google – AI Overviews 2024).

- Les conséquences mesurées sur clics, positions et citations sont régulièrement synthétisées par des publications spécialisées en 2025 (Search Engine Land – analyses AI Overviews 2025).

- Pour une approche GEO pragmatique (formats citation-friendly, rôle des RP), des ressources 2025 détaillent des méthodes concrètes (Réacteur – Positionner une marque sur les IA, 2025).

- Panorama d’outils de suivi LLM et de visibilité IA pour compléter votre stack (ClickUp – Outils de suivi des LLM, 2025).

Conclusion Tester vos prompts IA n’est pas un « side project » : c’est l’équivalent, pour 2025, d’un audit SEO appliqué aux moteurs de réponse. Les marques qui centralisent leurs observations, mesurent avec des KPI adaptés (Citation Rate, SOV-IA, précision, sentiment) et itèrent sur les sources « citation-friendly » prennent de l’avance. Si vous voulez accélérer sans alourdir vos process, équipez-vous d’un outil spécialisé.

Essayez Geneo pour structurer votre audit GEO, suivre vos citations sur ChatGPT, Perplexity et Google AI Overviews, analyser le sentiment et piloter vos itérations. Démarrez ici : https://geneo.app