¿Qué son los Vector Embeddings? Definición, aplicaciones y ejemplos en IA

Descubre qué son los Vector Embeddings: definición clara, funcionamiento, aplicaciones en IA, SEO y análisis de sentimiento. Aprende cómo optimizan la búsqueda semántica y la visibilidad de marca en plataformas inteligentes. Ejemplos prácticos y diferencias con otras técnicas.

Definición en una frase

Un vector embedding es una representación numérica densa de datos (como palabras, imágenes o conceptos) en un espacio multidimensional, diseñada para capturar relaciones semánticas y permitir que las máquinas procesen y comparen información compleja de manera eficiente (InterSystems, IBM).

Explicación detallada

Los vector embeddings transforman datos complejos —como texto, imágenes, audio o grafos— en vectores de alta dimensión. La posición y distancia entre estos vectores reflejan la similitud y las relaciones semánticas entre los datos. Por ejemplo, en el procesamiento de lenguaje natural (PLN), palabras con significados similares tendrán vectores cercanos en el espacio, mientras que palabras no relacionadas estarán alejadas. Esta técnica permite a los algoritmos de IA identificar patrones, realizar búsquedas semánticas y analizar sentimientos con mayor precisión que los métodos tradicionales como one-hot encoding o bag of words (datos.gob.es).

Componentes clave

- Modelo de embedding: Algoritmos como Word2Vec, GloVe, BERT (para texto), CNNs (para imágenes) o Node2Vec (para grafos) generan los vectores a partir de grandes corpus de datos.

- Espacio vectorial: Un entorno matemático de cientos o miles de dimensiones donde cada vector representa una entidad (palabra, imagen, usuario, etc.).

- Similitud y distancia: Se utilizan métricas como la distancia coseno o euclidiana para medir la cercanía entre vectores y, por tanto, la similitud semántica.

- Embeddings contextuales vs. estáticos: Los embeddings contextuales (como BERT) varían según el contexto de uso de la palabra, mientras que los estáticos (Word2Vec, GloVe) son fijos para cada término.

Aplicaciones prácticas

- Procesamiento de lenguaje natural: Análisis de sentimientos, clasificación de textos, traducción automática, chatbots y búsqueda semántica.

- Visión por computador: Reconocimiento y clasificación de imágenes, búsqueda visual, detección de objetos.

- Sistemas de recomendación: Personalización de productos, contenidos y usuarios.

- Optimización de búsqueda en IA: Plataformas como Geneo utilizan embeddings para analizar la visibilidad de marcas en motores de búsqueda basados en IA (ChatGPT, Google AI Overview, etc.), mejorar la relevancia de respuestas, sugerir contenido y realizar análisis de sentimiento avanzado. Por ejemplo, Geneo aplica embeddings para identificar cómo se percibe una marca en diferentes plataformas y para generar automáticamente FAQs relevantes, optimizando la presencia digital de empresas.

Conceptos relacionados

- One-hot encoding y Bag of Words: Métodos tradicionales de representación, menos eficientes y sin capacidad semántica.

- Vector Database: Sistema de almacenamiento y consulta de embeddings, clave para búsquedas por similitud a gran escala.

- Semantic Search y RAG: Búsqueda semántica y generación aumentada por recuperación, que aprovechan embeddings para mejorar la precisión y relevancia de resultados.

- Modelos relevantes: Word2Vec, GloVe, BERT, FastText, Node2Vec, CNNs.

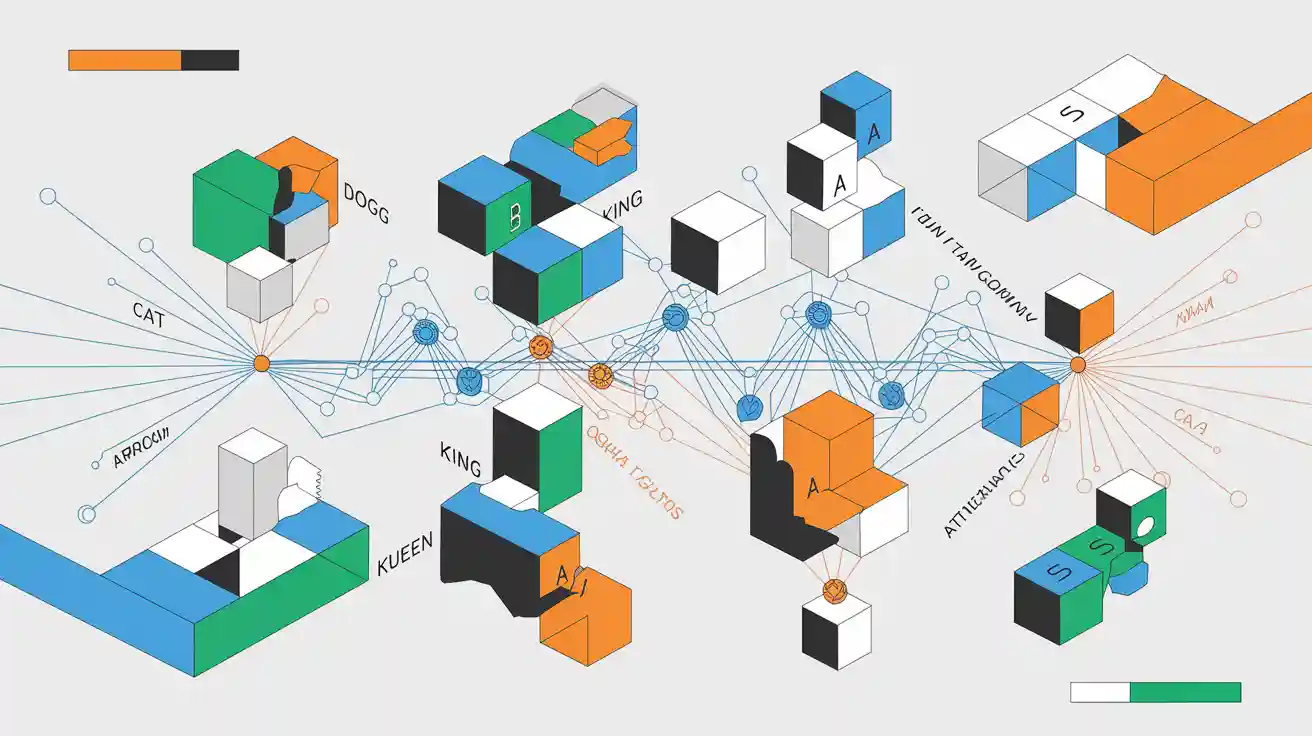

Ejemplo visual

Imagina un espacio 3D donde las palabras “gato”, “perro” y “felino” están agrupadas, mientras que “avión” está lejos. Si restas el vector de “hombre” a “rey” y sumas el de “mujer”, obtienes un vector cercano a “reina”. Este tipo de relaciones y analogías solo es posible gracias a la estructura semántica de los embeddings.

¿Quieres mejorar la visibilidad de tu marca en la era de la IA? Descubre cómo Geneo utiliza vector embeddings para potenciar tu posicionamiento y análisis en buscadores inteligentes. Conoce más