Explora la puntuación de confianza en IA para menciones de marca

Descubre qué es la puntuación de confianza, cómo se calcula y aplica en IA para filtrar menciones de marca y optimizar alertas.

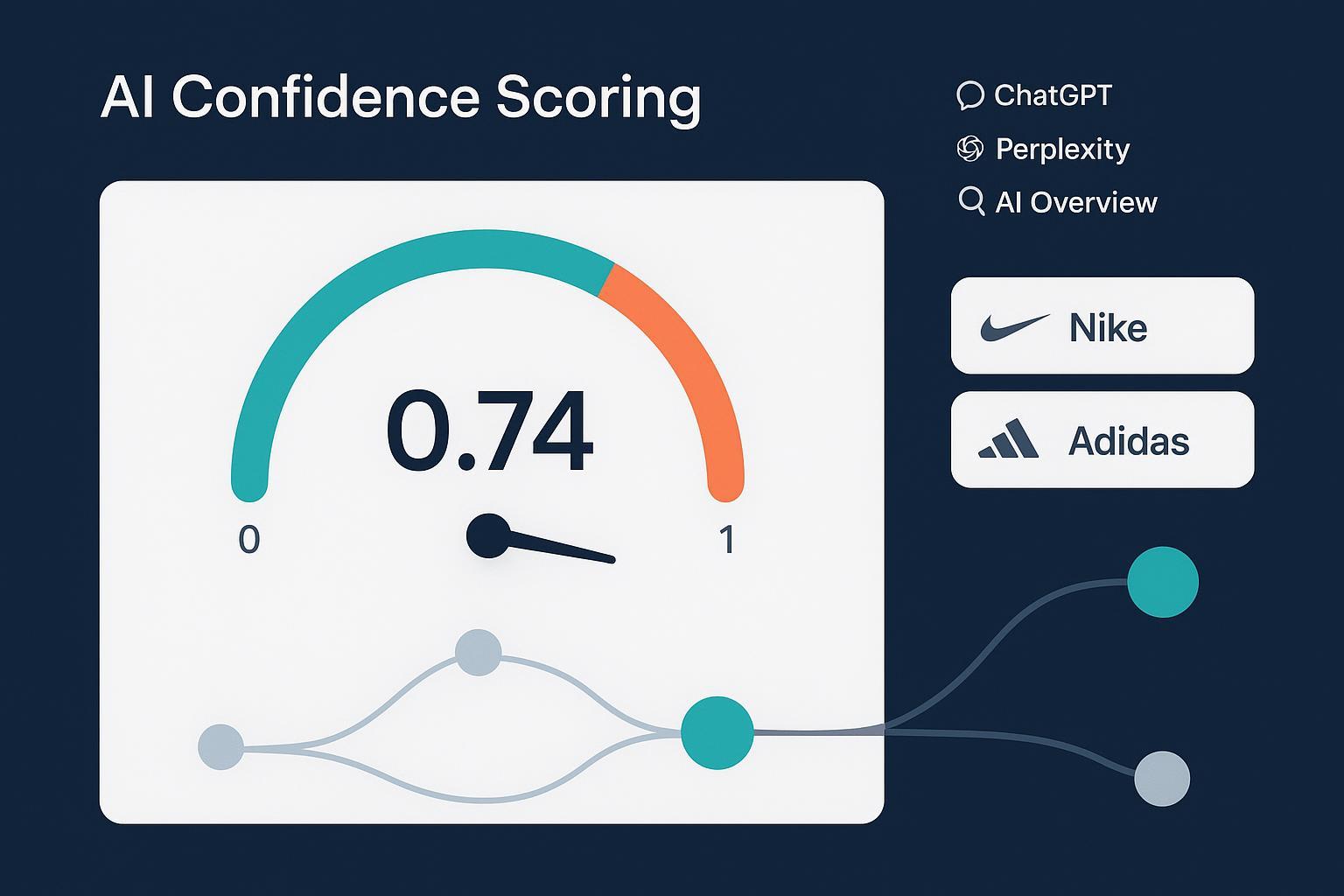

Cuando una respuesta de un motor de IA nombra tu marca, ¿cómo decides qué alerta merece tu atención y cuál puede esperar? Ahí entra la “puntuación de confianza”: el medidor de certeza del sistema sobre si una mención realmente se refiere a tu marca y si está correctamente vinculada/interpretada. Este concepto parece técnico, pero es la base de decisiones operativas sólidas: priorizar riesgos, detectar oportunidades y evitar ruido. Si te preocupa la precisión de las respuestas de modelos (y sus posibles alucinaciones), te servirá ampliar con la guía sobre riesgos y protección en motores de respuesta en la nota de Geneo “Mitigación de alucinaciones en LLM”.

Qué es la “puntuación de confianza” para menciones de marca

La “puntuación de confianza” es un valor, normalmente entre 0 y 1, que expresa cuánta certeza tiene un sistema sobre una predicción: detectar la entidad “Nike” como una marca, vincularla a su registro correcto en una base de conocimiento, o clasificar el sentimiento de la mención. En muchos servicios productivos de NLP, este valor procede de la probabilidad del modelo o de una combinación ponderada de señales.

Por ejemplo, la documentación oficial en español de Amazon describe que las entidades detectadas llevan un campo de score. Puedes verlo en la documentación de Amazon Comprehend sobre entidades, útil para umbralado y filtrado. Servicios de Microsoft también exponen campos de confianza en sus APIs; la guía de Azure AI Language (NER): cómo llamar al reconocimiento de entidades y la información general de vinculación de entidades muestran cómo acceder a esos valores para casos de uso operativos.

Un matiz importante: algunos proveedores (como Google en su versión v1) exponen “salience”, un indicador de relevancia temática de una entidad en el documento. La referencia de entidades de Google Cloud Natural Language (v1) detalla ese campo. “Salience” no es una probabilidad de acierto; usarlo como si fuera “confianza” puede llevar a decisiones erróneas. Además, Google actualiza sus APIs y campos; conviene revisar las notas de versión de Google Cloud NL para confirmar cambios recientes.

Cómo se obtiene: del modelo a un score compuesto

La puntuación de confianza suele empezar en las salidas del modelo y puede enriquecerse con señales adicionales hasta formar un score compuesto robusto.

- Salidas del modelo: Clasificadores y modelos de NER generan logits que se transforman en probabilidades (p. ej., con softmax). Esas probabilidades se emplean como score o se recalibran antes de producción.

- Similitud semántica: Embeddings que comparan la mención con descripciones/perfiles de la marca (productos, portavoces, slogans) para verificar consistencia.

- Fiabilidad de la fuente: No pesa igual un medio verificado que un foro anónimo; incluir reputación/categoría del dominio ayuda a reducir falsos positivos.

- Contexto y coherencia temporal: Co‑ocurrencias con términos esperados (“zapatillas”, “Jordan”), y continuidad histórica (¿aparece la marca en este canal con frecuencia?).

Piensa el score como un “rating” dinámico parecido a una calificación crediticia: integra evidencias para estimar la certeza de que la mención es real y correcta. ¿Qué gana tu equipo con esto? Menos ruido, más foco en lo que importa.

Dentro de esta sección cabe otra advertencia práctica: si tu pipeline consume múltiples fuentes y motores de respuesta (p. ej., ChatGPT, Perplexity o resúmenes tipo AI Overview), mezcla probabilidades del modelo con señales de contexto. Y evita confundir “salience” con probabilidad; úsalo como indicador de relevancia, no de acierto.

Calibrar y validar: convertir scores en decisiones fiables

Aunque un modelo devuelva probabilidades, no siempre están bien calibradas: puede afirmar estar al 90% de certeza cuando en realidad acierta el 70%. La calibración alinea la probabilidad predicha con la probabilidad observada.

- Métodos post‑hoc habituales: El trabajo de 2017 de Guo y coautores explica el ajuste por temperatura para redes modernas; ver Guo et al., 2017 en Proceedings of Machine Learning Research. Para clasificación binaria/multiclase, son clásicos el Platt scaling y la regresión isotónica; consultar Niculescu‑Mizil y Caruana (2005) en ACM.

- Validación: Construye reliability diagrams y mide el Expected Calibration Error (ECE) para cuantificar la desviación entre lo que el sistema “cree” y lo que realmente acierta.

- Impacto operativo: Con scores bien calibrados, fijar umbrales deja de ser una apuesta ciega y pasa a ser gobernanza informada: puedes anticipar el volumen de falsos positivos/negativos y ajustar tus flujos.

Pregunta rápida: si mañana cambia el corpus (nueva red social, otro idioma), ¿sigues confiando en los mismos umbrales? Probablemente no. La calibración es un proceso vivo; monitorea la deriva y reevalúa.

Umbrales y respuesta operativa

El umbral separa lo que se automatiza de lo que se revisa. No existe un número universal; hay que contextualizarlo con el coste de error y con tus métricas (precisión, recobrado, F1).

- Coste asimétrico: En reputación, un falso negativo (no alertar una mención crítica) suele costar más que un falso positivo. Ajusta el umbral para priorizar cobertura donde haga falta.

- Métricas con datos reales: Simula diferentes umbrales con un set etiquetado; mide el impacto, repite por canal/idioma y actualiza periódicamente.

- Banda gris: Define una zona intermedia para la revisión humana y registra las decisiones; te servirán para retroalimentar tu calibración.

| Rango de score | Acción recomendada | Objetivo operativo |

|---|---|---|

| ≥ 0,70 | Crear alerta y enrutar al equipo responsable | Priorizar menciones con alta certeza |

| 0,50–0,69 | Revisión humana (rápida) | Resolver ambigüedad y aprender para recalibrar |

| < 0,50 | Registrar, no alertar | Mantener trazabilidad sin generar ruido |

Consejo: para casos críticos (crisis, riesgos legales), empieza alto (p. ej., ≥0,80) y baja gradualmente según el rendimiento histórico. Para campañas y oportunidades, tolera más ruido si eso te da cobertura.

Ejemplo práctico y buenas prácticas en producción

Divulgación: Geneo es nuestro producto.

Imagina un panel operativo que ingiere respuestas de motores de IA y fuentes públicas, extrae entidades y calcula una puntuación de confianza compuesta. Con un umbral de 0,70, las menciones con score ≥0,70 se convierten en alertas; las de 0,50–0,69 pasan a revisión; las menores se registran para trazabilidad. Si el proveedor incluye puntuaciones de sentimiento por mención (como en Amazon Comprehend), las negativas se priorizan automáticamente para respuesta.

Buenas prácticas para que ese panel funcione bajo presión:

- Monitoreo de deriva y recalibración: cuando cambian el canal o el idioma, revalida ECE y ajusta tu calibrador.

- Auditoría de sesgos por fuente: evita “premiar” medios grandes solo por su tamaño; normaliza por canal.

- Humano en el bucle: tu banda gris necesita revisión planificada y registro; esa bitácora mejora el sistema.

- Reporte por canal/idioma: los scores se comportan distinto en Twitter/X vs. prensa; separa métricas.

Para gestionar incertidumbre en los casos difíciles, la predicción conforme puede ser un complemento poderoso: entrega conjuntos de salida con cobertura garantizada (p. ej., 90%). La introducción a la predicción conforme de BBVA AI Factory explica las ventajas, y el artículo del IIC‑UAM ofrece una visión en español. En operaciones de marca, estos conjuntos permiten que solo las menciones con cobertura suficiente disparen automatizaciones; el resto se enruta a revisión.

Si trabajas con respuestas generadas por LLMs y necesitas un marco para evaluar riesgos y proteger tu marca, revisa también la nota de Geneo sobre motores de respuesta y SEO: “Motores de búsqueda AI‑first en 2025: métricas clave y retos”.

Pasos siguientes y una CTA suave

- Alinea definición y fuentes: especifica qué campos de score usas por proveedor y cómo los calibras.

- Construye tus reliability diagrams y mide ECE por canal/idioma; establece ciclos de revisión.

- Define umbrales por caso de uso y activa la banda gris con revisión humana.

- Integra scoring de sentimiento cuando esté disponible para priorizar riesgos.

Si quieres ver un panel con scoring configurable y flujos de ruteo por umbral, puedes empezar una prueba sin compromiso desde el sitio oficial de Geneo: plataforma Geneo. Y para medir tu progreso en motores de respuesta, repasa la guía de KPIs de visibilidad en IA: te ayudará a conectar el scoring con resultados de negocio.

—

Referencias citadas en el texto, con enlace único por fuente:

- Amazon Comprehend (entidades, score): documentación en español.

- Azure AI Language (NER: cómo llamar; entidad linking overview): páginas “Learn”.

- Google Cloud Natural Language (v1: Entity reference; release notes): documentación oficial.

- Guo et al., 2017 (temperature scaling): PMLR.

- Niculescu‑Mizil y Caruana, 2005 (Platt/Isotónica): ACM.

- BBVA AI Factory (conformal prediction): blog técnico.

- IIC‑UAM (predicción conforme): divulgación en español.