Guía técnica de rastreo en búsquedas con IA: bots y controles

Descubre cómo funciona el rastreo en búsquedas con IA, identifica bots clave y aplica controles técnicos para mejorar visibilidad y medición.

¿Cómo llegan las respuestas generadas por IA a citar (o ignorar) tu sitio? La clave está en entender qué rastreadores participan, qué pipeline siguen y qué señales realmente controlas. Antes de entrar en materia, una distinción fundamental: los controles para “entrenamiento de modelos” no son lo mismo que los controles para “aparición en búsqueda”. Bloquear un bot de entrenamiento evita que tus páginas se usen para modelado, pero no necesariamente afecta si un motor de búsqueda con IA puede rastrear e indexar tu contenido para citarlo.

1) Cómo funciona el “AI search crawling” en la práctica

El pipeline de los buscadores clásicos y el de las experiencias con IA comparten la base (descubrir, rastrear, renderizar, indexar). La diferencia es que, en la respuesta con IA, hay una etapa adicional de síntesis que cruza múltiples fuentes y suele mostrar citaciones explícitas.

- Descubrimiento: enlaces, sitemaps y, a veces, feeds o APIs.

- Fetching y renderizado: se recupera y, si hace falta, se renderiza el HTML/JS para extraer contenido.

- Extracción de señales: texto principal, metadatos, enlaces, datos estructurados.

- Indexación: el documento y sus señales se integran en el índice.

- Ranking y síntesis (IA): para una consulta, el sistema reúne pasajes de varias fuentes; el módulo generativo construye la respuesta con citaciones.

Piénsalo así: el indexado clásico prepara “ladrillos” (documentos y pasajes); la IA ensambla una “pared” específica para cada consulta, referenciando los ladrillos que la sustentan.

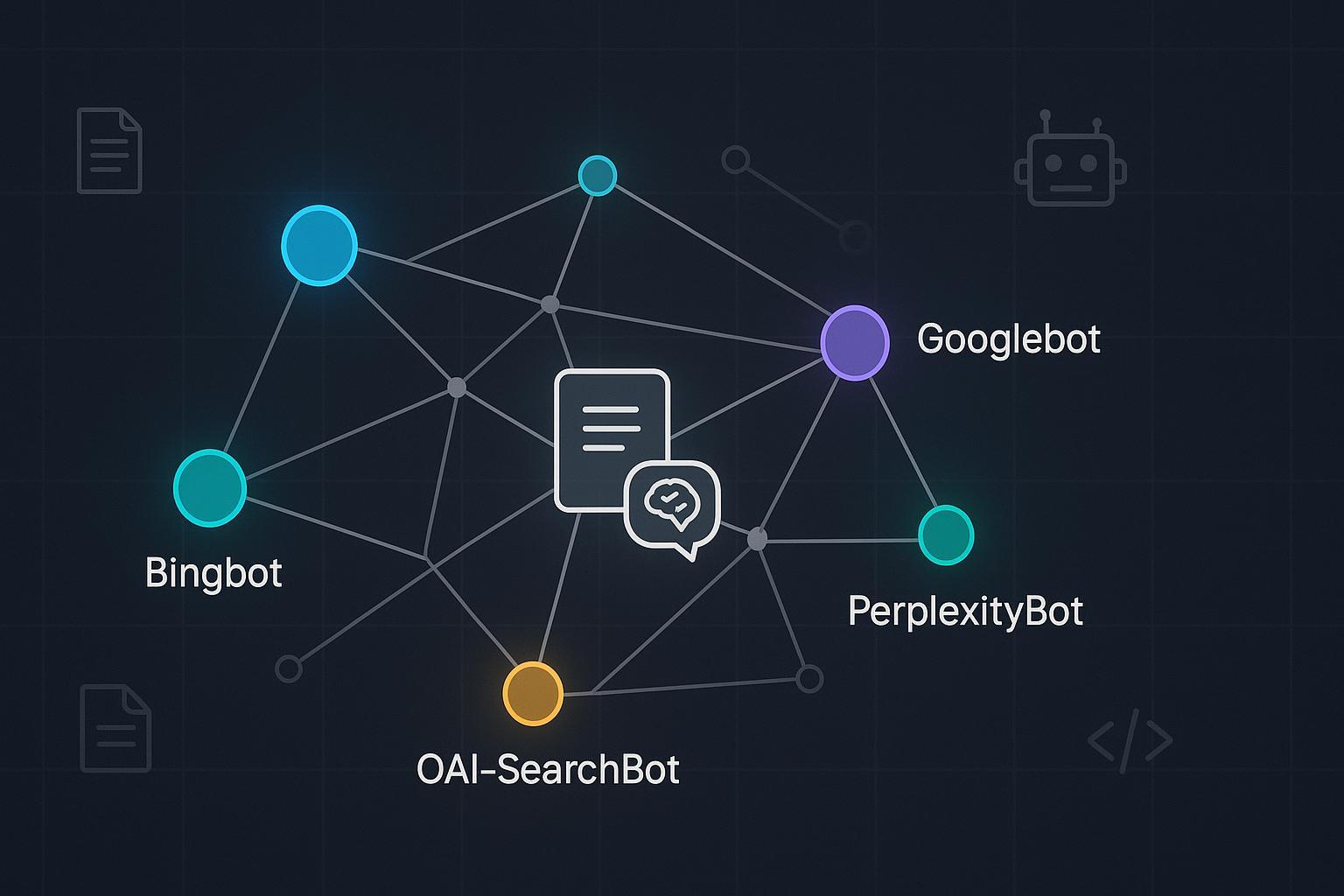

2) Bots que debes conocer y cómo verificarlos

Identificar y verificar a los rastreadores legítimos evita falsos positivos y decisiones erróneas (como bloquear tráfico útil). Google describe cómo verificar Googlebot por DNS inverso y directo; la herramienta de Microsoft ayuda a comprobar Bingbot; Perplexity documenta su PerplexityBot y cómo validar sus IPs; OpenAI explica la relación entre OAI-SearchBot (descubrimiento para ChatGPT Search) y GPTBot (entrenamiento) y cómo controlarlos por robots.txt.

- Para Googlebot, revisa la guía “Qué es Googlebot y cómo verificarlo”, que indica el procedimiento de reverse DNS y forward-confirmation en hostnames de Google: ver la documentación de Googlebot y verificación por DNS (Search Central).

- Para Bingbot, utiliza la herramienta oficial Verify Bingbot de Microsoft.

- Perplexity detalla su rastreador y buenas prácticas de validación en PerplexityBot documentation.

- OpenAI aclara cómo permitir o bloquear OAI‑SearchBot y GPTBot mediante robots.txt en su Publishers and Developers FAQ.

Tabla de referencia rápida:

| Bot | Propósito principal | User‑Agent (común) | Verificación recomendada |

|---|---|---|---|

| Googlebot | Rastreo para Búsqueda/índice | Googlebot | Reverse DNS + forward a IP de Google (hostnames .googlebot.com/.google.com) |

| Bingbot | Rastreo para Búsqueda/índice | bingbot | Herramienta Verify Bingbot; hostnames *.search.msn.com |

| PerplexityBot | Descubrimiento/citación en Perplexity | PerplexityBot | Combinar User‑Agent con validación de IPs documentadas en Perplexity |

| OAI‑SearchBot / GPTBot | Descubrimiento (ChatGPT Search) / Entrenamiento | OAI‑SearchBot / GPTBot | Control por robots.txt según la FAQ de OpenAI; cautela con listas de IP no oficiales |

Nota operativa: desconfía de la suplantación de user‑agent. Sin verificación DNS/IP, es fácil confundir un bot falso con uno legítimo.

3) Controles efectivos (y sus límites)

Los controles más útiles siguen siendo los clásicos del SEO técnico: robots.txt, meta robots, sitemaps y datos estructurados. Sus límites también son los de siempre: robots.txt es un “honor system”, y las directivas de meta requieren que la página sea rastreable para surtir efecto.

- robots.txt

- No es un mecanismo de seguridad; bots legítimos lo respetan, pero actores maliciosos pueden ignorarlo. Google lo explica en la introducción oficial a robots.txt.

- Si bloqueas una URL en robots.txt, puede que se indexe sin contenido si otras páginas la enlazan. Úsalo con criterio.

Ejemplos prácticos de robots.txt:

# Bloquear uso para entrenamiento de OpenAI (GPTBot) pero permitir ChatGPT Search (OAI-SearchBot)

User-agent: GPTBot

Disallow: /

User-agent: OAI-SearchBot

Allow: /

# Permitir PerplexityBot (si quieres aparecer citado en Perplexity)

User-agent: PerplexityBot

Allow: /

# Bloquear un directorio sensible a todos los bots legítimos

User-agent: *

Disallow: /privado/

- Meta robots y controles de fragmentos

- Directivas como noindex, nofollow, nosnippet y max-snippet, y el atributo data-nosnippet, controlan indexación y presentación de fragmentos; se aplican solo si el bot puede acceder al documento. Consulta la guía de robots meta y data‑nosnippet (Search Central).

Ejemplos en HTML:

<!-- Limitar el tamaño del fragmento a 20 caracteres -->

<meta name="robots" content="max-snippet:20">

<!-- Evitar que una parte concreta del HTML aparezca en fragmentos -->

<div data-nosnippet>Texto que no debe salir en fragmentos</div>

- Sitemaps y datos estructurados

- Los sitemaps facilitan el descubrimiento y priorización de URLs, especialmente en sitios grandes. Decláralos en robots.txt y en tus herramientas de webmaster.

- Los datos estructurados no garantizan “funciones de IA”, pero ayudan a que los sistemas comprendan el contenido y relaciones. Mantén el marcado consistente con el contenido visible.

4) Gestionar carga sin perder visibilidad

Si notas picos de rastreo que afectan el rendimiento, evita bloqueos permanentes que perjudiquen la elegibilidad. En su documentación de errores y limitación temporal del rastreo, Google recomienda responder con 503 (Service Unavailable) junto con Retry‑After, o 429 (Too Many Requests), para que el bot reduzca el ritmo y reprograme solicitudes: consulta cómo limitar temporalmente el rastreo (Search Central). En paralelo, revisa los controles de ritmo disponibles en tus consolas de buscador.

5) Observabilidad y diagnóstico

La observabilidad es la base para tomar decisiones informadas. ¿Qué conviene mirar?

- Logs del servidor. Registra y revisa user‑agent, IP y reverse DNS. Crea listas de permitidos para bots verificados y alerta cuando cambien patrones de latencia, códigos 4xx/5xx o solicitudes por minuto.

- Consolas de buscador. Revisa cobertura e informes de rastreo en Search Console y Bing Webmaster Tools; valida que no haya bloqueos accidentales (robots.txt o noindex) en plantillas clave.

- Citaciones y tráfico de referencia. Algunas experiencias (p. ej., Perplexity) muestran enlaces explícitos en las respuestas. Observa qué URLs son citadas y su estado técnico.

Para una visión de cómo la autoridad de fuentes y las citaciones influyen en la visibilidad en entornos de IA, puedes leer este análisis de nuestro equipo: Wikipedia, autoridad y visibilidad en entornos de IA.

6) Ejemplo práctico: comprobar si tu marca aparece citada

Divulgación: Geneo es nuestro producto.

Un flujo simple para validar presencia y citas en motores con IA puede ser así:

- Define un conjunto de consultas de marca y sin marca (por ejemplo, “tu producto + categoría”, “problema que resuelves”).

- Comprueba manualmente resultados en motores con IA (Perplexity, Bing con Copilot, experiencias de IA de Google cuando estén disponibles en tu región) y documenta qué URLs aparecen citadas.

- Crea alertas/monitoreo periódico. Plataformas como Geneo pueden ayudar a centralizar menciones y citaciones en motores de IA y conservar un histórico comparativo por consulta.

- Cruza con tus logs y Search Console/Bing Webmaster Tools: verifica si hubo cambios de rastreo, errores 4xx/5xx o bloqueos involuntarios en las URLs citadas o candidatas.

Resultado esperado: sabrás qué páginas son “candidatas fuertes” a ser citadas, qué bloqueos podrían estar frenándolas y dónde reforzar señales (contenido, estructura, datos estructurados, interlinking).

7) Checklist rápido

- Verifica bots por DNS/IP (Googlebot y Bingbot) y ajusta reglas en WAF si procede.

- Revisa tu robots.txt: evita bloqueos globales innecesarios; diferencia GPTBot vs OAI‑SearchBot según tu política.

- Aplica meta robots/controles de fragmentos donde haga falta; no bloquees en robots.txt si quieres que se apliquen.

- Mantén sitemaps actualizados y consistentes.

- Gestiona picos con 503/Retry‑After o 429; monitoriza tasas de error y latencia.

- Documenta citaciones y su relación con señales on‑page.

Cierre

El rastreo para experiencias con IA no reemplaza al SEO técnico: lo extiende. Siguen importando los fundamentos (accesibilidad, indexabilidad, señales claras), ahora con una capa adicional de verificación de bots y observabilidad de citaciones. Si defines una política clara (qué bots permites y por qué), aplicas controles con precisión y monitorizas resultados, podrás equilibrar exposición y carga de forma sostenible. ¿El siguiente paso? Establece tu lista priorizada de consultas, valida citaciones y corrige bloqueos o incoherencias técnicas antes de escalar.

Referencias clave citadas (consulta las fechas de actualización en cada documento):

- Googlebot y verificación por DNS (Search Central)

- Introducción a robots.txt: carácter voluntario y límites

- Limitar temporalmente el rastreo (errores 503/429)

- Verify Bingbot (Microsoft)

- PerplexityBot documentation

- OpenAI — Publishers and Developers FAQ