Cómo optimizar para respuestas de Claude AI: mejores prácticas 2025

Descubre las mejores prácticas 2025 para optimizar tu contenido y lograr citas en respuestas de Claude AI. Estrategias GEO, RAG y KPIs para profesionales.

Si tu marca ya compite por presencia en motores de respuesta, Claude AI exige una estrategia propia. No basta con “publicar más”; necesitas contenido fácil de extraer y citar, flujos técnicos que favorezcan la atribución y una medición rigurosa. Aquí vas a encontrar un método accionable y verificado para elevar tu visibilidad en respuestas de Claude, sin promesas vacías.

Qué distingue a Claude para la visibilidad

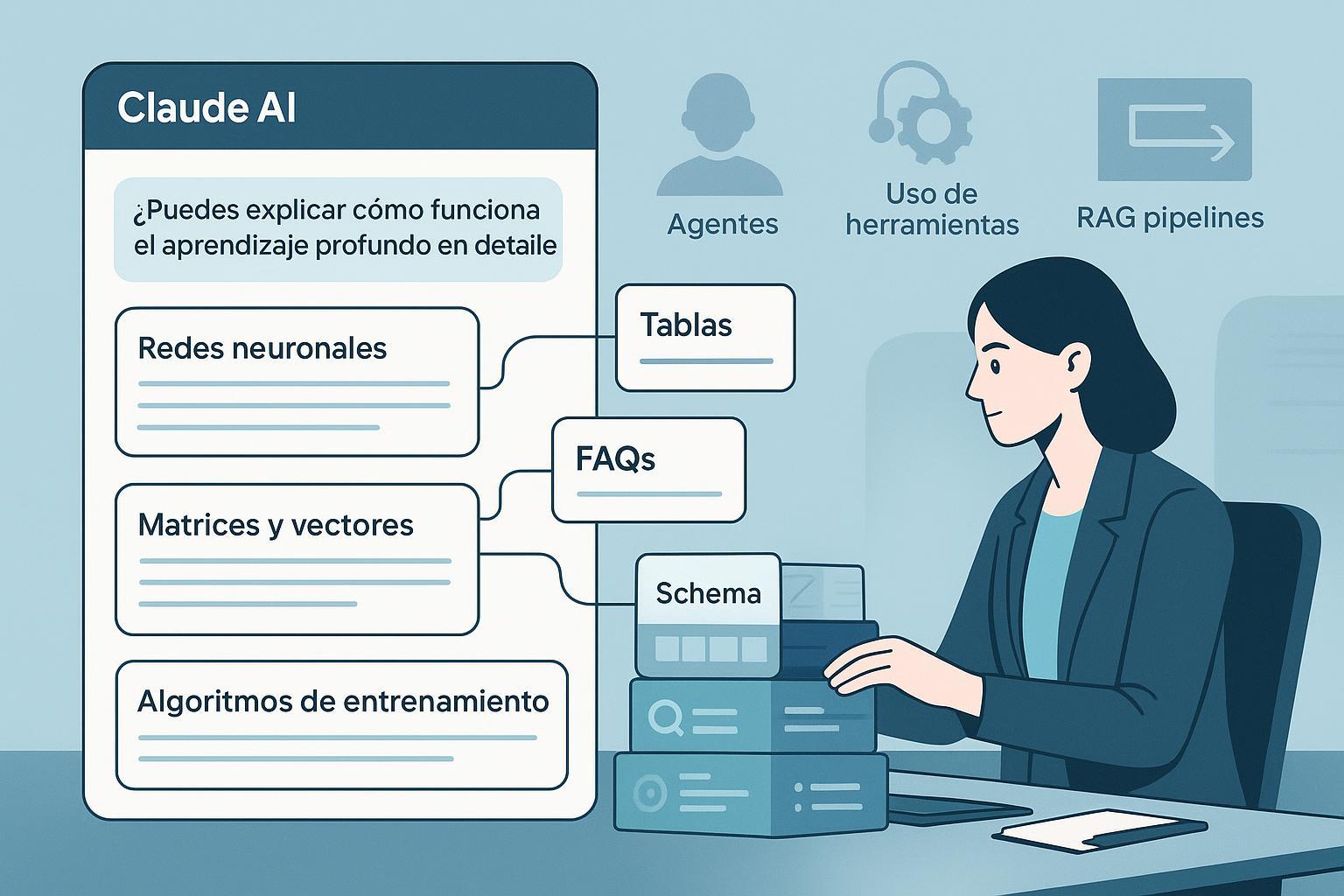

Claude ha evolucionado en 2025 hacia capacidades de agentes y uso avanzado de herramientas. Anthropic describe Sonnet 4.5 como su modelo más competente para “uso de computadora” y tareas prolongadas, lo que permite orquestar búsqueda y manejo de fuentes dentro de flujos agentic. Puedes revisarlo en “Claude Sonnet 4.5” (Anthropic, 2025) y en “Introducing advanced tool use on the Claude Developer Platform” (Anthropic, 2025).

Punto clave: la citación visible en la interfaz de consumo de Claude no está documentada como universal. En cambio, la atribución sólida aparece cuando el desarrollador implementa RAG/Tool Use y pasa resultados estructurados (título, URL, snippet) para que el modelo los cite. Por comparar, Perplexity sí muestra citaciones explícitas en su UI; puedes verlo en “Comenzando con Perplexity” (Perplexity, 2025). La implicación práctica es clara: diseña tu contenido para ser “extraíble y citable” y, si operas integraciones, estructura el flujo para que Claude tenga qué citar.

Framework de optimización específico para Claude

1) Contenido extraíble

- Resúmenes ejecutivos por tema con hechos verificables (fechas, cifras, definiciones breves).

- Listas numeradas y bullets para procesos; tablas comparativas cuando existan criterios claros.

- FAQs autocontenidas por pregunta: una respuesta clara, breve, con 1–2 fuentes primarias enlazadas.

- Metadatos visibles: autor, fecha de última actualización, metodología (cómo mediste o probaste).

Claude “lee” mejor contenido con estructura y señales de confianza. Un marco GEO en español sugiere consistencia de dominios de alta autoridad en la selección de fuentes, según “Generative Engine Optimization (GEO): El nuevo SEO” (Hi Experience, 2025).

2) Datos estructurados (Schema.org)

Trata el marcado como facilitador, no como garantía de cita. Prioriza:

- Article, FAQPage y HowTo donde aplique.

- Propiedades de autoría, fechas y referencia a fuentes primarias.

- Validación con Rich Results y tests manuales de extracción (¿tu contenido se puede copiar y pegar como bloque?).

No hay evidencia pública y robusta que cuantifique el impacto directo de Schema.org sobre citación en Claude. Aun así, mejora la legibilidad “machine‑readable” y reduce fricción para flujos RAG.

3) Autoridad y citabilidad

- Publica datos propios con metodología transparente; enlaza a fuentes originales con anclajes descriptivos.

- Asegura estabilidad de tus páginas (URLs, títulos, jerarquías) y coherencia multilingüe.

- Refuerza perfiles de autor y páginas “Cómo probamos/medimos”. Esto eleva E‑E‑A‑T y favorece que terceros (incluidos agentes y curadores) te seleccionen como referencia.

Para entender cómo los motores eligen marcas, resulta útil el contexto de “selección de marcas” que analiza dinámicas de mención; ver “Why ChatGPT Mentions Certain Brands” (Geneo, 2025).

4) Internacionalización

- Hreflang correcto y versiones sincronizadas.

- Terminología coherente ES/EN y glosario breve por vertical.

- Evita duplicidad canónica: define “página maestra” por idioma y usa enlaces internos consistentes.

5) Prompting y RAG (lo que sí funciona)

- System prompt: traslada instrucciones complejas (formato, citación esperada, tono) al system prompt.

- Few‑shot: añade 2–3 ejemplos de cómo citar y estructurar respuestas.

- Think tool y Tool Use: en flujos agentic, habilita herramientas de búsqueda y pasa resultados con metadatos (título, URL, snippet). La guía técnica está en “Introducing advanced tool use…” (Anthropic, 2025).

- Grounding: evita que el modelo “fabrique” referencias obligando a citar solo de la lista de resultados proporcionados.

KPIs y medición

Define métricas antes de optimizar; así sabrás si el esfuerzo tiene retorno. Dos recursos amplían el marco de medición operativa: “AI Search User Behavior 2025” (Geneo, 2025) y “LLMO Metrics” (Geneo, 2025).

| KPI | Definición | Cómo medir |

|---|---|---|

| Share of answer | Porcentaje de consultas donde tu marca aparece mencionada/citada en la respuesta | Panel propio o auditorías periódicas de prompts (cohortes por tema/idioma) |

| Tasa de citación | Ratio de respuestas de Claude que incluyen tu dominio como fuente | Registro de capturas y logs; control por versión de modelo |

| Cobertura por consulta | Nº de queries donde apareces vs. universo objetivo | Listas de queries, agrupación por intención y vertical |

| Sentimiento | Polaridad de menciones (positivo/neutral/negativo) | Análisis semántico con reglas; revisión humana |

| Frescura | Tiempo desde la última actualización del contenido citado | Metadatos de fecha + auditoría trimestral |

Workflow de monitorización y experimentación

- Diseña cohortes de 50–100 queries por tema y país/idioma; establece un periodo de prueba de 6–8 semanas.

- Registra baseline (antes) y realiza cambios controlados: estructura de páginas, FAQs, marcado, actualización de datos.

- Captura evidencias: screenshots de respuestas, logs de prompts, notas de versión de modelo.

- Analiza variaciones por versión de Claude (Sonnet/Opus) y por idioma.

Ejemplo neutral de herramienta: para centralizar tracking y comparar “share of answer” y tasa de citación en motores/idiomas, algunos equipos usan plataformas de visibilidad IA. Geneo ofrece dashboards y métricas orientadas a respuestas generativas; puede servir para registrar cambios y comparar cohortes sin sesgo promocional.

Errores comunes (y cómo evitarlos)

- Confiar en citación automática: sin RAG/Tool Use, la atribución es inconsistente. Obliga a citar con resultados de herramienta estructurados y system prompt.

- Contenido sin autoría ni fuentes: agrega autor, metodología y enlaces primarios con anclajes descriptivos.

- Marcar todo con schema sin validación: prioriza FAQ/HowTo/Article y verifica extracción real (bloques autocontenidos, tablas claras).

- Ignorar multilingüe: sin hreflang y coherencia terminológica, tu marca se diluye; mantén versiones sincronizadas.

- Medir “de oído”: define KPIs y periodos; registra antes/después con capturas y logs.

Roadmap 2025/2026: qué vigilar

- Cambios de modelos y deprecaciones en Anthropic: revisa “Release notes” (Claude Docs, 2025) para adaptar tus pruebas.

- Evolución de Tool Use y Agent SDK: busca mejoras que afecten recuperación, navegación y citación. Ver “Building agents with the Claude Agent SDK” (Anthropic, 2025).

- Comparativas con motores que sí citan en UI (Perplexity) para ajustar expectativas del equipo y del reporting.

- Señales GEO: estabilidad de dominios con autoridad y consistencia entre idiomas, según Hi Experience (2025).

Recursos recomendados

- Marco y capacidades técnicas: “Introducing advanced tool use…” (Anthropic, 2025) y “Claude Sonnet 4.5” (Anthropic, 2025).

- Contexto GEO en español: “Generative Engine Optimization (GEO): El nuevo SEO” (Hi Experience, 2025).

- Citación visible en UI para contraste: “Comenzando con Perplexity” (Perplexity, 2025).

- Métricas operativas y comportamiento de usuarios: “LLMO Metrics” (Geneo, 2025) y “AI Search User Behavior 2025” (Geneo, 2025).

Próximos pasos

- Selecciona 2–3 verticales y define cohortes de queries.

- Audita tus páginas clave: estructura, FAQs, tablas, schema validado; añade autoría y metodología.

- Implementa pruebas con RAG/Tool Use (si operas integraciones): obliga a citar con metadatos y ejemplos few‑shot.

- Mide KPIs cada 2 semanas y documenta versiones de modelos.

Disclosure: este artículo menciona Geneo como ejemplo informativo de herramienta de seguimiento de visibilidad IA, sin trato promocional ni compensación.