Cómo medir el sentimiento en respuestas de IA (2025): guía práctica y herramientas

Aprende cómo medir el sentimiento en respuestas de IA con las mejores herramientas y estrategias 2025. Guía paso a paso con dashboards y alertas.

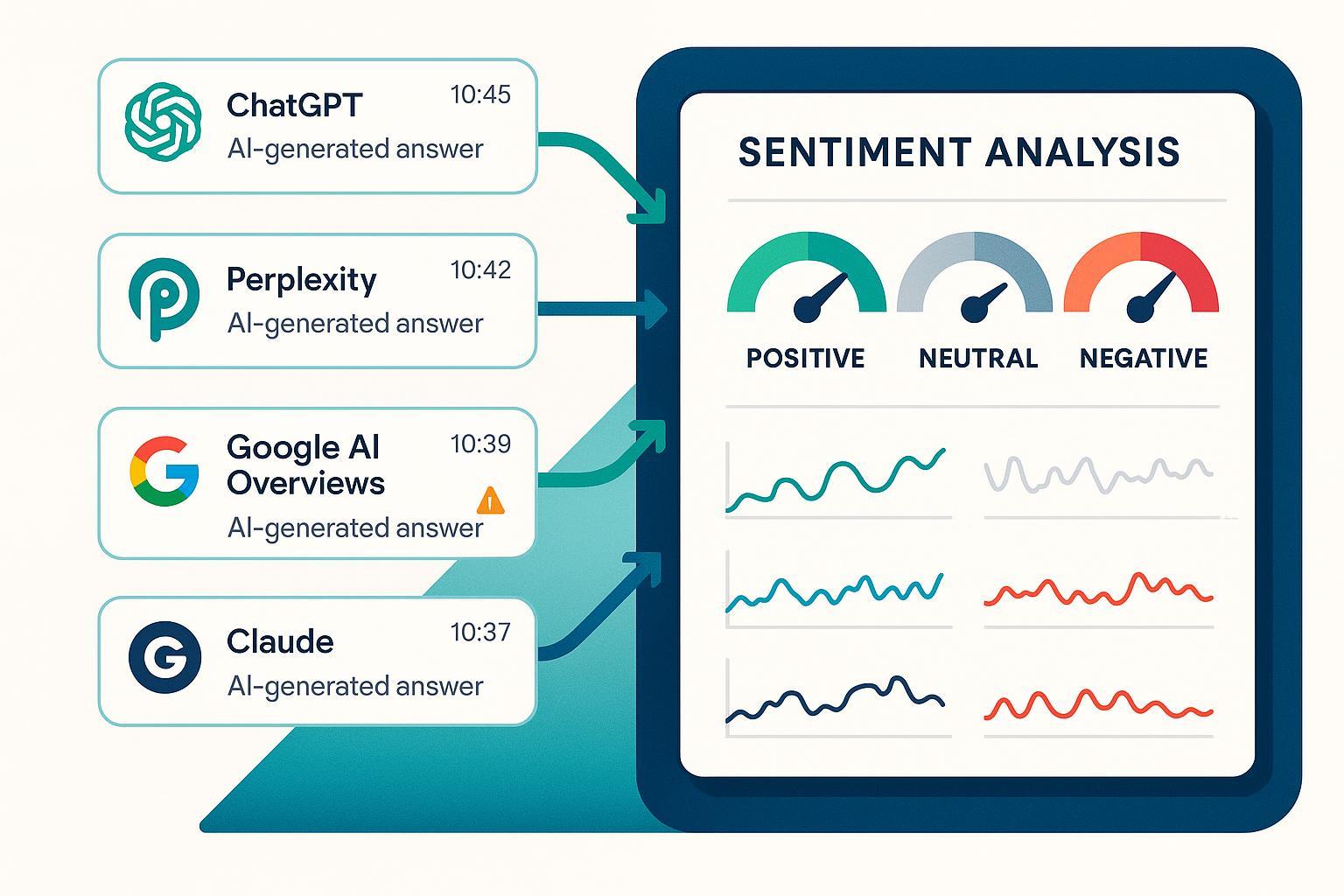

¿Tu marca aparece en respuestas de LLMs, AI Overviews o asistentes como Perplexity, y no sabes si el tono te favorece o te perjudica? En esta guía paso a paso montarás, en 60–120 minutos, un pipeline funcional para: (a) recolectar respuestas de IA relevantes, (b) clasificar su sentimiento a nivel de documento, oración y aspecto, (c) validar con métricas y revisión humana, (d) visualizar tendencias y (e) configurar alertas accionables.

- Dificultad: intermedia (rutas sin código, bajo código y con código)

- Requisitos previos: cuenta en una nube (opcional), Python 3.10+ (para la ruta open-source), acceso a una herramienta SaaS si eliges no-code, 50–200 ejemplos etiquetados para validar

- Canales cubiertos: ChatGPT/Claude/Gemini, Perplexity, Google AI Overviews, chatbots propios

Nota rápida sobre 2025: la API de sentimiento de AWS sigue siendo estable y multilingüe, Google mantiene score y magnitud en su NL API, Azure impulsa sentiment y opinion mining con su servicio Language, y los modelos Gemini 2.5 facilitan evaluaciones tipo LLM‑as‑a‑Judge. Verifica límites y precios antes de desplegar.

Paso 1: Define objetivos, cobertura y KPIs

Decide qué preguntas quieres responder y cómo medirás el éxito.

- Objetivos típicos

- ¿Cómo describen los LLMs mi marca por plataforma y país?

- ¿Qué tono asignan a categorías/atributos (precio, soporte, calidad)?

- ¿Cuándo debo activar una respuesta o campaña correctiva?

- Alcance

- Canales: ChatGPT, Claude, Gemini, Perplexity, AI Overviews, chatbot propio

- Idiomas/regiones: ES/EN al inicio; añade mercados prioritarios después

- Granularidad: documento, oración, y por aspecto/entidad

- KPIs de calidad

- F1 macro ≥ 0,75 en validación interna (datasets desbalanceados)

- Acuerdo humano (Cohen’s kappa) ≥ 0,6 en muestra doble

- Calibración razonable (ECE < 0,1 si usas probabilidades)

- KPIs de negocio

- % de alertas accionables/semana, tiempo de respuesta a crisis, variación de tono por plataforma

Checkpoint

- Tienes una hoja con: canales, idiomas, granularidad, umbrales de acción (p. ej., “alerta si el promedio semanal baja 0,2 puntos o el % negativo sube +10 pp”).

Paso 2: Recolecta respuestas de IA y normaliza metadatos

Captura texto y metadatos consistentes: prompt, modelo, versión, timestamp, fuente/plataforma, idioma/región y, cuando aplique, citas.

Rutas posibles

- Directo por API

- OpenAI (Chat): consulta, guarda respuesta y headers útiles; referencia de API en OpenAI Chat API reference (2024–2025).

- Anthropic (Claude): usa su API y registra modelo/versión; revisa las release notes de la API de Anthropic (2025).

- Google Gemini: gestiona versiones y regiones en Vertex; consulta Versionado de modelos Gemini 2.5 en Vertex AI (2025).

- Perplexity: su API oficial (Sonar/Sonar Pro) devuelve respuestas con citas; ver introducción a Sonar Pro API (2025).

- No‑code/SaaS para descubrimiento y tracking multi‑IA

- Si necesitas centralizar menciones y citas de marca en ChatGPT, Perplexity y AI Overviews con histórico y sentimiento, configura un proyecto en Geneo. Define marcas/competidores, palabras clave y mercados; Geneo agregará respuestas, calculará sentimiento y guardará el historial para comparación temporal y multi‑marca (ver detalles en https://geneo.app).

Buenas prácticas

- Guarda texto bruto y una versión limpiada (sin HTML, normalizada de espacios)

- Registra idioma detectado (lo necesitarás para rutas multilingües)

- Evita duplicados con IDs de petición y hashes del contenido

Checkpoint

- Tienes un datastore con campos: source, prompt, model, timestamp, lang, text, citations (opc.), region.

Paso 3: Elige tu stack (árbol de decisión rápido)

- ¿Quieres ir sin código y centrarte en monitoreo y acciones?

- Usa una plataforma SaaS. Para IA multi‑fuente, Geneo simplifica descubrimiento, sentimiento, dashboards y alertas.

- ¿Buscas bajo código con SLA y escalabilidad?

- APIs cloud:

- Amazon Comprehend ofrece cuatro clases (positive/negative/neutral/mixed) y scores por clase; consulta DetectSentiment de Amazon Comprehend (AWS, 2025).

- Google Cloud NL provee score (−1 a +1) y magnitud por documento/oración; ver Analyze Sentiment en Google Cloud Natural Language (2025).

- Azure AI Language aporta sentiment y opinion mining (aspectos/targets); revisa Sentiment analysis y opinion mining en Azure Language (2025).

- APIs cloud:

- ¿Necesitas control total o POC técnico con presupuesto ajustado?

- Open‑source con Transformers (Hugging Face) y despliegue ligero.

Considera cumplimiento, latencia, coste por volumen, y soporte multilingüe antes de decidir.

Paso 4: Implementa el análisis de sentimiento base

Ruta open‑source (mínimo viable en Python)

# Requiere: pip install transformers torch

from transformers import pipeline

# Modelo español (BETO) y multilingüe ligero

sentiment_es = pipeline("sentiment-analysis", model="dccuchile/bert-base-spanish-wwm-cased")

sentiment_multi = pipeline("sentiment-analysis", model="distilbert-base-multilingual-cased")

print(sentiment_es("Me encanta este producto, es excelente."))

print(sentiment_multi("I love this product, it's amazing."))

- BETO: ver dccuchile/bert-base-spanish-wwm-cased en Hugging Face

- Multilingüe distilBERT: ver distilbert-base-multilingual-cased (Hugging Face)

Ruta cloud (conceptos clave)

- AWS Comprehend retorna etiqueta y SentimentScore por clase; detalla límites y precios en Límites de Amazon Comprehend (2025) y Precios de Comprehend (AWS, 2025).

- Google Cloud NL devuelve score (−1 a +1) y magnitud por sentencia/documento; ver Analyze Sentiment (Google, 2025).

Interpretación de scores y umbrales

- AWS: usa la probabilidad por clase; define threshold (p. ej., Positive ≥ 0,7).

- Google NL: combina score con magnitud (p. ej., score ≤ −0,3 y magnitud ≥ 0,5 = negativo significativo).

Checkpoint

- Obtienes etiquetas coherentes en ES/EN con distribución razonable (no >80% neutral salvo que el corpus lo justifique).

Paso 5: Añade análisis por aspecto y maneja ironía/sarcasmo

Análisis por aspecto/entidad (opinion mining)

- Útil para saber “qué” causa el sentimiento (precio, soporte, UX). Azure ofrece extracción de opiniones con targets/aspectos; consulta Sentiment y opinion mining en Azure Language (2025).

Ironía y sarcasmo (rutas)

- Clasificador auxiliar: emplea un modelo enfocado al sarcasmo en ES cuando esté disponible; como referencia académica/datasets, revisa SemEval‑2018 Task 3: Irony Detection y el dataset SARC de Reddit (Princeton).

- LLM‑as‑a‑Judge: en casos ambiguos, evalúa con una rúbrica explícita (positivo/negativo/neutral) y justificación breve. Puedes usar Gemini 2.5 en Vertex AI siguiendo el control de versiones descrito en Versionado de modelos Gemini 2.5 (2025).

Heurística práctica

- Si detector de ironía = probable, reduce la confianza del clasificador y deriva a LLM‑as‑a‑Judge + revisión humana.

Checkpoint

- Tienes ejemplos por aspecto con etiquetas consistentes y casos irónicos derivados a revisión.

Paso 6: Valida la calidad con métricas y revisión humana

Establece un set “gold” de 50–200 ejemplos, muestreo estratificado por clase e idioma. Evalúa:

- Métricas de clasificación

- Exactitud, precision/recall y F1 macro/micro; guía en el Google ML Crash Course sobre precisión/recall (2024–2025) y ROC/AUC y curvas PR.

- Implementaciones listas en scikit‑learn: evaluación de modelos.

- Acuerdo humano

- Cohen’s kappa ≥ 0,6 (bueno); usa doble anotación en un 20–30%.

- Calibración

- Si expones probabilidades al negocio (p. ej., para umbrales), estima ECE y corrige si es necesario.

Criterios de salida

- F1 macro ≥ 0,75 y kappa ≥ 0,6. Si no, ajusta umbrales, mejora datos (few‑shot o fine‑tuning) o añade LLM‑as‑a‑Judge.

Paso 7: Visualiza, monitoriza y configura alertas

Visualización y agregados

- Por plataforma (ChatGPT/Perplexity/AI Overviews), por consulta y por país/idioma.

- Métricas: % positivo/negativo, score medio, distribución por aspecto, variación semanal.

Rutas

- No‑code con Geneo

- Centraliza sentimiento por plataforma/consulta/periodo, compara marcas y configura alertas por umbral/variación. Útil para reputación, SEO y visibilidad en IA. Su panel histórico facilita auditoría y “antes/después” de campañas. Más info en https://geneo.app.

- Dashboards propios

- Looker Studio/Power BI con tu datastore. Define benchmarks y zonas de alerta (p. ej., “rojo” si negativo >25% por dos semanas consecutivas).

Playbooks de acción

- Si AI Overviews vira a negativo: actualizar contenidos clave, FAQs y páginas E‑E‑A‑T; coordinar PR.

- Si Perplexity cita fuentes desfavorables: producir piezas comparativas con datos y casos; fomentar documentación oficial.

Checkpoint

- Cuentas con un dashboard operativo y al menos una alerta activa (p. ej., email/Slack) con umbral claro.

Paso 8: Opera y mantén el sistema

- Drift y salud

- Revisa mensualmente cambios de tema/jerga; re‑etiqueta 5–10% y recalibra umbrales.

- Privacidad y cumplimiento

- Minimiza PII; respeta términos de cada plataforma y residencia de datos.

- Mantenimiento de modelos

- Si usas open‑source, programa re‑entrenos/fine‑tuning trimestrales; si usas cloud, revisa notas de producto (p. ej., cambios de modelos Gemini o Azure).

Solución de problemas (rápido)

- Demasiados “neutral”

- Revisa segmentación por oración; ajusta umbrales (Google NL: considera magnitud). Añade few‑shot o modelo adaptado al dominio.

- Falsos positivos por ironía

- Integra un detector y/o deriva a LLM‑as‑a‑Judge con rúbrica y justificación. Usa muestras de control inspiradas en SemEval‑2018 Irony Detection.

- Mezcla de idiomas

- Detecta idioma antes; usa modelos específicos (ES/EN) o multilingües (distilBERT m‑cased).

- Ruido por scraping/citas

- Filtra quotes/líneas no originales; separa texto del modelo vs. texto citado.

- Límites/tarifas API

- Consulta los límites y costes: por ejemplo, Límites de Amazon Comprehend (2025) y precios en AWS Comprehend Pricing.

Checklist imprimible (resumen)

- [ ] Objetivos y KPIs claros; umbrales definidos

- [ ] Fuentes configuradas (APIs o Geneo) con metadatos normalizados

- [ ] Clasificador base funcionando (cloud u open‑source)

- [ ] Aspectos/targets y manejo de ironía definidos

- [ ] Validación con F1/kappa y calibración si aplica

- [ ] Dashboard operativo y alertas activas

- [ ] Playbooks de acción documentados

- [ ] Rutina mensual de mantenimiento/drift

¿Cuándo tiene sentido usar Geneo?

- Quieres descubrir y monitorizar de forma continua cómo los LLMs y AI Overviews presentan tu marca y competidores, sin construir integraciones múltiples.

- Necesitas sentimiento consolidado por plataforma/consulta/periodo, con histórico, comparación multi‑marca y alertas listas.

- Tu prioridad es la acción (contenido, PR, SEO/AI visibility) más que la ingeniería del pipeline.

Geneo centraliza detección de menciones/citas de marca en ChatGPT, Perplexity y AI Overviews, añade análisis de sentimiento con tendencias, y ofrece paneles y alertas para actuar a tiempo. Puedes empezar con una prueba gratuita en https://geneo.app y mantener un POC open‑source en paralelo para investigación interna.

Referencias clave citadas

- Amazon Comprehend — DetectSentiment (AWS, 2025); Límites de servicio (AWS, 2025); Precios Comprehend

- Google Cloud — Analyze Sentiment (Natural Language, 2025)

- Google Vertex AI — Versiones de modelos Gemini 2.5 (2025)

- Microsoft Azure — Sentiment analysis y opinion mining (Language Service, 2025)

- OpenAI — Referencia de API de Chat (2024–2025)

- Anthropic — Notas de lanzamiento de la API (2025)

- Perplexity — Introducción a Sonar Pro API (2025)

- Hugging Face — BETO español; distilbert-base-multilingual-cased

- Métricas — Google ML Crash Course: precisión/recall; ROC y AUC; scikit‑learn: evaluación