Wie RAG-Systeme GEO-Signale in der KI-Suche beeinflussen

GEO-Signale & RAG: So optimieren Sie Sichtbarkeit und Zitation in AI Overviews, Perplexity & ChatGPT. Entitäten & RAG-Hebel praxisnah erklärt.

Warum zitiert eine KI-Antwort Ihre Seite – und eine andere nicht? Wer in AI Overviews, Perplexity oder ChatGPT sichtbar sein will, optimiert nicht mehr nur klassische Rankings. Es geht um Zitationen, nachvollziehbare Provenienz und klare Entitäten. Genau hier treffen sich GEO (Generative Engine Optimization) und die technischen Stellschrauben von RAG (Retrieval‑Augmented Generation).

GEO‑Signale in KI‑Suche – was zählt wirklich?

GEO bündelt alle Signale, die die Wahrscheinlichkeit erhöhen, in generativen Antworten aufzutauchen und sauber zitiert zu werden: eindeutige Autorenschaft, Entitäten‑Klarheit, strukturierte Daten, aktuelle Belege und präzise, zitierfähige Passagen. Ein praxisnaher Überblick, wie GEO sich vom SEO‑Denken unterscheidet, findet sich im Beitrag „SEO vs. GEO“ mit Beispielen für Messgrößen und Monitoring der LLM‑Antwortsichtbarkeit: Vergleich SEO vs. GEO (Geneo, Hintergrundartikel).

Branchenressourcen ordnen GEO inzwischen als eigenes Arbeitsfeld. Einen soliden Einstieg bietet der SEMrush‑Überblick zu Generative Engine Optimization. Und auch Google verweist für den Erfolg in KI‑Funktionen auf Grundprinzipien wie hilfreiche Inhalte, klare Struktur, gute Page Experience und sinnvolle Steuerungsmöglichkeiten. Siehe dazu Googles „Succeeding in AI search experiences“ (2025).

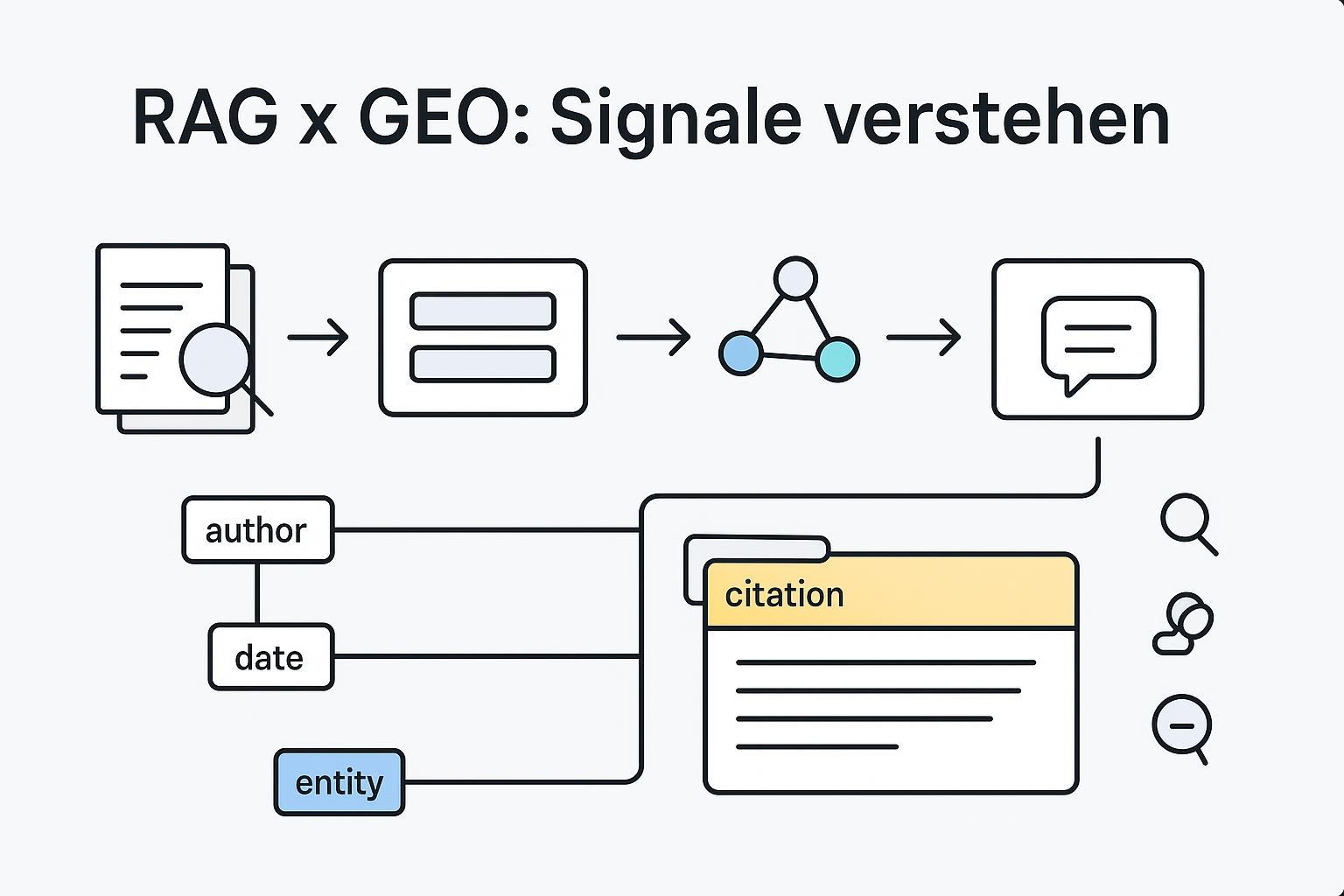

Die RAG‑Pipeline als Hebel für GEO

Denken Sie RAG wie eine Lieferkette: Rohdaten werden indexiert, in handliche „Pakete“ (Chunks) geteilt, gezielt abgerufen, qualitativ neu gerankt und am Ende mit Quellenangaben ausgegeben. Jede Stufe verstärkt – oder schwächt – GEO‑relevante Signale.

Indexierung und Metadaten

Was nicht präzise erfasst ist, kann nicht präzise zitiert werden. Bewährt haben sich persistente IDs pro Dokument und Abschnitt, vollständige Metadaten (Autor:in, Datum, Lizenz, URL, Entitäten/IDs), Abschnitts‑ oder Absatz‑Anker (Heading‑IDs, Paragraph‑IDs) sowie – bei PDFs – optionale „Bounding Boxes“. Ergebnis: robuste Provenienz und exakte Zitieranker, die später im Output sauber aufgelöst werden können.

Chunking, das Zitate ermöglicht

Chunk‑Größe, Überlappung und semantische Grenzen entscheiden, ob ein Abschnitt in sich stimmig und zitierfähig ist. Zu groß – Kontext verschwimmt; zu klein – Aussage wird zerrissen. Empfehlenswert ist ein experimentelles Tuning mit semantischen Splits und moderater Überlappung. Praxisnahe Hinweise liefert der Beitrag „Efficient Chunk Size Optimization for RAG Pipelines“ von LlamaIndex.

Retrieval: hybrid statt entweder‑oder

Hybrid‑Retrieval (Sparse + Dense) kombiniert die Stärken beider Welten. In der Praxis wichtig sind BM25 plus Vektor‑Suche (feinjustiert, z. B. via Alpha‑Tuning), Filter nach Metadaten (Datum, Autor:in, Entitäten) und „Boosts“ für autoritative, frische Quellen. So steigt die Chance, dass wirklich relevante und aktuelle Passagen im Kontext landen – die Voraussetzung für Zitationen.

Reranking: Qualität vor Quantität

Nach der ersten Trefferliste lohnt eine zweite, kontextbewusste Bewertung mit Cross‑Encodern oder LLM‑Reranking. Das erhöht die Präzision der Top‑Kandidaten, kostet aber Latenz und Budget. Eine gute Einordnung bietet der technische Überblick „Level up your GenAI apps: Advanced RAG techniques“ (Unstructured).

Citation‑aware Prompting und Output‑Schemata

Die Generationsphase sollte Quellenangaben erzwingen statt „optional“ zu belassen. Bewährt haben sich die Metadaten‑Durchreichung vom Index bis zum Output (Chunk‑IDs, Seitenzahlen, Entitäts‑IDs), strukturierte Output‑Felder (z. B. JSON‑Array mit {chunk_id, url, title, author, date}) sowie Post‑Validation/QA, um fehlerhafte Zuordnungen zu korrigieren. Ein praktikabler Einstieg in die Prinzipien bietet Tensorlakes „RAG citations“. Für Content‑Teams auf der Webseite gilt parallel: Inhalte so bauen, dass KIs leicht zitieren können – konkrete Schritte beschreibt der Leitfaden „Inhalte für KI‑Zitationen optimieren“ (Geneo, Praxisleitfaden).

App‑Schicht: Von Chunk‑ID zum klickbaren Link

Die letzte Meile entscheidet über Sichtbarkeit. Mappen Sie Chunk‑IDs deterministisch auf kanonische URLs und sichtbare Anker (Abschnitt/Headline). Stellen Sie sicher, dass Titel, Autor:in und Datum in der Antwort angezeigt und klickbar sind. UX‑Details wie Link‑Position und ‑Beschriftung beeinflussen, ob Nutzer die Quelle überhaupt wahrnehmen.

| RAG‑Hebel | Technische Maßnahme | GEO‑Signalwirkung |

|---|---|---|

| Index/Metadaten | Persistente IDs, Autor:in, Datum, Entitäten, Abschnitts‑Anker | Nachvollziehbare Provenienz, exakte Zitieranker |

| Chunking | Semantische Splits, moderate Überlappung, evaluiertes Format | Höhere Zitierpräzision, weniger Fehlattribution |

| Hybrid‑Retrieval | BM25 + Vektor, Filter/Boosts, Tuning | Bessere Relevanz, Autoritäts‑ und Freshness‑Gewichtung |

| Reranking | Cross‑Encoder/LLM Re‑Score | Qualitativere Top‑Kontexte, höhere Zitatwahrscheinlichkeit |

| Citation‑aware | Metadaten‑Durchreichung, strukturiertes Output, QA | Vertrauenswürdige, klickbare Attribution |

Plattformnotizen: AI Overviews, Perplexity, ChatGPT

Google beschreibt kein „Sonder‑Schema“ für AI Overviews, sondern betont allgemeine Qualitäts‑ und Zugänglichkeitsprinzipien; siehe Googles Leitfaden zu KI‑Suche‑Erfahrungen. Beobachtungen aus Branchenanalysen zeigen, dass AI Overviews in einem großen Anteil der Suchergebnisse erscheinen; als eine dokumentierte Tendenz gilt etwa die SEJ‑Analyse zu „47 % Sichtbarkeit“. Für GEO heißt das: Inhalte müssen überprüfbar, entitätsklar und aktuell sein – und in Formaten vorliegen, die sich zuverlässig zitieren lassen.

Perplexity stellt Quellen prominent dar und unterstützt unterschiedliche Recherchemodi. Das erhöht Chancen für Marken, wenn Aussagen modular und prüfbar sind. ChatGPTs Zitier‑ und Linkverhalten variiert je nach Modus und Datenzugriff; saubere Provenienz in Ihrem Content bleibt dennoch der beste Anker.

Messen und optimieren: KPIs und Tests

Ohne Messung kein Fortschritt. Welche Kennzahlen zeigen, ob Ihre RAG‑ und GEO‑Maßnahmen wirken? Zitierhäufigkeit (wie oft wird Ihre Domain pro Query‑Set genannt), Link‑Attributionsrate (Anteil mit klickbarem Link), Freshness‑Index (Anteil aktueller Quellen), Entity‑Match‑Rate (korrekte Entitätserkennung) und AIO‑Sichtbarkeit (Präsenz/Position in AI Overviews) bilden den Kern. Für die Optimierung empfehlen sich kontrollierte Experimente: Chunk‑Größe und Überlappung variieren (z. B. 300/600/1.000 Token), Hybrid‑Retrieval gegen „nur dense“ testen, Reranking an/aus bzw. verschiedene Modelle vergleichen (Qualität vs. Latenz/Kosten) und das Citation‑aware Output‑Schema mit/ohne Zwangsfelder evaluieren. Eine strukturierte Vorgehensweise beschreibt der Beitrag „AI‑Visibility‑Audit für Ihre Marke“ (Geneo, Audit‑Leitfaden).

Praxisbeispiel: Zitier‑Feedback‑Loop mit Monitoring

Hinweis: Geneo ist unser eigenes Produkt. In einem typischen Workflow speist ein Team neue, gut strukturierte Fachartikel in die RAG‑Pipeline ein (inkl. Autor:in, Datum, Entitäten und Abschnitts‑IDs). Nach dem Roll‑out werden Query‑Sets für die wichtigsten Use Cases definiert und über mehrere Wochen überwacht. Steigt die Zitierhäufigkeit in Perplexity oder erscheinen neue Links in AI Overviews, werden die zugrunde liegenden RAG‑Parameter (Chunk‑Größe, Reranking, Filter) dokumentiert. Fallen Zitationen aus, dient das als Trigger für Reindexing, Schema‑Nachbesserungen oder die Ergänzung primärer Belege. So entsteht ein kontinuierlicher Feedback‑Loop zwischen Content, RAG‑Design und GEO‑Ergebnissen – messbar und wiederholbar.

Risiken und Guardrails

- Halluzinationen/Fehlzitate: Ohne Metadaten‑Durchreichung und QA können Quellen falsch zugeordnet werden. Setzen Sie auf deterministische ID‑Mappen und Post‑Validation.

- Reranker‑Bias, Latenz und Kosten: Höhere Präzision ist nicht gratis – messen Sie, ab wann sich der Zusatzaufwand lohnt.

- Provider‑Unterschiede: Zitations‑ und Linkdarstellung variiert zwischen Plattformen; testen Sie plattformspezifisch.

- Recht/Lizenzen: Indizieren Sie nur Quellen, die Sie rechtlich nutzen dürfen; dokumentieren Sie Provenienz und Lizenzstatus.

Nächste Schritte

- Starten Sie mit einem kompakten Audit Ihrer Inhalte und Metadaten.

- Planen Sie Experimente entlang der RAG‑Kette (Chunking, Retrieval, Reranking, Output‑Schema).

- Versionieren Sie Ihre Schemata und halten Sie einen Change‑Log für Reindexing und Prompt‑Änderungen.

Kurz gesagt: GEO‑Erfolg in generativen Antworten ist kein Zufall. Er entsteht dort, wo technische RAG‑Entscheidungen und inhaltliche Qualität zusammenkommen – sichtbar, zitierbar, überprüfbar.