Confidence Scoring für Marken-Nennungen in KI-Systemen

Was ist Confidence Scoring in KI? Definition, Entity Linking, Schwellenwerte & Praxis für zuverlässige Marken-Nennungen im Monitoring.

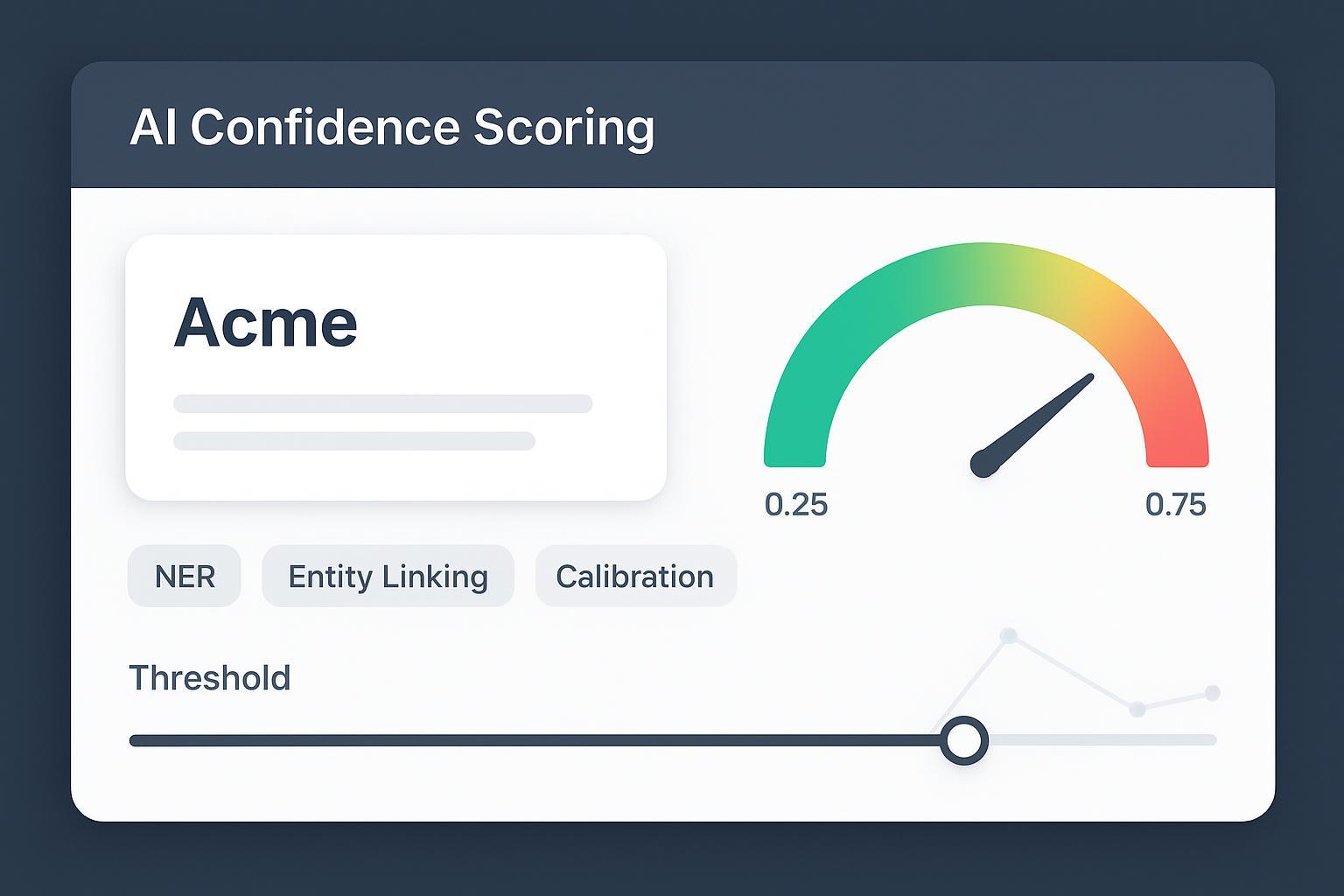

Wie sicher ist eine Marken‑Nennung in einer Antwortmaschine wirklich? Genau hier setzt das Konzept des Confidence Scoring an: Ein numerischer Wert (typisch 0–1), der ausdrückt, wie sicher ein System eine Erwähnung erkannt und der richtigen Marke zugeordnet hat. In generativen Antworten, AI Overviews und Such‑Assistenten steuert dieser Wert, ob eine Marke angezeigt, verlinkt oder zur manuellen Prüfung weitergeleitet wird.

Was „Confidence“ bei Marken‑Nennungen bedeutet

„Confidence“ ist kein Bauchgefühl, sondern ein technischer Wahrscheinlichkeitswert. In einer typischen Pipeline markiert die Named Entity Recognition (NER) zunächst einen Textspan als potenzielle Marke. Danach ordnet Entity Linking (EL) diesen Span einer konkreten Entität (etwa einem Marken‑Eintrag) zu. Abschließend entscheidet das Antwortsystem anhand des Konfidenzwerts und verfügbarer Evidenz, ob angezeigt, verlinkt oder unterdrückt wird.

Microsoft beschreibt die Rolle solcher Konfidenzwerte in verschiedenen Diensten sehr klar – Werte zwischen 0 und 1, höhere Zahlen bedeuten höhere Sicherheit, und Schwellen können je nach Use Case angepasst werden; siehe die Erklärung zur Genauigkeit und Konfidenz in der Dokumentation „Accuracy & Confidence“ für Azure Document Intelligence. Ein ähnliches 0–1‑Verständnis findet sich auch im Computer‑Vision‑Kontext, z. B. im Ultralytics Glossar „Confidence“.

Wichtig ist die Abgrenzung: Intent‑Confidence (Conversational AI) bewertet die Sicherheit einer Intent‑Erkennung, nicht die Markenzuordnung. Relevanzscores in Information Retrieval bewerten, wie „passend“ ein Dokument ist, nicht, ob eine Marke korrekt erkannt/verlinkt wurde. Token‑Wahrscheinlichkeiten in LLMs entstehen auf Zeichen/Wort‑Ebene; für Marken braucht es zusätzlich Sequenz‑Scores und eine saubere Entitätszuordnung.

Zur weiteren Begriffseinordnung im Umfeld der generativen Suche lohnt sich der Beitrag „Neue SEO Abkürzungen: GEO, GSVO, GSO, AIO & LLMO erklärt“ (Geneo).

Wo die Scores herkommen: Logits, Softmax, Sequenz‑ und Linking‑Signale

Unter der Haube erzeugen Modelle zunächst rohe Scores („Logits“). Eine Softmax‑Transformation macht daraus Wahrscheinlichkeiten zwischen 0 und 1. Bei NER wird über die Tokens einer Erwähnung aggregiert – je nach Modell minimaler Token‑Score, Mittelwert oder ein eigener Span‑Score. Bei Entity Linking werden Kandidaten erzeugt (Wissensbasis, Register, Wikipedia/Wikidata), mit mehreren Signalen gerankt und anschließend in eine Konfidenz überführt:

- Mention‑Score (Oberflächenähnlichkeit, Zeichenketten‑Ähnlichkeit)

- Prior P(e|m) (wie häufig ein Surface‑Form zu einer Entität führt)

- Kontext‑Ähnlichkeit (lexikalisch und semantisch über Embeddings/Transformer)

Die Kombination dieser Signale ist gut dokumentiert, z. B. in „Named Entity Recognition for Entity Linking: What Works …“ (ACL Findings 2021). Einen Pipeline‑Überblick mit Schwellen/NIL‑Entscheidung bietet ergänzend „Entity linking“ auf Wikipedia.

So viel vorweg: Roh‑Wahrscheinlichkeiten sind oft schlecht kalibriert. Post‑hoc‑Kalibrierung (z. B. Platt Scaling, Isotone Regression, Temperature Scaling) verbessert die Interpretierbarkeit, ohne das Modell neu zu trainieren. Die Güte misst man u. a. mit Expected Calibration Error (ECE) und Reliability‑Plots. Praxisnah diskutiert wird Schwellen‑Gating und Review‑Routing etwa in Mindees „How to use confidence scores in ML models“; Microsoft adressiert Schwellen und Limitierungen in den Transparency Notes zum NER im Language Service.

Schwellenwerte festlegen: Präzision, Recall und Kosten gegeneinander abwägen

Es gibt keinen universellen „richtigen“ Cutoff. Stattdessen wählen Teams betriebliche Schwellen anhand ihrer Daten und Ziele: Maximieren Sie eine Zielmetrik (z. B. F1), wählen Sie einen Punkt auf der Precision‑Recall‑Kurve (bei unausbalancierten Daten oft aussagekräftiger als ROC) oder minimieren Sie eine Kostenfunktion (C = CFP·FP + CFN·FN) je nach Fehlalarm‑ und Verpassungs‑Risiko.

Ein praktikables, klar als Heuristik gekennzeichnetes Schema sieht z. B. so aus:

| Confidence‑Bereich | Entscheidung | Aktion | Hinweise |

|---|---|---|---|

| ≥ 0,80 | Auto‑Akzept | Anzeige/Verlinkung | Kanal‑/Domänenabhängig testen |

| 0,50–0,79 | Review erforderlich | Manuelle Prüfung/Verifikation | Review‑Last aktiv steuern |

| < 0,50 | Verwerfen/NIL | Nicht anzeigen, NIL verlinken | Ambiguität und Alias prüfen |

Diese Buckets müssen pro Kanal (z. B. AI‑Overviews vs. Chat‑Assistent) und Sprache empirisch justiert werden – mit Histogrammen, PR‑Analysen und A/B‑Tests. Ein guter Ausgangspunkt sind die Empfehlungen zu Schwellen‑Gating in den oben genannten Microsoft‑Hinweisen und der Mindee‑Praxisleitfaden.

Validierung und Monitoring: Metriken, Re‑Kalibrierung und Drift

Ohne belastbare Messung bleibt Confidence nur eine Zahl. Führen Sie gelabelte Testsets, messen Sie Precision, Recall und F1. Prüfen Sie die Kalibrierung mit ECE und Reliability‑Plots. Aus Betriebs‑Sicht zählen außerdem die Auto‑Akzept‑Rate (wie viel läuft ohne Review durch?), die Review‑Rate und ‑Dauer (Team‑Kapazität), Fehlalarme (falsch akzeptierte Nennungen) und verpasste Erwähnungen sowie Score‑Drift (Veränderung der Score‑Verteilungen über Zeit/Kanäle).

Planen Sie regelmäßige Re‑Kalibrierungen – insbesondere bei neuen Datenquellen, Sprachen oder Modell‑Updates. Für praktische Checklisten und Audits in generativen Suchoberflächen lohnt sich der Beitrag „How to Audit Your Brand in AI Overviews“ (Geneo).

Typische Risiken – und wie Sie sie abfedern

- Überkonfidenz und Halluzinationen in LLM‑Antworten – Gegenmaßnahmen: Quellenbindung/RAG, Evidenz‑Verifikation auf Span‑Ebene, konservative Schwellen, Human‑in‑the‑loop. Eine kompakte Risikoübersicht bietet Epiq: „Why confidence scoring with LLMs is dangerous“. Für konkrete Techniken siehe „What is LLM Hallucination Mitigation?“ (Geneo).

- Ambiguität generischer Markenbezeichnungen („Apple“, „Jaguar“) – Maßnahmen: Kontext‑Features, Typ‑Konsistenz, Priors, Wissensgraphen.

- Alias/Mehrsprachigkeit/Schreibvarianten – Maßnahmen: Aliaslisten, fuzzy Matching, multilingualen Embeddings, Normalisierung/Casing.

- NIL‑Entscheidung (unbekannt/unsicher) – Bei niedriger Konfidenz explizit NIL verlinken, um Fehlzuordnungen zu vermeiden.

Eine wichtige Kontextdimension für Nennungen ist die Suchabsicht. Wie Query‑Intentionen generative Antworten modulieren, erklärt „AI Query Intent im GEO‑Kontext: Begriff einfach erklärt“ (Geneo).

Praxis‑Workflow: Von der Extraktion bis zur Attribution

Nachfolgend ein End‑to‑End‑Ablauf, der sich in den meisten Brand‑Monitoring‑Setups bewährt hat:

- Extraktion (NER) der potenziellen Marken‑Erwähnungen mit Token/Span‑Scores.

- Entity Linking: Kandidaten generieren (Register/Wissensbasis), Ranking aus Mention/Prior/Kontext.

- Konfidenz‑Ableitung und Kalibrierung: Softmax oder Margin; Platt/Isoton/Temperatur; ECE prüfen.

- Thresholding und Routing: Buckets festlegen; Review‑Routen und Fallbacks definieren.

- Verifikation/Attribution: Nur bei ausreichender Evidenz verlinken/zitieren; bei niedriger Sicherheit keine Anzeige oder alternative Quelle.

- Logging/Monitoring: Review‑Last, Fehlalarme, Score‑Drift, periodische Re‑Kalibrierung.

Mikro‑Beispiel (Brand‑Monitoring, Disclosure): Wir routen Erwähnungen mit Confidence ≥ 0,80 direkt in die Anzeige/Verlinkung, 0,50–0,79 in eine manuelle Prüfung mit Quellen‑Check, < 0,50 werden als NIL markiert. Review‑Statistiken und Score‑Drift visualisieren wir kanalweise und passen Schwellen vierteljährlich an. Disclosure: Geneo ist unser Produkt. Die Plattform unterstützt u. a. Marken‑Monitoring über AI‑Antwortmaschinen (Erwähnungen, Zitationen, Sentiment, Historie) und bietet Workflows für Review‑Routing sowie Audit‑Checks.

Für die praktische Umsetzung von Audits und Monitoring in AI‑Overviews ist der Leitfaden „How to Audit Your Brand in AI Overviews“ (Geneo) hilfreich.

Häufige Missverständnisse – kurz erklärt

Brauchen Sie wirklich einen festen 0,80‑Schwellenwert? Er ist ein vernünftiger Startwert, aber letztlich muss der Cutoff empirisch je Kanal, Sprache und Risikoprofil bestimmt werden.

Sind Konfidenzen gleich „Wahrheit“? Sie sind modellierte Wahrscheinlichkeiten, deren Qualität von Kalibrierung, Datenverteilung und Kontext abhängt. Deshalb sind ECE‑Checks und Reliability‑Plots mehr als Kür – sie sind Pflicht.

Wie viele Buckets sind sinnvoll? Meist reichen drei (Auto‑Akzept, Review, Verwerfen/NIL). Mehr Buckets erhöhen Komplexität ohne spürbaren Zusatznutzen.

Zusammenfassung und nächste Schritte

Confidence Scoring macht Marken‑Nennungen in KI‑Systemen steuerbar: Erkennung (NER), Zuordnung (Entity Linking), Kalibrierung (ECE), Schwellen und Review‑Routing greifen ineinander. Die operative Qualität entsteht aus Messung, Re‑Kalibrierung und sauberen NIL‑Entscheidungen – plus einem wachen Blick auf Risiken wie Überkonfidenz und Ambiguitäten. Wenn Sie Ihre Monitoring‑Pipeline professionalisieren möchten, starten Sie mit einem kleinen Validierungsset, definieren Sie Buckets und Review‑Routen, und beobachten Sie Score‑Drift im Zeitverlauf.

Weiterführend: Für den kontextuellen Rahmen der generativen Suche siehe „Neue SEO Abkürzungen: GEO, GSVO, GSO, AIO & LLMO erklärt“ (Geneo) sowie „AI Query Intent im GEO‑Kontext“ (Geneo). Technische Hintergründe zu NER/EL finden Sie u. a. in ACL Findings 2021 zu NER für Entity Linking und den Microsoft‑Hinweisen zu Genauigkeit & Confidence in Document Intelligence.

Soft‑CTA: Wenn Sie Score‑basierte Workflows, Review‑Routing und Audits über mehrere generative Plattformen orchestrieren wollen, können Sie Geneo testen. Die Plattform unterstützt Teams beim Monitoring von Marken‑Erwähnungen, Zitierungen und Sentiment – ohne harte Versprechen, aber mit pragmatischen Werkzeugen für zuverlässigere Entscheidungen.