LLMO metrics:AI回答准确性、相关性与个性化解读

深入解析LLMO metrics,覆盖AI回答的准确性、相关性与个性化衡量方法、评测趋势及品牌可见性优化场景。

你可能已经感受到:在答案引擎时代,用户很多问题不再“点进网站”,而是在AI生成的摘要里直接获得答案。2024年的一项联合研究表明,美国每1000次Google搜索只有约374次点击流向开放网络,且当年6月AI Overviews在美国SERP出现比例约为12.7%,这意味着“零点击”与“被谁引用”正深刻影响品牌与内容的触达,据2024 Zero‑Click Search Study by SparkToro & Datos的量化显示。对企业而言,LLMO metrics(Large Language Model Optimization的评测指标)不只是“模型好不好”的学术分数,而是用来持续衡量与优化AI回答质量、可见性与品牌一致性的实用工具箱。

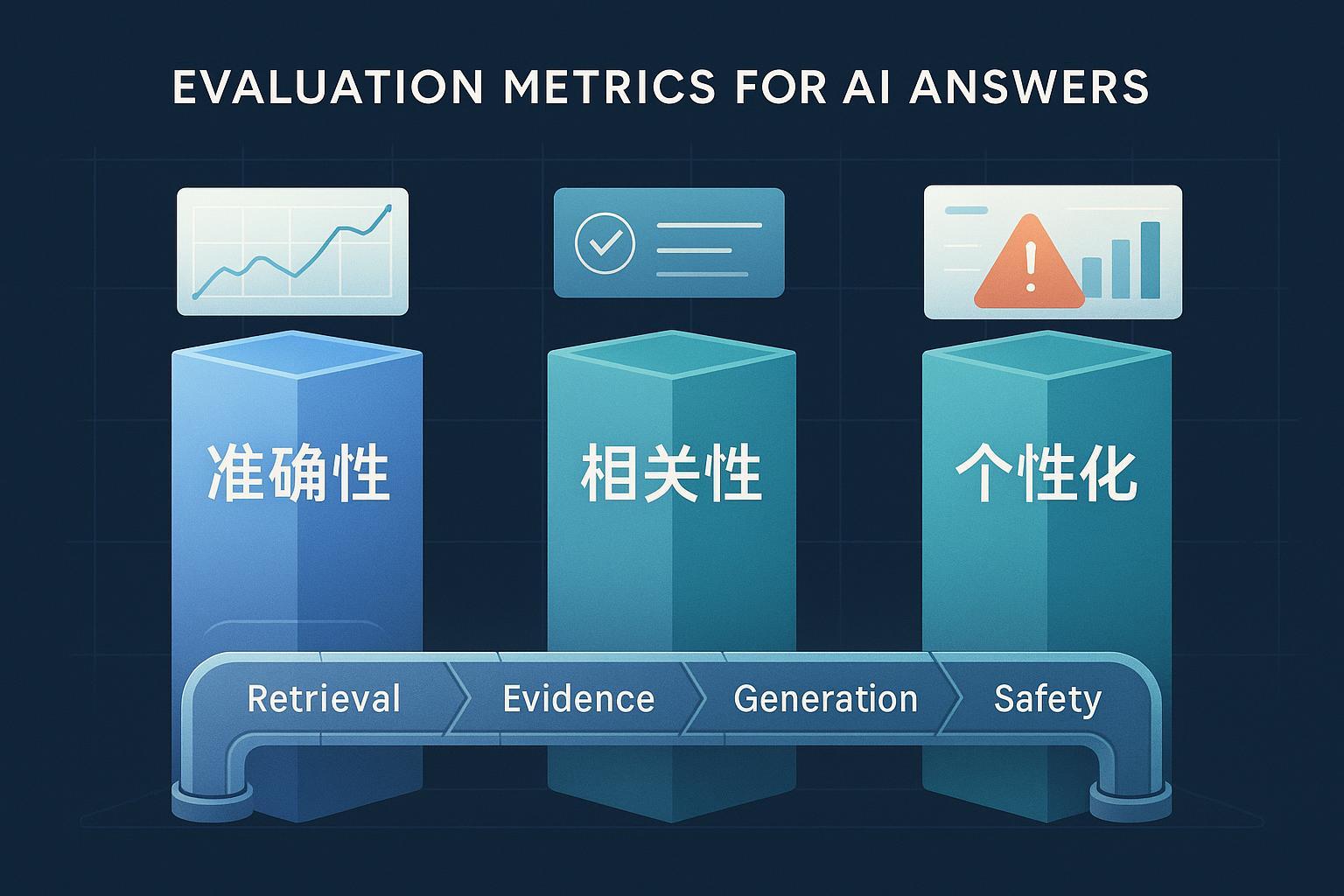

本文为AI产品经理、数据/搜索工程师、以及数字营销与品牌管理从业者,构建一套围绕三大维度——准确性、相关性、个性化——的可操作评测框架,并串起RAG链路指标、在线A/B与风险治理,实现“质量—可见性—品牌一致性”的闭环。

LLMO metrics是什么(以及不是什么)

- 它是面向应用与业务KPI的指标集合:用来评估与提升AI在真实场景中的回答质量与品牌呈现。

- 它不是只看“通用排行榜”的分数;也不是只在训练阶段使用的学术基准。

- 在答案引擎驱动的搜索环境中,内容策略与技术评测需要同向对齐,这一点在业内2024年的方法论讨论中被持续强调,可参见Search Engine Land对AI驱动SERP内容策略的分析(2024)。

三大维度:准确性、相关性、个性化(带口径与算法)

1) 准确性(Accuracy/Faithfulness)

- 定义:回答与可归因证据一致,避免捏造(幻觉)。

- 可计算思路:

- 基于证据的忠实度(Faithfulness/Groundedness):回答中的断言有多少被检索到的上下文或权威资料支持。RAG评测中常将“Groundedness/Context relevance/Context precision”等指标用于此目的,见TruLens 的评测手册(持续更新)与Haystack × RAGAS 的RAG评估示例。

- 幻觉率(Hallucination Rate)= 不可证实断言数 / 总断言数(可用LLM‑as‑a‑judge初评,抽样人工复核)。

- 事实性核对(Factuality):对实体、日期、数值进行结构化比对(知识库或权威文档)。

- 快速例子:若AI回答称“产品A售价199美金,含三年保修”,而品牌官网与价格页仅能佐证“199美金、一年保修”,则“保修三年”为不可证实断言,计入幻觉。

2) 相关性(Relevance)

- 定义:回答是否紧贴用户查询意图、覆盖关键要点;在RAG中还包含回答与上下文的对齐(Answer‑Context Alignment)。

- 可计算思路:

- Answer Relevancy:判断回答是否回应查询核心、信息是否到位,实务中可结合语义相似度与人工Rubric,口径可参考Haystack × RAGAS的定义与示例(2024–2025)。

- 检索相关性指标:Precision@k、Recall@k、MRR、nDCG等,用以评估“检索是否把对的证据排到了前面”。这些IR指标的权威定义可见Stanford/Cambridge《Introduction to Information Retrieval》评测章节(长期维护)。

- Answer‑Context Alignment:回答是否被上下文蕴含或支持,可用NLI/相似度与模板化规则结合,思路见TruLens 的指标组件指引(持续更新)。

3) 个性化(Personalization)与品牌声音一致性

- 定义:回答是否遵循用户画像/偏好与品牌风格(语气、禁用语、合规边界)。

- 可计算思路:

- 成对偏好胜率(Pairwise Win Rate):两版回答A/B对比,由评审(人或经校准的LLM评委)选出更符合期望的一方,统计胜率。大模型安全/偏好评估在2024年的做法提供了成对比较与胜率样例,见OpenAI《o1 System Card》(2024)。

- 语气/风格一致性评分:基于品牌词典与语气规则的分类器+情感倾向一致性,配合抽样人工复核。

- 多指标融合:胜率 × 风格一致性 × 情感一致性 × 用户CSAT/Thumbs‑up。

- 快速例子:品牌要求“专业克制、避免贬低竞品”。若回答出现“全网最强、碾压XX”,则风格与合规双重失分。

RAG链路与可归因性:如何把三大维度“落到链路”

- 检索质量:Recall@k/Precision@k、MRR、nDCG等,确保“对的证据被召回且排前”,权威公式见Stanford/Cambridge《IR》评测章节。

- 证据利用与追溯(Attribution/Groundedness):回答是否引用并正确使用证据,可结合“引用率、引用正确率、被证据支持比率”度量,思路参见TruLens 指标与Cookbook。

- 上下文精确/召回(Context Precision/Recall):回答用了多少“对的上下文”,以及上下文中应答要点有多少被覆盖,口径可参考Haystack × RAGAS的RAG评估。

这层指标将“为什么答得准/不准、贴不贴题、风格为何跑偏”拆解到可归因的环节,便于定位改进点(检索器、提示词、内容源、护栏策略)。

评测流程蓝图(MVE:最小可行评测)

- 离线集构建:挑选Top查询×平台回答样本;对齐权威证据;制定Rubric(Faithfulness/Answer Relevancy/Style一致性)。

- 基线测评:评三类核心维度 + RAG链路(Context Precision/Recall、Answer‑Context Alignment)+ IR排序(Recall@k、nDCG)+ 安全与品牌KPI(如提示注入命中率、品牌违规率)。

- 在线对照:以小流量A/B比较不同Prompt/模型/检索器,度量CSAT、转化、首Token时间与延迟成本。

- 回归与回放:从历史日志构建回归套件;上线前后回放核对“质量回归与漂移”。

- 持续监测与治理:设置阈值与报警;将隐私、安全、品牌安全纳入常设KPI,治理节奏与版本节奏同步。

关于“人机协同评测”的当代做法,可结合LLM‑as‑judge提效,但务必以抽样人工与对抗集校准,以降低位置偏差与模型偏见的影响。

工具与基准生态(2024–2025)

- 应用层评测与观测:

- TruLens:提供Groundedness/Context relevance/Comprehensiveness等指标与示例,支持链路可视化,见TruLens 用例与指标指南(持续更新)。

- Haystack × RAGAS:给出RAG常用指标的实现与示例,如Answer Relevancy、Faithfulness/Context Precision,见Haystack Cookbook:RAG 评估(RAGAS)。

- OpenAI Evals:用于自定义评测与Rubric编排,见OpenAI 平台文档:Evals 指南。

- 背景基准(定位为参考,不替代业务评测):HELM、MTEB、LMSYS Chatbot Arena等提供跨模型对比与偏好排名,但业务落地仍需本地数据与KPI二次评测。

风险与合规并入KPI:质量不只“答得好”,也要“答得稳”

- 全生命周期治理:将识别—度量—管理—治理融入流程,参照美国NIST的AI Risk Management Framework(长期维护)。

- 典型攻防风险:提示注入、数据泄露、越权、虚假内容等,可参考OWASP Top 10 for LLM Applications(常设项目页),将“提示注入成功率、敏感信息暴露率、品牌安全违规率、响应处置时长”等纳入仪表盘。

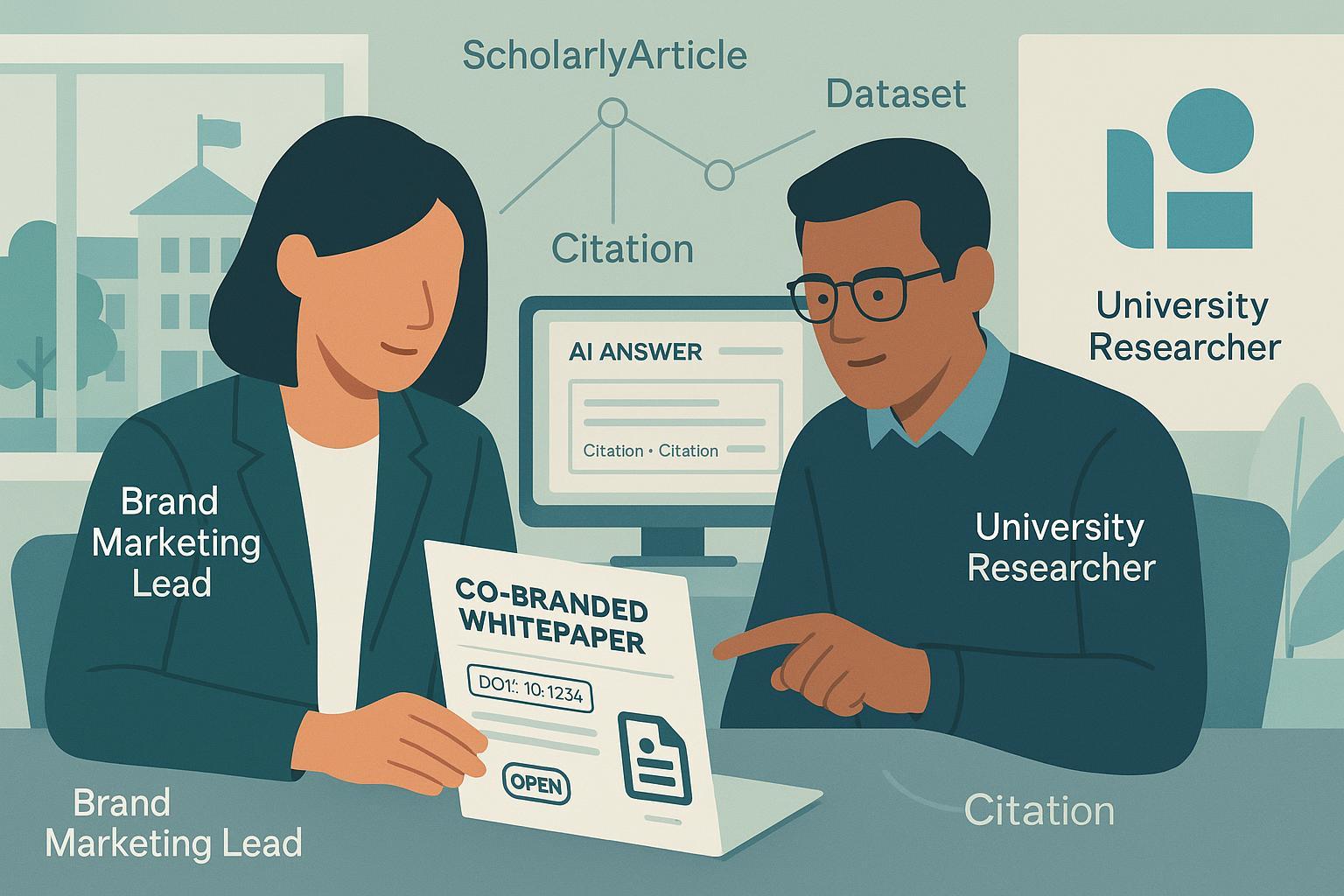

与Geneo的应用结合(基于已披露能力,不夸大)

Geneo是一款面向AI搜索优化与品牌管理的平台,可跨ChatGPT、Perplexity与Google AI Overview等监控品牌曝光、链接引用与品牌提及,并提供情感分析、历史查询回放、实时排名跟踪与内容策略建议(详见官网:https://geneo.app)。据此可以这样把LLMO指标落地到“品牌AI可见性与质量”的日常运营:

- 品牌“准确性”监测:

- 指标:关键事实的幻觉率、被证据支持率(Groundedness/Context Precision)、引用正确率。

- 做法:用Geneo汇集多平台品牌回答样本,与权威资料页配对,统计被证据支持比率,生成“纠错清单”,交付内容/法务/PR协同修正。

- “相关性”ד可见性”联动:

- 指标:Answer Relevancy、核心卖点覆盖度、“优质来源被引用率”“品牌页面入选率”。

- 做法:结合Geneo的排名与引用追踪,量化被引用域名构成与品牌页入选占比,反哺外链与内容结构优化。

- 个性化/品牌声音一致性:

- 指标:风格/语气一致性、情感倾向与品牌指南命中率;小样本成对偏好胜率。

- 做法:用Geneo的情感分析与自定义风格规则识别跑偏用语与负面框架,输出优化建议与风险预警。

- 闭环与趋势报告:利用历史查询回放,对比改版前后Relevance↑/Hallucination↓,形成季度报告;当AI Overviews引用策略变化时,重点监测“品牌页入选率”。

注意:上述实践以“跨平台监控与量化外部平台回答质量”的视角展开;若需要对内部模型进行离线自动化打分,应结合前述评测工具(如TruLens、RAGAS、OpenAI Evals)搭建自有评测流水线。

上手清单(可直接复用)

- 指标口径:

- 幻觉率 = 不可证实断言数 / 总断言数;

- 被证据支持率(Faithfulness/Context Precision)= 被证据支持的信息量 / 回答信息量;

- Answer Relevancy:是否回应查询核心要点(Rubric打分1–5);

- 个性化胜率:成对比较更符合品牌/用户偏好的比例。

- 流程步骤:离线样本与Rubric → 基线评测(含RAG链路与IR指标) → 小流量A/B(CSAT/转化/延迟) → 回归与回放 → 季度报告与治理。

- 风险KPI:提示注入成功率、敏感信息暴露率、品牌安全违规率、异常处置时长(参考NIST/OWASP口径)。

- Geneo结合:建立“品牌AI可见性与质量”仪表盘,跟踪优质来源被引用率、品牌页入选率、情感走向与风格一致性,并将“纠错清单”纳入内容迭代节奏。

结语

LLMO metrics的目标不是“追分”,而是让企业在答案引擎时代真正提升“答得准、答得对题、答得像自己”,并让这些改进稳定地体现在可见性与业务KPI上。若你负责品牌与AI搜索可见性,欢迎体验Geneo,搭建你的跨平台“质量×可见性”仪表盘:https://geneo.app。