2025 AI答案引擎 vs 人工搜索:优势、风险与混合战略对比

2025年AI搜索引擎(ChatGPT、Perplexity、Google AI Overviews)与传统人工搜索全面对比,涵盖准确性、速度、合规、风险场景、品牌治理及混合工作流建议,助力企业优化品牌可见性与决策安全。

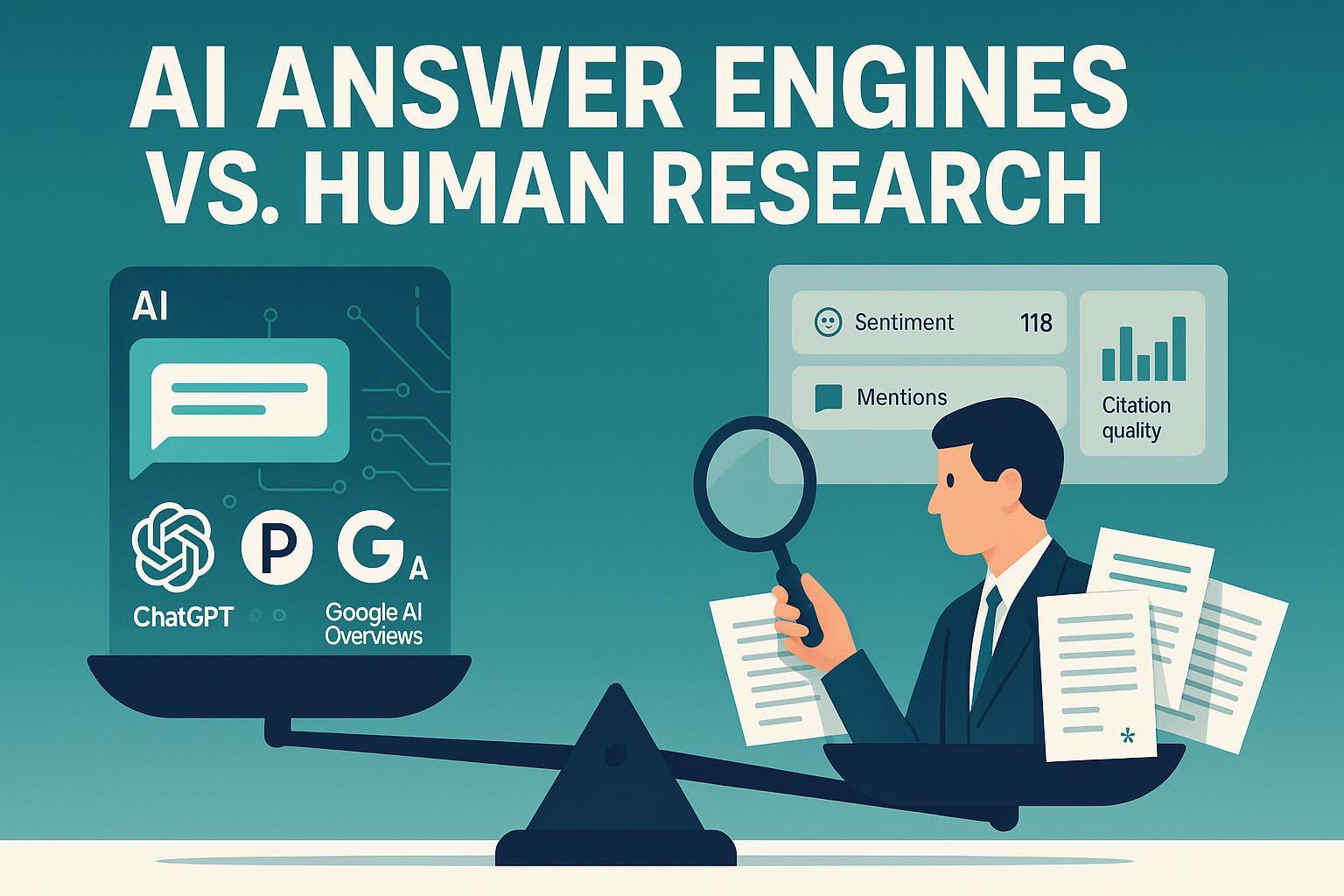

开门见山:2025 年,没有任何一种搜索范式是“完全替代者”。AI 答案引擎(如 ChatGPT/GPT-5、Perplexity、Google AI Overviews/AI Mode)在速度与汇总体验上有明显优势,但在可验证性、合规与高风险决策上,传统“人类主导”的搜索(关键词检索 + 人工甄别与事实核查)依然更可靠。正确姿势是建立“任务分级 + 混合工作流 + 企业级治理与监测”的长期机制。

2025 现状速览:趋势、变革与争议

- 谷歌在 2025 年强化了 AI 搜索形态(AI Mode/Overviews),强调帮助用户处理复杂查询与多轮拆解,并持续更新产品细节与交互能力,官方面向创作者也发布了质量与可见性指南。参见 Google 的两篇 2025 年材料:一是 AI Mode 的产品更新说明,以及Google Search Central《在 AI 搜索中取得成功》(2025-05)。

- 行业流量结构出现显著变化。Semrush 在 2025 年对 AI Overviews 的触发与影响做了量化研究,指出触发占比在年内明显提升,SERP 点击分布随之改变。参见 Semrush 2025 年 AI Overviews 研究。同时,Similarweb 的 2025 年分析显示,当搜索结果页出现 AI 摘要时,“零点击”占比显著上升(一些查询的零点击率达到高位),对站点流量分配形成冲击。见 Similarweb《Zero-Click Searches》2025。Pew Research 在 2025-07 的用户研究也发现,碰到 AI 摘要时,用户点击外部链接的倾向更低。见 Pew Research 2025-07-22 的用户行为分析。

- 错误与不安全建议的争议仍在。2025 年里,媒体多次汇编了 AI 概览的“离谱建议/事实错误”等案例,提醒我们在高风险问题上应加倍谨慎。例如 AndroidAuthority 2025 年对 AI 概览错误判断年份等现象的报道。另一方面,研究也提示“越短的回答越容易诱发幻觉”,提示设计与验证流程需要更稳健。见 TechCrunch 对一项 2025 年研究的解读:短答案会放大幻觉风险。

- 数据合规与版权拉锯加剧。围绕 Perplexity 的抓取与版权争议在 2025 年持续发酵(含 robots.txt 与 WAF 议题),平台方面也提出与出版商分成的尝试作为缓和。可参阅 36kr 的争议综述(2025)与Inside 对“出版商分成计划”的报道(2025)。

深入对比:AI 答案引擎 vs 人类主导搜索

1) 准确性与可验证性

- AI 答案引擎的强项是“把海量信息快速组织成结论”,但事实性与引用可追溯性仍然参差不齐。2025 年的讨论中,提示设计不当(例如过度追求极短答案)会显著放大幻觉风险,这一点在行业研究解读中被反复强调。参见 TechCrunch 对 2025 年相关研究的归纳。

- 以 Perplexity 为例,行业评测常称其“引用透明度更强、能回溯多源链接”,在跨领域调研中也给出较高正确率的非学术测试结果,但应注意这类评测方法论的局限,仍需人工复核。参见 Cursor-ide 的 2025 年深度研究模式评测与使用指南。

- 人类主导的搜索路径虽然更慢,但每一步都可回到原始来源核验、交叉比对与建立证据链,尤其适合高风险结论的把关。

2) 速度与生产力

- AI 在“问题分解、范围界定、初步综述、草拟提纲/模板”等环节效率极高,能显著缩短从 0 到 1 的时间。

- 人工流程在复杂专业主题上前期较慢,但一旦建立起可靠的来源库与审计规范,后期复用价值高、错误成本低。

3) 透明度与来源机制

- 2025 年谷歌不断强调在 AI 搜索形态中提升用户的理解与控制:例如更清晰的来源承接与交互。参见 Google 对 AI Mode/Overviews 的 2025 年产品更新说明。

- 即便如此,AI 仍可能出现“AI 引 AI”的反馈环(引用二次生成的内容而非一手来源),或误读来源语境。这也是为何高价值结论必须要求“能回到权威原文核对”。

4) 风险、合规与问责

- 版权与抓取规则:2025 年围绕 Perplexity 的 robots.txt 与版权争议、以及平台与出版商的利益分配,充分说明了企业在使用 AI 搜索成果时需要“来源可追溯 + 权利边界清晰”的基本盘。参考 36kr 的 2025 年报道与Inside 对分成计划的追踪(2025)。

- 隐私与数据保护:在欧洲与英国语境下,监管者持续强调生成式 AI 的合法性基础、透明度、准确性与数据主体权利。例如英国 ICO 的 2024-12 咨询结论在 2025 年继续推动执行,业内律所对此给出合规要点。可参阅 Skadden 对 ICO 结论的 2025 年解读。

- 可信评估与审计:NIST 在 2025 年发布了 AI TEVV(测试评估验证与确认)标准草案大纲,强调以可测、可管的方式治理模型风险,对企业建立“证据链与问责”尤为关键。见 NIST《AI TEVV 标准草案大纲》(2025)。

5) 场景适配性(什么时候用 AI,什么时候用人工?)

- 适合 AI:头脑风暴、初步调研、常识性问答、旅行/餐饮探索、方案雏形与对比维度罗列。

- 适合人工:医疗/法律/财会/投研等高风险决策;政策法规解读;需要多源交叉验证与严肃证据链的研究。

- 混合优先:中等风险的业务分析与营销策划,采用“AI 初筛 + 人工复核 + 专家把关”的组合路径。

决策框架:任务分级 + 混合工作流(可直接落地)

-

任务分级

- 低风险:通识查询、灵感搜集、非关键性内部资料。允许 AI 先行,人工作抽检。

- 中风险:市场研究、竞争情报、运营策略。AI 先行,要求至少 2–3 个权威一手来源交叉验证,必要时专家签字。

- 高风险:医疗、法务、财务合规、重大对外发布。人工主导,AI 只做辅助生成或问题分解,结论须由专家最终背书。

-

混合流程(示意)

- 明确问题与判定标准(可接受的误差范围、必须满足的合规条款)。

- 用 AI 分解问题、产出候选来源列表与验证假说。

- 人工以权威原文做 2–3 源交叉验证,保留链接、截图与时间戳。

- 汇总为“可审计”的证据包,标注来源粒度与更新日期。

- 上线后开启持续监测(见下一节“品牌与营销”)。

品牌与营销:从“抢前 10”到“被 AI 摘要引用”的新 KPI

AI 摘要改变了“点击在前”的分发逻辑:被摘要引用本身就构成“可见性”。这对品牌提出了全新的运营与治理需求。

-

流量与可见性现实

- 触发率提升与点击外流:Semrush 的 2025 年研究表明 AI Overviews 的触发占比提升,并影响 SERP 的点击分布。见 Semrush 2025 研究。

- 零点击走高:Similarweb 的 2025 年分析与 Pew 的 2025-07 用户研究均显示,出现 AI 摘要时用户更少点击外部链接,零点击率显著抬升。见 Similarweb 2025 与 Pew 2025-07;https://www.pewresearch.org/short-reads/2025/07/22/google-users-are-less-likely-to-click-on-links-when-an-ai-summary-appears-in-the-results/。

-

新 KPI(建议纳入周/月度报表)

- AI 提及份额(Share of Mentions in AI Answers):跨平台与关键查询维度的提及占比。

- 引用质量:AI 是否链接到官方与权威原文,是否存在“AI 引 AI”。

- 情感分布:答案表述对品牌的正/中/负倾向及其驱动主题。

- 可见性趋势:随时间和模型更新的波动;错误与纠偏闭环时延(Time-to-Fix)。

-

内容与技术策略

- 对齐谷歌 2025 年 AI 搜索创作者指南:突出经验(E-E-A-T 的 Experience)、作者资历、专家背书,提供清晰结论与证据链,结构化 FAQ 与可验证外链。见 Google Search Central《在 AI 搜索中取得成功》(2025-05)。

- 强化权威证据源:法规/白皮书/数据页/可验证的多媒体证据,定期更新并保留版本差异。

- 技术 SEO 与结构化数据:Schema、站内问答页、优质移动体验与性能优化。

-

治理与监测闭环(以 Geneo 为例)

- 监测:跨 ChatGPT、Perplexity 与 Google AI Overviews 追踪品牌被提及、被引用的页面与情感倾向。

- 诊断:识别“错误事实/过时信息/二次生成来源”导致的风险点,量化引用质量。

- 纠偏:联动公关/法务发起平台反馈与内容修订,记录处理进度与影响范围。

- 优化:依据洞察调整站点与外部素材,面向“被摘要引用”重新组织证据与结构。

- 复查:对比修订前后 AI 答案的变化曲线,生成团队对齐的周/月报。

上述闭环可由企业自建,也可以借助专门的监测与治理工具。例如,Geneo 作为“AI 搜索可见性与品牌监测平台”,支持跨平台提及/引用追踪、AI 驱动情感分析、历史查询对比与内容优化建议,并提供多品牌多团队协作能力,帮助市场、公关与法务协同降低风险与放大可见性。

合规与伦理:把“可解释、可审计、可问责”嵌入流程

- 政策与指南对齐:依据谷歌 2025 年的创作者指南,避免低质量拼接,强化一手经验与权威背书。参考 Google Search Central 2025 指南。

- 标准与审计:参考 NIST 在 2025 年提出的 TEVV 框架思路,建立测试—评估—验证—确认的证据链,确保关键结论留痕可溯。见 NIST TEVV 草案大纲(2025)。

- 数据与隐私:关注英国 ICO 对生成式 AI 使用个人数据的立场与合规要求,特别是合法性基础、透明度、目的限制与数据主体权利在 2025 年的延续执行。见 Skadden 的 2025 年合规律师解读。

清单与模板:拿走就能用

-

三层防错策略

- 任务分级:Low/Medium/High,根据风险决定复核强度。

- 分工机制:AI 初稿/初筛 + 人工复核 + 专家背书。

- 审计留痕:保存原文链接、截图、时间戳、变更记录与责任人。

-

交叉验证清单(5 条)

- 至少核对 2–3 个权威一手来源;

- 检查 AI 引用是否为真实来源且语义一致,避免“AI 引 AI”;

- 对时效性强的问题优先使用官方/监管/学术页面并加时间过滤;

- 明确版权与隐私边界,尊重 robots.txt 与许可条款;

- 重大结论必须由人类最终背书并记录审阅意见。

-

监测 KPI(企业治理)

- 提及份额、引用质量、情感分布、可见性趋势、Time-to-Fix;

- 平台差异(ChatGPT/Perplexity/AI Overviews)与关键查询维度对比;

- 历史对比(内容修订前后、模型更新前后)。

结语:长期主义与持续评估

模型与平台仍在快速演进。2025 年的最佳实践不是“押注某一种搜索”,而是以治理视角构建“混合而可审计”的能力:把 AI 的速度与启发发挥到极致,同时用人类的溯源、常识与专业判断守住关键边界;用监测与合规把风险转化为可观测、可纠偏、可优化的运营闭环。

——

如希望把上述治理闭环快速落地,欢迎了解 Geneo:跨平台提及/引用监控、AI 情感分析、历史对比与内容优化建议,帮助品牌在 AI 与传统搜索双通道提升可见性与确定性。

- 进一步了解 Geneo:https://geneo.app