2025年AI搜索分析在金融医疗法律行业的最佳实践

权威指南,示范2025最新合规标准下AI搜索分析实操方案。覆盖金融、医疗、法律行业,强调数据治理、透明度、实时监控与Geneo工具场景落地,助力高监管领域高效实现品牌风险管控与合规审计。

作为在金融、医疗与法律行业推动AI搜索分析落地的从业者,我最大的体会是:没有银弹。2025年的现实是双重压力同时加码——一方面,ChatGPT、Perplexity 与 Google AI Overview 等答案化渠道已成为“第二入口”,品牌与合规风险从搜索页延伸到AI问答;另一方面,审计留痕、透明度与数据治理标准持续抬升(如美国医疗IT监管对算法透明提出新要求、NIST与ISO相继完善AI治理框架)。本文聚焦“如何具体做”,在约束下创新,以可审计、可复盘的方式建立稳健的AI搜索分析体系。

- 核心方法:数据分级 → 透明声明 → 跨平台监控 → 审计留痕 → 持续改进(闭环)

- 适用对象:金融、医疗、法律等高监管行业的合规/风控、品牌与市场、数据与IT团队,以及服务这些机构的代理商

- 工具参考:Geneo(跨平台AI监控、情感分析、历史追踪与内容优化建议)

重要提示:下文引用的法规与标准以官方发布为准。医疗场景可直接对照美国卫生信息技术办公室ONC在2024年发布的HTI‑1最终规则关于算法透明度与决策支持干预的要求,见官方材料中的“算法透明与信息披露”要点(参考 ONC 2024 HTI‑1演示稿 与 ONC认证项目主页)。跨行业治理可映射到美国国家标准与技术研究院的 NIST AI风险管理框架主页(2023+持续更新) 及其 在线Playbook。

一、监管与治理基线:把“原则”翻译成“操作”

- 医疗:2024年ONC HTI‑1最终规则明确了面向临床的“决策支持干预(DSI)”透明度与算法披露义务,包括设计目的、训练/评估方式与使用限制,旨在降低偏见与提高互操作性(USCDI v3)(见 ONC HTI‑1官方材料(2024))。

- 医疗/药械:FDA围绕AI/ML软件的边界与可信度持续给出指引,例如对“临床决策支持(CDS)软件”的监管范围说明,以及推动在药品与生物制品申报中提升AI模型可信度的框架方向(参见 FDA“临床决策支持软件FAQ”页面 与 FDA关于AI可信度框架的官方新闻稿)。

- 跨行业:NIST发布的 AI风险管理框架(AI RMF) 给出“识别—评估—缓解—监控”的治理闭环;Playbook提供实践清单与工件模板(见 NIST AI RMF Playbook在线版)。

- 体系标准:ISO/IEC 42001(AI管理体系)与ISO/IEC 23894(AI风险管理)可作为组织层的内控与持续改进抓手,二者目录可在ISO官网查看(见 ISO/IEC 42001:2023目录页 与 ISO/IEC 23894:2023目录页)。

- 欧盟走向:关于欧盟AI法案的义务分层与透明要求,需以官方文本为准;权威入口为 EUR‑Lex官方门户 与欧委会 AI政策页面。

金融与法律领域目前更多体现为“既有规则对AI同样适用”:例如营销沟通的审批与记录保存、隐私披露与适当性义务、保密/律师-当事人特权与客户同意边界。这意味着AI生成或被AI引用/传播的内容,必须纳入原有合规与审计控制链路。

二、五步闭环:从数据到审计的可验证路径

以下五步是在多个项目中反复打磨后的“可落地版本”。每一步都配有控制点、常见误区及Geneo能发挥作用的环节。

步骤一:数据分级与合规界定

- 做法:基于PII/PHI/机密/公开四象限进行分级;对跨境、第三方平台共享与用于训练/推理的加工环节单独标识。

- 控制点:默认最小化原则;医疗/法律默认采用最高敏感级别处理;形成数据目录与访问矩阵。

- 参考框架:NIST AI RMF的风险识别段落与ISO/IEC 23894中的“风险识别与情境定义”(可参见 NIST AI RMF主页 与 ISO/IEC 23894目录页)。

- 常见误区:将“公开网页信息”视为无风险;忽略将AI回答快照视为“组织外发内容”的留存与审计义务。

步骤二:透明声明与用途边界

- 做法:为对外内容、AI可引用页面与知识库添加“透明标签”,包含来源更新时间、适用场景、禁用场景与免责声明;医疗内容补充证据分级与适应症边界。

- 控制点:医疗DSI需在临床使用前保证可解释信息供临床人员审阅(参照 ONC HTI‑1关于算法透明的要求(2024))。

- 常见误区:将“免责声明”仅当作页脚格式;忽视“模型输入不可控”导致的语境漂移。

步骤三:跨平台实时监控(ChatGPT/Perplexity/Google AI Overview/传统SERP)

- 做法:建立关键问法与敏感关键词清单,持续监控品牌被提及、引用链接、情感倾向与排名/可见性波动。

- Geneo实践:用Geneo配置跨平台监控面板,设置金融/医疗/法律的分组关键词与阈值;当出现“误导性治疗建议”“未披露风险的产品推荐”“法律意见暗示”等情形时触发预警与升级流程。

- 控制点:将“负面情感+高风险词”的组合设定更严格的告警阈值;对变化剧烈的AI答案保留快照与比对。

- 常见误区:只盯传统SEO指标,忽视AI答案对流量与合规的双重影响。

步骤四:审计留痕与记录保存

- 做法:统一沉淀AI答案的历史快照、时间戳、触发词、外链与情感标注;形成可导出的审计包(含事件处置记录)。

- Geneo实践:启用历史查询追踪,按事件生成“审计版报告”,供内审/外部稽核复核;与内部合规系统对接,实现证据链闭环。

- 控制点:区分“监测证据”与“对外沟通资料”的留存时限与审批流程;敏感内容加密归档。

- 常见误区:只做监控不做归档;遇审计被问“过去12个月AI答案如何变化”而无凭据。

步骤五:持续改进与内容优化

- 做法:基于监测结果修订页面结构化数据、权威参考与透明标注,开展A/B对比实验以提升被AI“正确引用”的几率。

- Geneo实践:利用内容优化建议模块,为医疗页面加入证据分级与禁用场景提醒、为金融页面补充适当性与风险披露、为法律页面添加“非法律意见与辖区限定”;跟踪优化前后“被AI引用的准确性”与“负面舆情占比”。

- 参考框架:与 NIST AI RMF的“监控与改进”要求 以及 ISO/IEC 42001管理体系的持续改进思想 对齐。

三、按行业拆解:差异化控制与阈值设置

医疗(Healthcare)

- 高风险点:PHI处理、临床暗示性回答、适应症误导、偏见与公平性。

- 加严做法:

- 为临床相关内容提供“算法营养标签”式透明说明(目的、数据范围、适用边界);

- 对“治疗建议/药械推荐”相关问法设最高级别阈值与人工复核;

- 审计包中强制保留“证据来源与版本”。

- 对标依据:参照 ONC HTI‑1关于DSI透明与互操作要求(2024) 与 FDA对CDS软件监管边界的FAQ。

金融(Financial Services)

- 高风险点:营销/投资建议合规披露、适当性、隐私与电子沟通留存。

- 加严做法:

- 将AI外部曝光纳入“营销材料审批/抽查”流程;

- 为关键词如“保本”“保证收益”“内幕”等设红线与自动升级;

- 对外披露材料与监测证据分别留存,满足记录保存规则的时限与检索要求。

- 治理参照:以“既有规则同样适用于AI生成/传播内容”的原则,结合组织内部合规制度与审计要求执行(可映射到 NIST AI RMF监控与治理要素)。

法律(Legal Services)

- 高风险点:保密/特权、客户同意、跨辖区适用、非授权法律意见暗示。

- 加严做法:

- 所有对外内容默认“非法律意见”与“辖区限定”标签;

- 对涉及案件细节的问答监测设置更高敏感级别,禁止AI平台暴露可识别线索;

- 历史版本与客户同意记录纳入审计包。

- 治理参照:结合ISO/IEC 23894的风险识别与沟通机制,强化证据链与授权范围(见 ISO/IEC 23894目录页)。

四、指标与看板:让改进“量化、留痕、可追责”

建议以季度为周期,构建以下KPI并与告警规则绑定(Geneo可直接支撑其中多项):

- 跨平台被提及与链接引用率:分ChatGPT/Perplexity/AI Overview/传统SERP维度,观察权威来源提及质量变化。

- 负面情感占比与处置SLA:负面被识别→工单→响应→修复→复检的闭环时长。

- 合规要素覆盖率:页面是否具备透明标签、风险披露、证据分级、辖区限定等。

- 审计可追溯性:快照覆盖率、版本差异报告齐备率、按需导出审计包成功率。

- 优化成效:内容优化前后,被AI引用的准确性与误导性回答的发生频次变化(以对比实验为准)。

为避免争议指标,把“影响流量的判断”与“合规风险的判断”分开评估;对AI答案对SEO/CTR的影响,建议以自建面板与分组实验验证,避免未经核实的行业百分比结论。

五、90天落地路线图(以最小可行闭环为目标)

- 第0–2周:

- 建立跨部门小组(合规/法务、市场/品牌、数据/IT);

- 梳理高风险场景与关键词清单;完成数据分级与访问矩阵;

- 选定监控工具与证据留存方案(可试用Geneo)。

- 第3–6周:

- 配置跨平台监控与告警阈值;

- 打通审计留痕流程,产出第一版“审计包”模板;

- 为医疗/金融/法律的关键页面补充透明标签与披露模板。

- 第7–10周:

- 启动内容优化实验(结构化数据、权威引用、免责声明);

- 建立“负面情感+高风险词”的升级与复核机制;

- 生成首份季度报告(含基线数据与改进建议)。

- 第11–13周:

- 复盘误报与漏报案例,优化阈值;

- 将关键指标纳入管理例会;

- 依据NIST/ISO框架定义年度持续改进目标(参见 NIST AI RMF Playbook 与 ISO/IEC 42001持续改进思路)。

六、常见误区与应对

- 只做品牌,不做合规:AI答案中的一句“治疗建议/收益承诺”足以引起合规风险;品牌与合规必须同轨推进。

- 只监控,不留痕:没有快照与版本对比,任何复盘都缺乏证据力。

- 只看单平台:ChatGPT、Perplexity、Google AI Overview与传统SERP各有生态逻辑,必须横向对照。

- 把免责声明当“装饰”:透明与用途边界是实质控制点,不是格式化页脚。

- 以为“公开数据=零风险”:组合重识别、跨境流转与情感操控都会放大风险。

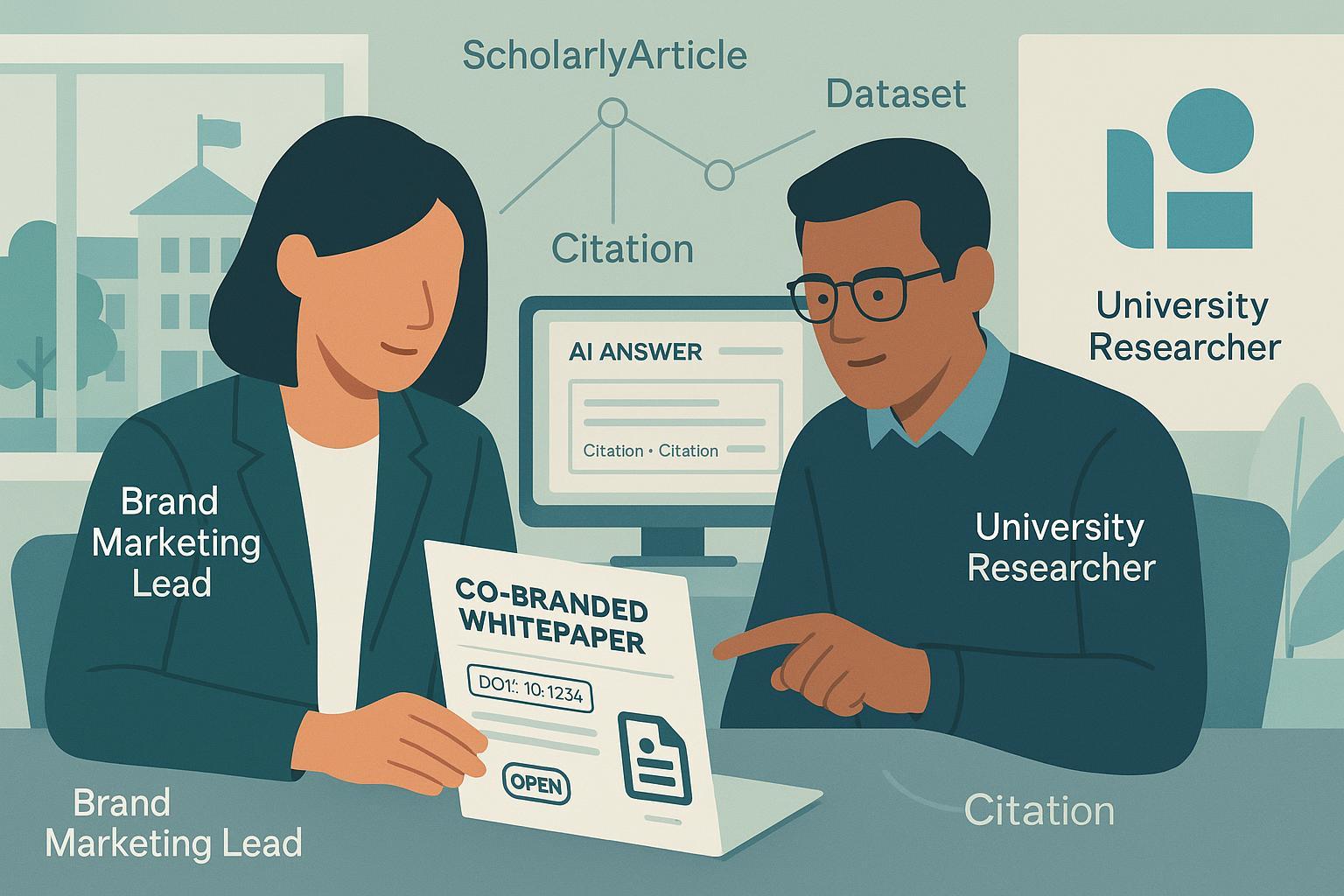

七、用Geneo构建“监控—审计—优化”的合规闭环

基于Geneo的能力组合,我通常这样落地:

- 多平台监控:为三大行业分别建立关键词与问法集,追踪品牌提及、引用链接与排名波动;对“高风险词+负面情感”设定强告警并自动入工单队列。

- 情感分析:将医疗“治疗/药械”、金融“收益/保本”、法律“意见/保密”等敏感意图分类,按行业差异设阈值,减少漏报与误报。

- 历史追踪与审计包:为重大事件与高风险问法保留快照,按周/月自动生成对比报告与可导出的审计文件,支撑内外部审查。

- 内容优化建议:按行业模板生成披露与透明标签清单,建议增加权威来源与结构化数据,提升被AI“正确引用”的概率,减少误导性答案。

这些实践与 NIST AI RMF的“持续监控与改进”要求 以及 ISO/IEC 23894的风险缓解机制 一致;对医疗透明披露的执行也可参照 ONC HTI‑1(2024)的算法透明条款。

八、适用边界与前瞻

- 欧盟AI法案的分期义务与豁免等以官方公报为准;请以 EUR‑Lex官方入口 与欧委会的 AI政策页面 为依据持续跟踪。

- 金融领域当前更多是“既有合规框架+AI场景适配”,不要等待“AI专属新规”才行动。

- 对AI搜索生态的具体流量影响,请以自测面板与对照实验为准,避免未经核实的数据点。

——

结语:把“看不见”的AI答案场景,变成“看得见、可追责、可优化”的运营与合规资产。这是我们在高监管行业推进AI搜索分析的基本功。

如果你正准备在合规前提下建立跨平台AI搜索监控与审计闭环,建议从一个小范围试点开始。你可以了解并试用Geneo的跨平台监测、情感分析、历史追踪与内容优化能力:https://geneo.app