Score de confiance en IA : comprendre et fiabiliser les mentions de marque

Définition claire du score de confiance en IA pour mentions de marque : explications, calibration, bonnes pratiques de monitoring et limites à connaître.

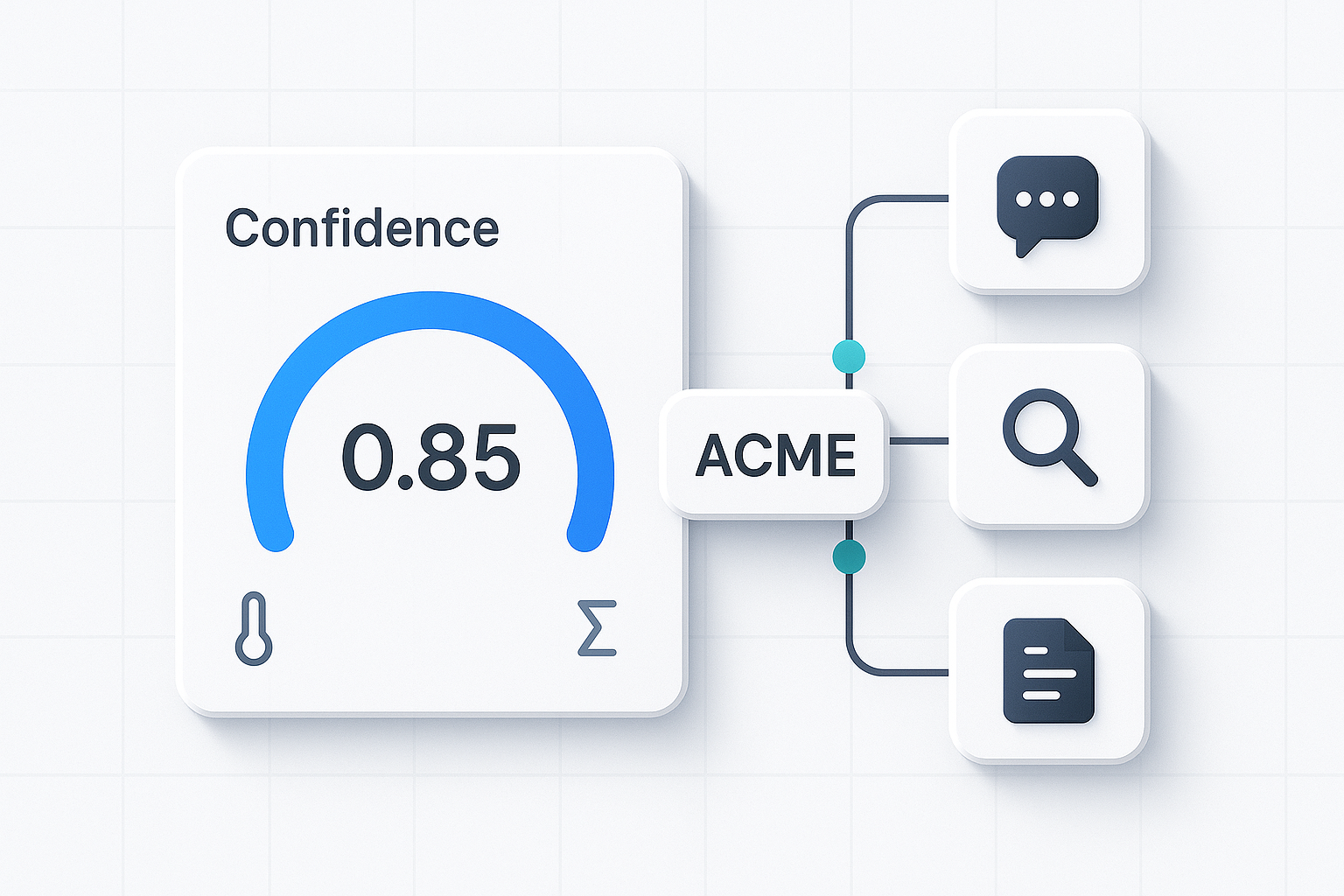

Votre tableau de suivi affiche « Confiance = 0,87 » pour une mention « ACME » repérée dans une réponse IA. Faut‑il la compter, l’escalader ou l’ignorer ? Intuitivement, on se dit qu’« 87 % » veut dire « très sûr ». En pratique, c’est vrai… uniquement si ce score est bien calibré, si l’incertitude est maîtrisée, et si la source qui soutient la mention est traçable.

Cet article clarifie ce qu’est un score de confiance, pourquoi il doit être calibré, comment l’exploiter avec des signaux d’incertitude, et comment l’appliquer concrètement au monitoring des mentions de marque (NER, entity linking, RAG/citations). On reste pragmatiques, orientés production.

1) Définition: qu’est‑ce qu’un score de confiance (et ce qu’il n’est pas)

Dans un classifieur moderne, la couche finale renvoie une distribution de probabilité sur les classes. Le « score de confiance » correspond le plus souvent à la probabilité attribuée à la classe prédite (par exemple, « cette entité est la marque ACME avec 0,87 »). C’est une propriété locale, au niveau d’une prédiction. Les métriques système (précision, rappel, F1) mesurent, elles, la performance globale sur un jeu de test et ne doivent pas être confondues avec la confiance locale. Pour un rappel rapide et pédagogique des familles de modèles et de leurs sorties probabilistes, voir la présentation d’IBM sur les modèles de classification.

Important: beaucoup de réseaux neuronaux sont « surconfiants » de base. Une prédiction annoncée à 0,90 n’est pas forcément correcte 9 fois sur 10. Ce phénomène a été documenté et mesuré de manière rigoureuse, notamment par Guo et al. (ICML 2017) dans « On Calibration of Modern Neural Networks » — une référence fondatrice sur le sujet de la calibration.

2) Pourquoi et comment calibrer les scores

Sans calibration, vos dashboards prennent des décisions sur des probabilités trompeuses. Soyons concrets: si votre seuil d’acceptation est 0,80 mais que le modèle est surconfiant, vous allez compter trop de faux positifs de mentions.

2.1 Méthodes de calibration efficaces

- Temperature scaling: on apprend un paramètre T sur un jeu de validation; on divise les logits par T avant softmax. Simple, robuste, souvent suffisant pour corriger la surconfiance observée dans les réseaux modernes (cf. Guo et al. 2017).

- Platt scaling: régression logistique appliquée aux scores; historique SVM, généralisation possible.

- Régression isotone: ajustement monotone non paramétrique; puissant mais sensible au surapprentissage si peu d’exemples de calibration.

2.2 Mesurer la calibration

Deux mesures pratiques pour piloter vos corrections sont l’ECE (Expected Calibration Error) et le score de Brier. L’idée: comparer la confiance annoncée avec la fréquence réelle de succès, par « tranches » de probabilité, et optimiser jusqu’à obtenir un bon alignement.

| Mesure | Ce que ça indique | Quand l’utiliser |

|---|---|---|

| ECE (Expected Calibration Error) | Écart moyen pondéré entre confiance moyenne et précision observée par bin de probabilité. | Pour vérifier l’alignement global après calibration; suivre dans le temps par canal/lingue. |

| Score de Brier | Erreur quadratique moyenne entre probas prédites et issues observées (multi‑classes possible). | Pour comparer des modèles/calibrations; sensible à la qualité des probabilités, pas qu’au classement. |

Pour la sensibilité de la calibration aux changements de distribution (dataset shift) et la robustesse des approches, voir Ovadia et al. (NeurIPS 2019) — « Can You Trust Your Model’s Uncertainty? », qui met en lumière des dégradations de calibration hors distribution et propose des pistes d’évaluation avancées (arXiv).

3) Incertitude exploitable: entropie, marge top‑2, ensembles, MC Dropout

Le score de confiance ne suffit pas toujours. On gagne à regarder des indicateurs complémentaires pour décider « accepter / revoir / s’abstenir ».

- Entropie: mesure la dispersion de la distribution de sortie. Entropie élevée = modèle hésitant; utile pour détecter les cas ambigus à prioriser en revue humaine.

- Marge top‑2: différence entre la première et la deuxième probabilité. Petite marge = fort risque d’ambiguïté (ex.: « Orange » marque vs couleur). Grande marge = séparation nette.

- Ensembles profonds (Deep Ensembles): entraîner plusieurs modèles indépendants et agréger; plus coûteux mais souvent plus fiables pour l’incertitude.

- MC Dropout: activer le dropout au test et agréger plusieurs passes pour approximer l’incertitude épistémique.

Ces outils complètent la calibration: l’une aligne les probabilités sur la réalité, l’autre quantifie « à quel point » la prédiction est stable. Dans les environnements vivants (nouvelles campagnes, nouveaux alias de marque, nouveaux marchés), coupler ces signaux est décisif.

4) Prédiction conforme (conformal prediction) et abstention

Quand le coût d’erreur est élevé (ex.: compter une fausse mention comme vraie dans un rapport de direction), prévoir un mécanisme d’abstention est sain. La prédiction conforme permet de construire, à partir d’un ensemble de calibration distinct, des ensembles de classes avec une garantie de couverture (par exemple 90 %), distribution‑free. Si l’ensemble renvoyé contient plusieurs classes ou reste trop large, la politique peut être de « s’abstenir » et d’envoyer en revue humaine. Pour une introduction claire et rigoureuse, voir le tutoriel d’Angelopoulos & Bates — « A Gentle Introduction to Conformal Prediction » (arXiv).

5) Cas « mentions de marque »: du NER au RAG, ce qui compte vraiment

Un pipeline réaliste suit quatre étapes.

-

NER (Named Entity Recognition). Détecter dans le texte des segments candidats qui ressemblent à des marques. Les modèles modernes (transformers, CRF) produisent des probabilités par token, puis agrégées au niveau de l’entité. Attention: certaines API exposent des « scores » qui ne sont pas des probabilités calibrées au niveau entité; documentez ce que signifie chaque champ.

-

Entity linking (désambiguïsation). Relier la mention à la bonne entité dans votre base (graphe de connaissances, KB interne). Le score combine similarité sémantique, popularité/prior et cohérence contextuelle. Les homonymes (« Apple », « Orange ») ou alias multilingues exigent des seuils adaptés, par langue et canal.

-

Vérification de la source (RAG/citations). Si la mention provient d’une réponse augmentée par récupération, attachez l’URL, la date et un extrait incriminant la mention. Évaluez la cohérence entre la mention et la source: preuves multiples et concordantes → confiance accrue; preuves faibles ou contradictoires → revue humaine ou abstention.

-

Décision et traçabilité. Confiance calibrée au‑dessus d’un seuil + marge top‑2 élevée + source solide → accepter. Sinon, file d’attente pour revue, enrichie de signaux d’incertitude et des traces de décision.

Pièges typiques à surveiller: homonymie multi‑secteurs (marque vs terme commun), variantes orthographiques/diacritiques, hashtags, canaux multilingues, et surtout les cas « out‑of‑distribution » (nouveaux produits, slogans récents). Une surveillance active de la dérive et des seuils par canal est indispensable.

6) Exemple pratique / workflow (micro‑exemple produit)

Divulgation: Geneo est notre produit.

Imaginons un tableau « Mentions IA » avec colonnes: texte, canal (ChatGPT, Perplexity, AI Overviews), langue, entité candidate, confiance (brute et calibrée), marge top‑2, entropie, statut, source.

- Une ligne affiche « ACME » détecté dans une réponse; confiance brute 0,91, calibrée 0,82; marge top‑2 = 0,09; entropie élevée; une seule source peu probante. La politique déclenche « Revue humaine » et demande une source supplémentaire.

- Une autre ligne: « ACME Bank »; confiance calibrée 0,88; marge top‑2 0,34; entropie faible; deux sources concordantes (URL + date). Le workflow accepte automatiquement et trace la décision.

Ce type de pilotage réconcilie vitesse (automatisation quand les signaux convergent) et sécurité (abstention quand ça hésite). Au passage, chaque champ est journalisé pour audit ultérieur.

7) Paramétrer vos seuils en pratique

- Démarrez avec un seuil d’acceptation calibré par canal et langue (ex.: 0,85 en français pour ChatGPT, 0,80 pour Perplexity), puis ajustez sur la base d’un lot d’audit.

- Rendez les seuils dynamiques: baissez le seuil si marge top‑2 très élevée et sources multiples; remontez‑le si entropie élevée ou canal réputé instable.

- Réservez une « zone grise » pour la revue humaine (ex.: 0,70–0,85 calibré) et priorisez par entropie/marge.

- Suivez ECE et Brier par période et par canal; déclenchez une alerte si ces métriques se dégradent significativement.

- Versionnez modèles et calibrations; re‑calibrez après tout changement de données ou d’hyperparamètres.

8) Attention aux limites

Aucun score n’est parfait. Les modèles peuvent être sur‑ ou sous‑confiants; la calibration se dégrade sous dérive de données; les signaux d’incertitude ne « garantissent » pas la vérité et peuvent eux‑mêmes varier d’un canal à l’autre. Gardez une boucle humaine là où l’ambiguïté est élevée, et n’oubliez pas qu’une « importance » (salience) n’est pas une « probabilité de justesse ».

9) Gouvernance, traçabilité et conformité

Au‑delà de l’algorithme, une pratique responsable suppose de tracer les composants, données, décisions et changements. Le cadre « AI RMF 1.0 » du NIST (2023) met en avant la journalisation, l’évaluation continue et la gestion du risque tout au long du cycle de vie — des principes directement transposables à un pipeline de mentions de marque (NIST AI Risk Management Framework). En France/UE, la CNIL rappelle aussi l’importance de la documentation technique, de la traçabilité des traitements et d’une surveillance continue pour détecter dérives et biais, dans l’esprit du RGPD (voir le portail IA de la CNIL).

10) Checklist pour passer en production

- Définir vos canaux cibles (ChatGPT, Perplexity, AI Overviews, etc.) et échantillonner des données représentatives par langue.

- Calibrer les scores (temperature scaling au minimum) et fixer des seuils par canal; mesurer ECE et Brier.

- Activer des signaux d’incertitude (entropie, marge top‑2) et une politique d’abstention claire.

- Pour le RAG, exiger un minimum de preuves (nombre, fraîcheur, cohérence) avant d’« affirmer » une mention sensible.

- Mettre en place la revue humaine priorisée par incertitude et par impact business.

- Journaliser: scores bruts et calibrés, sources, décisions, versions de modèle; planifier des audits périodiques.

- Surveiller la dérive et recalibrer dès que l’ECE/Brier varient au‑delà d’un seuil convenu.

11) Pour aller plus loin

- Rappel pédagogique sur les sorties probabilistes et la lecture des modèles: la synthèse d’IBM sur les modèles de classification.

- Sur la surconfiance et la calibration post‑hoc: Guo et al., ICML 2017, « On Calibration of Modern Neural Networks » (PMLR).

- Sur l’incertitude et les dégradations sous changement de distribution: Ovadia et al., NeurIPS 2019 (arXiv).

- Sur la prédiction conforme et l’abstention avec garanties: Angelopoulos & Bates, « A Gentle Introduction to Conformal Prediction » (arXiv).

- Sur la gouvernance et la gestion de risque: NIST AI Risk Management Framework (2023) et le portail IA de la CNIL.

En bref, pensez « probabilité calibrée + incertitude + preuves ». C’est cette triade qui transforme un « 0,87 » alléchant en une décision fiable et traçable. Et vous, où placerez‑vous la barre d’abstention pour protéger vos rapports de marque sans perdre en réactivité ?