Negative Stimmung in KI-Antworten entschärfen (2025): Praxistipps für Profis

Entdecken Sie 2025-erprobte Best Practices zur Minderung negativer Zitate in KI-Antworten – mit konkreten Strategien, Multi-AI-Monitoring (Geneo) und Schritt-für-Schritt-Handlungsanleitungen für Markenprofis.

In 2025 entscheiden KI‑gestützte Suchoberflächen zunehmend darüber, wie Marken wahrgenommen werden. Antworten in Google AI Overviews, ChatGPT oder Perplexity bündeln Inhalte, gewichten Quellen und prägen die Erstmeinung – häufig noch vor dem Klick auf eine Website. Google betont seit 2024, dass AI Overviews Nutzer:innen „eine größere und vielfältigere Auswahl hilfreicher Links“ anzeigen und Interaktionen fördern, was die Relevanz dieser Flächen für Marken massiv erhöht, wie im offiziellen Google Produktupdate zu AI Overviews (2024) erläutert. Parallel zeigen Verbraucherbefragungen, dass Reaktionsfähigkeit und Bewertungsqualität konversionskritisch sind: Laut der BrightLocal Local Consumer Review Survey 2024 ignorieren 71% Unternehmen mit <3 Sternen, während 88% Marken bevorzugen, die auf alle Reviews antworten (UK/US‑Stichprobe, 2024).

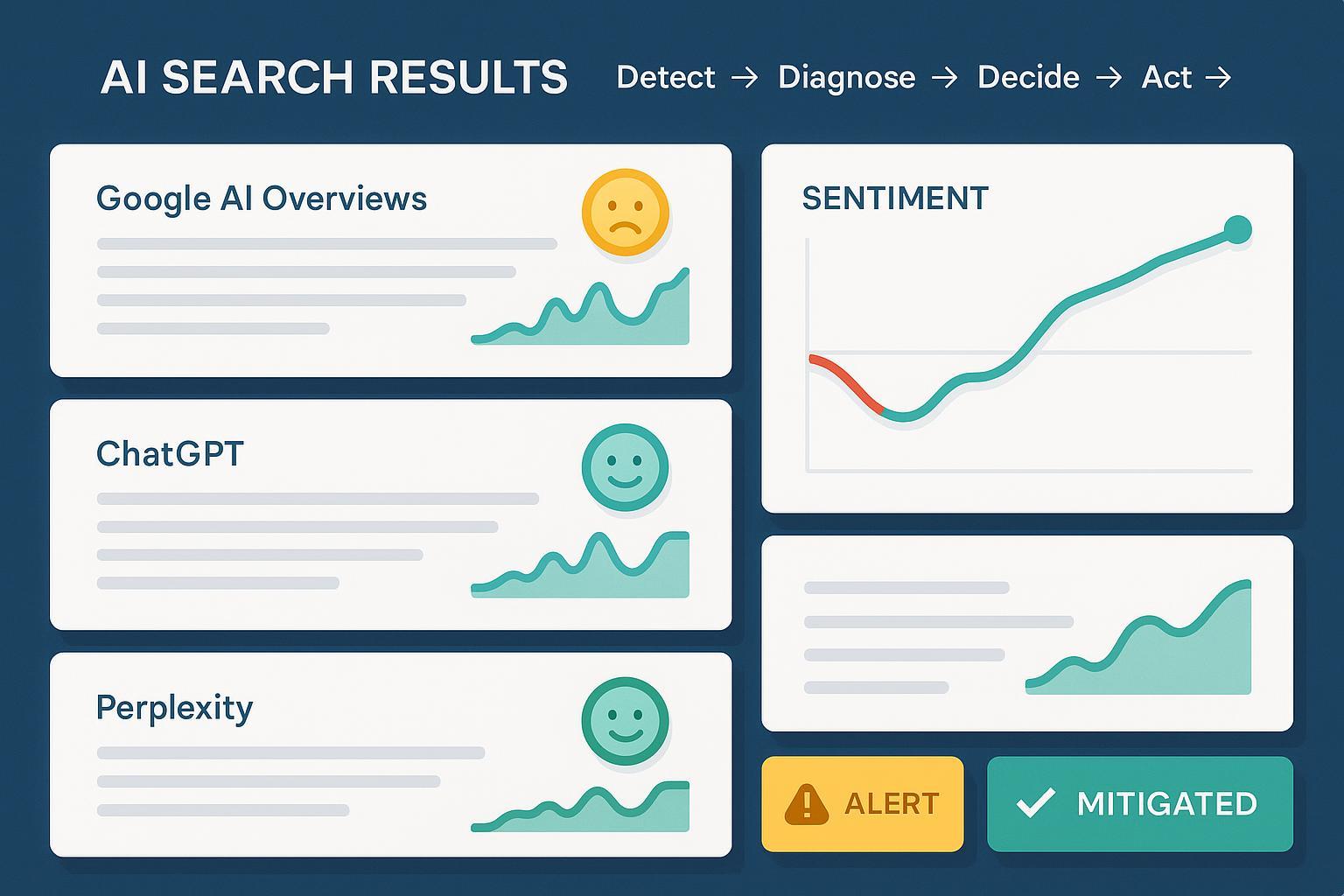

Dieses Best‑Practice‑Paper richtet sich an Kommunikationsleitungen, Brand‑ und SEO‑Teams sowie Agenturen. Es liefert einen praxiserprobten Workflow, um negative Zitate und Stimmungen in KI‑Antworten frühzeitig zu erkennen, strukturiert zu bearbeiten und messbar zu entschärfen – mit Beispielen aus dem Multi‑AI‑Monitoring (u. a. Geneo) und aktuellen Plattformempfehlungen 2025.

1) Warum KI‑Zitate heute Ihre Reputation bestimmen

- Reichweitenverschiebung: KI‑Antwortflächen stehen oberhalb klassischer Trefferlisten. Googles Entwickler empfehlen 2025 ausdrücklich, Inhalte weiterhin entlang E‑E‑A‑T und klarer Strukturierung zu erstellen, um in AI‑Features richtig interpretiert zu werden; siehe Google Developers: Succeeding in AI Search (2025).

- Quellenaggregation: Systeme wie Perplexity verknüpfen mehrere Quellen in einer Antwort und weisen prominent nach; das erhöht die Chance, dass einzelne negative Quellen den Ton setzen. Siehe Perplexity Hub – Getting started und Pro Search Upgrade.

- Regulatorische Erwartungen: Transparenzpflichten für generative KI wachsen. Der EU AI Act (2024/25) fordert u. a. klare Hinweise auf KI‑Inhalte und mehr Verantwortlichkeit, siehe EU-Kommission: Regulatory framework for AI und Europäisches Parlament – Überblick KI‑Gesetz.

2) Risikomodell: Impact × Probability × Correctability

Für die Priorisierung hat sich in der Praxis ein Dreiklang bewährt:

- Impact: Potenzial, Markenvertrauen oder Umsatz zu schädigen (z. B. falsche Sicherheitsangaben, Compliance‑Verstöße, Preis/Produktfehlinformationen).

- Probability: Sichtbarkeit/Reichweite der KI‑Antwort (SERP‑Position, Suchvolumen, Marken-/Generics‑Query, Wiederholungsrate in Tests).

- Correctability: Behebbarkeit (eigene Quelle aktualisierbar? verfügbarer Publisher‑Kontakt? UI‑Feedback‑Funktion?).

Praxis‑Tipps:

- Definieren Sie Schwellenwerte (z. B. „High“ ab Impact≥8/10 UND Probability≥7/10). High‑Severity Fälle lösen sofortige Eskalation aus.

- Ergänzen Sie „Factuality“ als vierten Faktor: Handelt es sich um klar falsche Tatsachenbehauptungen (Halluzination/Verwechslung) oder legitime, negative Rezensionen?

3) Detection & Triage: Always‑on statt Anlasskommunikation

Setzen Sie auf kontinuierliches Multi‑AI‑Monitoring mit klaren Alert‑Schwellen:

- Plattformabdeckung: Google AI Overviews, Perplexity, ChatGPT (mit/ohne Browsing), Bing/Copilot.

- Taxonomie: Taggen Sie Funde nach Plattform, Thema, Schweregrad, Quelle (eigene Seite, Drittquelle, Social, Review‑Portal), Faktizität (falsch/umstritten/negativ aber korrekt), Jurisdiktion (EU/US etc.).

- Alerts: Definieren Sie Trigger, z. B. „negatives Sentiment + markenrelevantes Keyword + High Probability“ → Sofortalarm an PR/SEO/Legal.

Praxisbeispiel: Mit Geneo lassen sich markenrelevante Queries plattformübergreifend überwachen, inklusive Echtzeit‑Erwähnungen, Sentiment‑Einstufung und Historienvergleich. Bei einem neuen, stark negativen Google‑AI‑Overview‑Snippet zu einer Produktlinie kann ein High‑Severity‑Alert automatisch ein Task‑Briefing für SEO/PR auslösen. Geneo bietet hierfür u. a. KI‑gestützte Sentiment‑Analysen, Mehrmarken‑Verwaltung und Content‑Optimierungsvorschläge (siehe Produktübersicht auf https://geneo.app).

4) Diagnose: Woran liegt die negative KI‑Antwort?

Führen Sie eine strukturierte Ursachenanalyse durch:

- Quelle prüfen: Enthält die KI‑Antwort verlinkte Belege? In Google AI Overviews werden Quellen angezeigt; die offiziellen Entwicklerdokumente zu AI‑Features geben Hinweise zur Darstellung, siehe Google Search docs: AI features. Perplexity zeigt Quellen prominenter; ChatGPT mit Webzugriff nennt teils Links.

- Aktualität: Ist die negative Information veraltet? Beschleunigen Sie Updates über Sitemaps und bei Bing via Bing Webmaster Tools – URL‑Submission & IndexNow, um Korrekturen schneller zu spiegeln.

- Halluzination vs. legitime Kritik: Liegt ein nachweisbarer Faktfehler vor (z. B. falsche Preise, unzutreffende Sicherheitswarnungen)? Oder handelt es sich um eine fundierte, aber kritische Drittmeinung?

- Kontext: Ist der Tenor negativ, weil konkurrierende Quellen dominieren (fehlende E‑E‑A‑T‑Signale, schwache Autorität Ihrer Inhalte)? Googles aktuelle Leitlinien unterstreichen 2025 erneut die Bedeutung klarer Autorenschaft, Referenzen und strukturierter Daten; siehe Google Developers: Succeeding in AI Search (2025).

5) Entscheidungsrahmen: Reagieren, ignorieren oder eskalieren?

Ein praktikables 3‑Wege‑Schema mit SLAs:

- Reagieren (SLA: ≤24–48h): bei hohen Impact‑Fällen, Faktfehlern, Rechtsrisiken, signifikanten Reichweiten.

- Beobachten/Optimieren (SLA: ≤5 Werktage): bei moderatem Impact, gemischtem Sentiment, teilweiser Korrektheit.

- Eskalieren (SLA: sofort): bei diffamierenden Aussagen, Compliance‑Verstößen, gesundheits-/sicherheitsrelevanten Falschinformationen. Einbezug Legal/Regulatory, Verweis auf Beschwerdewege und Dokumentation im Sinne des EU AI Act Rahmenwerks.

Rollen und Verantwortlichkeiten:

- SEO/Content: Korrigiert Source‑of‑Truth, stärkt Markups/E‑E‑A‑T, stößt Re‑Indexierung an.

- PR/Comms: Formuliert Stellungnahmen, koordiniert Publisher‑Outreach, managed öffentliche Antworten.

- Legal/Compliance: Prüft Risiken und schreibt Eskalationspfade fest.

- Owner/On‑Call: Duty‑Roster mit klaren Bereitschaftszeiten, damit High‑Severity‑Alerts nicht versanden.

6) Aktionsmuster: Was wirkt schnell und nachhaltig

A) Source‑of‑Truth korrigieren und auffindbar machen

- Content‑Updates: Ergänzen Sie strittige Passagen mit klaren Belegen, Daten, Veröffentlichungsdatum und verantwortlicher Autorenschaft. Nutzen Sie strukturierte Daten (Product, FAQ, Organization), halten Sie diese aktuell; siehe Google Search updates (Developers).

- E‑E‑A‑T stärken: Fallstudien, Originaldaten, Expert:innenprofile, transparente Methodik. Googles 2025er Hinweise bestätigen, dass solche Signale helfen, AI‑Features verlässlich zu bedienen; vgl. Succeeding in AI Search (2025).

- Freshness erzwingen: Sitemaps aktualisieren; für Bing/Copilot zusätzlich IndexNow nutzen, um neue/aktualisierte URLs zeitnah zu melden, siehe Bing Webmaster Tools – URL Submission & IndexNow.

B) Direktes Plattform‑Feedback und Korrekturanfragen

- Google AI Overviews: Melden Sie ungenaue Antworten über die integrierte Feedback‑Funktion. Die Supportseiten erläutern, wie Feedback im KI‑Modus abgegeben wird; siehe Google Support: KI‑Modus/Feedback geben sowie Hinweise zu AI Overviews Feedback.

- Perplexity & ChatGPT: Nutzen Sie UI‑Feedback und Supportkanäle. OpenAI dokumentiert Richtlinien und Sicherheitsmaßnahmen im Kontext von GPT‑4o; siehe OpenAI – GPT‑4o Systemkarte und OpenAI Usage Policies. Perplexity beschreibt Funktionsweisen und verweist auf Support/Legal; siehe Perplexity Hub – Getting started und Terms of Service.

C) Öffentliche Antworten und Empathie‑Techniken

- Prinzipien: schnell, sachlich, empathisch, belegt. Kein Defensiv‑Ton, sondern lösungsorientiert („Wir haben X aktualisiert; hier sind die Belege“).

- Mikrovorgaben für Antworten:

- „Danke für den Hinweis auf [Thema]. Wir haben die betreffenden Informationen aktualisiert und mit Quellen hinterlegt. Details finden Sie in unserem aktualisierten Leitfaden vom [Datum].“

- „Die genannte Aussage bezog sich auf eine frühere Produktversion. Seit [Datum] gilt [neuer Fakt], belegt durch [Link zu Primärquelle].“

- Interne Prompt‑Snippets (für Entwürfe, die anschließend von Menschen geprüft werden):

- „Formuliere eine kurze, empathische Klarstellung zu [Thema], die Quelle [URL] zitiert und keine Schuldzuweisungen enthält.“

D) Content‑Amplification und Link‑Earning

- Publizieren Sie Klarstellungen als eigenständige Updates (FAQ/Blog/Release Notes) und sorgen Sie für Distribution (Newsletter, Branchenmedien). Antworten wie jene in Perplexity profitieren von autoritativen, gut zitierten Quellen.

E) System‑Integrationen und Automatisierung

- Ticketing: Leiten Sie High‑Severity‑Alerts automatisiert in PR/SEO‑Queues (z. B. Jira/Asana) ein; hinterlegen Sie Aufgaben‑Vorlagen.

- Playbooks: Standardisierte Briefings je Szenario (Faktfehler, veraltete Information, legitime Kritik, rechtliches Risiko).

- Geneo‑Beispiel: Negative AI‑Zitate lösen in Geneo einen Alert mit vordefiniertem Schweregrad aus; das System erstellt ein Briefing mit betroffenen URLs, Sentiment‑Trend und Vorschlägen zur Content‑Optimierung, das direkt an SEO/PR übergeben wird.

7) Verifikation: Hat sich die KI‑Antwort verbessert?

- Re‑Prompts & A/B‑Tests: Reproduzieren Sie die Nutzerfrage in zeitlichen Abständen (z. B. T+24h, T+72h, T+7d), prüfen Sie die Antwort und Quellen.

- Sentiment‑Shift messen: Tracken Sie, ob sich der Ton in AI Overviews/Perplexity zu neutral/positiv verschiebt. Tools mit Historie helfen, den Trend zu belegen.

- KPI‑Set: Anteil korrigierter Faktfehler, Zeit bis zur Korrektur (MTTR), Anteil neutral/positiver Antworten, Sichtbarkeit kritischer Queries, Downstream‑Metriken (Klicks, Supporttickets). Als allgemeine Orientierungsgröße zur Bedeutung schneller Antworten auf Nutzerfeedback dient die oben zitierte BrightLocal 2024 Erhebung.

- Dokumentation: Halten Sie Änderungen/Feedback in einem Change‑Log fest. Das erleichtert die Nachvollziehbarkeit gegenüber Rechts-/Compliance‑Anforderungen im Sinne des EU‑Rahmens.

8) Governance & Compliance: Was Sie nicht delegieren sollten

- Richtlinien: Legen Sie interne Kriterien fest, wann öffentlich geantwortet, korrigiert, eskaliert wird. Sensible Bereiche (Gesundheit, Finanzen, Recht) benötigen strengere Prüfschleifen.

- Transparenz: Kennzeichnen Sie KI‑Unterstützung intern; öffentliche Antworten bleiben menschlich verantwortet. OpenAI und andere Anbieter beschreiben Sicherheits-/Policy‑Rahmen; siehe OpenAI Usage Policies.

- EU AI Act: Beachten Sie Dokumentationspflichten und mögliche Beschwerdewege über nationale Behörden bei systematischen Falschdarstellungen, siehe EU‑Leitfaden zur Anwendung erster AI‑Act‑Regeln.

9) Häufige Fehler und Lessons Learned

- Zu spät reagieren: Ohne Schwellenwerte/On‑Call‑Regelung verpassen Teams das kritische Zeitfenster.

- Nur Symptome behandeln: UI‑Feedback ohne Source‑Update verpufft häufig. Erst die Primärquelle stärken, dann Feedback geben.

- Über‑Reaktion: Juristische Schritte zu früh können den Streisand‑Effekt auslösen. Erst sauber prüfen (Faktizität, Kontext, Reichweite).

- Kein Erfolgsnachweis: Ohne Historien‑Tracking und KPIs bleibt unklar, ob Maßnahmen wirken.

10) Mini‑Playbooks und Checklisten

A) Monitoring‑Setup (30 Minuten)

- Definieren Sie 15–30 markenrelevante Queries (Brand, Produkt, kritische Themen) je Markt.

- Aktivieren Sie plattformübergreifendes Monitoring (Google AI Overviews, Perplexity, ChatGPT, Bing/Copilot).

- Legen Sie Sentiment‑Schwellen fest (z. B. <=‑0,3 negativ), Severity‑Matrix und Alert‑Kanäle.

- Hinterlegen Sie Owner und Fallback‑Vertretungen (On‑Call‑Plan).

B) First‑Response (unter 24–48h)

- Screenshot/Link sichern; Quellen prüfen; Faktizität einstufen.

- Quick‑Fix: Primärquelle aktualisieren (Datum, Belege, strukturierte Daten), Re‑Indexierung anstoßen (Sitemaps/IndexNow).

- Plattform‑Feedback absetzen (Google AI Overviews Feedback, Perplexity/ChatGPT Support/Feedback).

- Öffentliche Kurzantwort vorbereiten; Veröffentlichung nach Legal‑Check.

C) Nachhaltige Entschärfung (1–2 Wochen)

- Autoritative Inhalte veröffentlichen (FAQ, Case, Datenblatt) und distribuieren.

- E‑E‑A‑T stärken (Autorenprofile, Methoden, Referenzen).

- Monitoring der Query‑Antworten im Wochenrhythmus; MTTR und Sentiment‑Shift reporten.

D) Rollen & SLAs (Beispiel)

- On‑Call (täglich): Sichtprüfung High‑Alerts, Reaktionsstart ≤2h.

- SEO (48h): Content/Markup‑Update, Re‑Index anstoßen.

- PR (48h): Stellungnahme/Outreach vorbereiten.

- Legal (bei Bedarf ≤24h): Risiko‑Check, Eskalationsfreigabe.

Schlussgedanke: Negative Zitate in KI‑Antworten sind kein Ausnahmefall, sondern ein dauerhafter Operationsfall. Teams, die Detection‑to‑Correction als wiederholbaren Prozess aufsetzen, gewinnen. Wer Monitoring, klare Schwellenwerte, schnelle Korrekturen an Primärquellen und empathische Kommunikation kombiniert – und die Wirkung laufend misst – schützt Reputation und Performance nachhaltig.

Praxis‑Tipp: Wenn Sie Multi‑AI‑Monitoring, Sentiment‑Analyse und Workflows zentralisieren möchten, testen Sie ein spezialisiertes Tool wie Geneo für Echtzeit‑Alerts, Historien‑Tracking und Content‑Optimierungsvorschläge: https://geneo.app