Wie LLM-Reasoning GEO & AI Overviews 2025 neu definiert

Erfahren Sie, wie verbessertes LLM-Reasoning 2025 GEO-Taktiken für AI Overviews, ChatGPT und Perplexity verändert. Mit neuen Metriken und Praxis-Insights – jetzt updaten!

Der neue Auswahlprozess: Warum Reasoning den Unterschied macht

Generative Antworten verändern die Sichtbarkeit im Web: Ob Google AI Overviews, ChatGPT mit Browsing/Deep Research oder Perplexity – die Modelle wählen Quellen nicht mehr nur nach klassischen SEO‑Signalen aus, sondern nach Konsistenz, Nachprüfbarkeit und evidenznaher Struktur. Das führt zu Zero‑Click‑Effekten und verschiebt Zitationen hin zu Seiten, die maschinell gut überprüfbar sind. Die Frage ist nicht nur „wie komme ich in die AI Overview“, sondern: Wie baue ich Inhalte so, dass Reasoning‑Module sie verlässlich verifizieren und zitieren?

GEO vs. klassisches SEO: Was 2025 zählt

GEO (Generative Engine Optimization) zielt darauf ab, die Nennung und Verlinkung in generativen Antworten zu erhöhen. SEO bleibt die Eintrittskarte – besonders bei Google, wo AI Overviews oft stark mit Top‑Quellen der organischen Suche korrelieren. GEO ergänzt das um strukturierte Evidenz, klare Entitäten und extrahierbare Snippets.

- Wenn Sie „AI Visibility“ und neue GEO‑KPIs systematisch einordnen möchten, hilft die Definition mitsamt Metriken im Beitrag „AI Visibility“: AI Visibility: Definition und Metriken.

- Für den strategischen Vergleich von SEO und GEO siehe den Leitfaden: Traditionelles SEO vs. GEO – Vergleich.

Was sich in den Plattformen 2025 sichtbar geändert hat

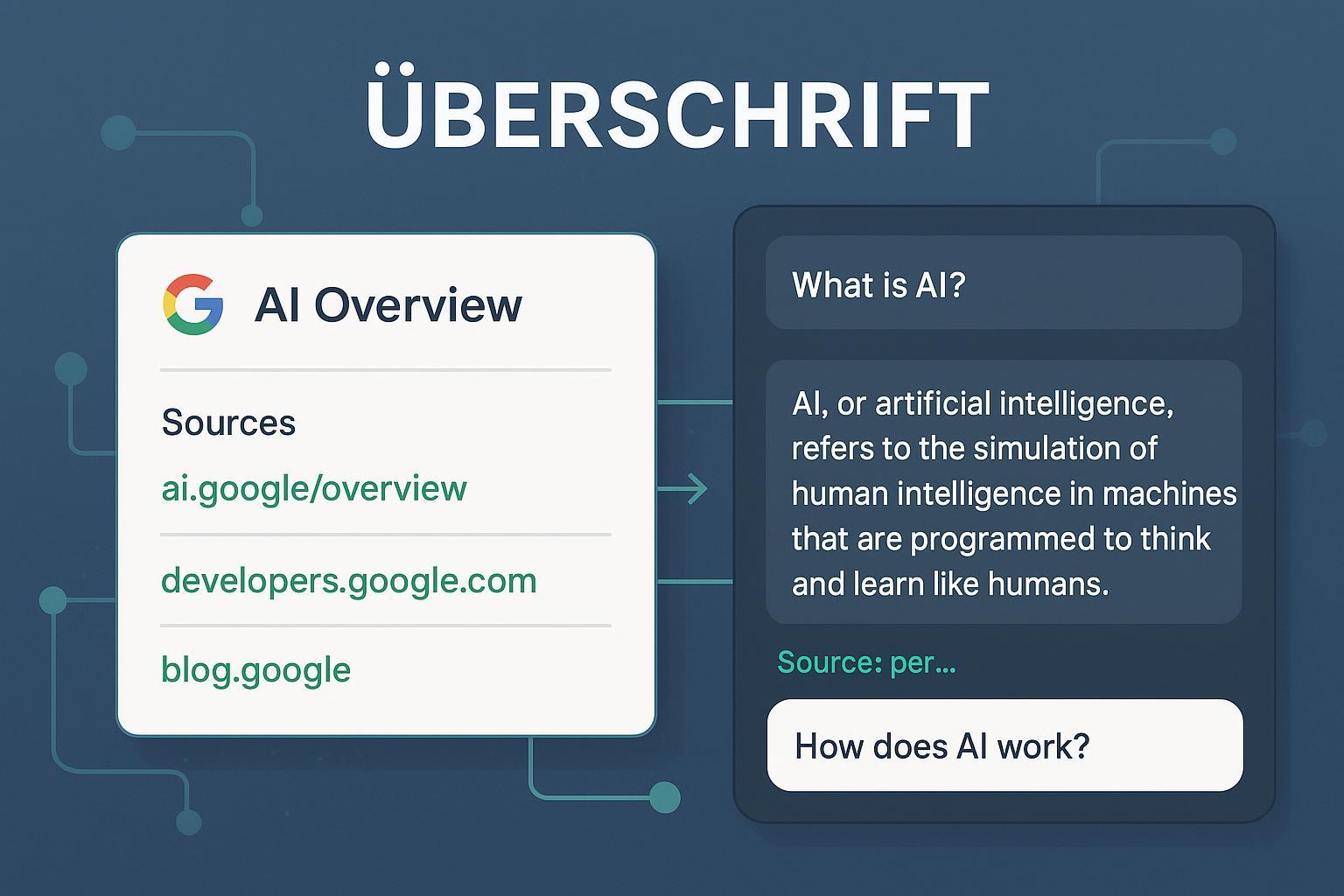

Google hat AI Overviews („Übersicht mit KI“) im März 2025 für Deutschland offiziell angekündigt – die Zusammenfassungen stehen über den klassischen Treffern und zeigen unterstützende Quellen an, wie der deutschsprachige Google‑Blog zum Start von AI Overviews beschreibt. Die Auswahl der Quellen erfolgt modellgestützt; Details zur Darstellung und zu AI‑Features finden sich in Google Search Central: AI Features and Your Website.

Parallel hat Google die Reasoning‑Fähigkeiten der Modelle ausgebaut. Die Gemini‑API dokumentiert 2025 einen konfigurierbaren „Thinking“‑Prozess mit mehrstufigem Planen; Entwicklerhinweise stehen in Gemini‑Thinking‑Docs (2025). Produktblogs zu neueren Releases betonen „advanced tool use and planning“ für komplexe Aufgaben.

Anthropic stellte im Februar 2025 Claude 3.7 Sonnet als „Hybrid Reasoning“‑Modell vor, inklusive sichtbar schaltbarem „extended thinking“ für Schritt‑für‑Schritt‑Begründungen. Näheres erläutert Anthropic: Claude 3.7 Sonnet und Visible Extended Thinking (2025).

OpenAI wiederum beschreibt 2025 sowohl die o3/o4‑mini‑Reihe als Reasoning‑Update als auch den autonomen Recherchemodus „Deep Research“, der strukturierte Berichte mit Quellenangaben erzeugt. Siehe OpenAI: Einführung von Deep Research (2025).

Messungen zum Anteil der Suchanfragen mit AI Overviews variieren: Eine deutsche Stichprobe von SE Ranking (99.964 Keywords, Mai 2025) sieht 27,86 % AIO‑Anteil; SISTRIX berichtet für Deutschland rund 17 % im Jahresverlauf. Eine US‑Panelstudie von Pew (März 2025; ~69.000 Queries) zeigt ca. 18 % AIO und geringere Klickneigung, wenn eine Zusammenfassung erscheint. Die Spannbreite unterstreicht: Zahlen sind abfrage‑ und zeitabhängig.

Kompakter Überblick ausgewählter Messungen (2025)

| Quelle | Zeitraum/Land | Stichprobe | Kennzahl | Ergebnis |

|---|---|---|---|---|

| SE Ranking (DE) | 21.–23.05.2025 (DE) | 99.964 Keywords | Anteil mit AIO | 27,86 % |

| SISTRIX (DE) | 2025 (DE) | n. n. | Anteil mit AIO | ~17 % |

| Pew Research (US) | 03/2025 (US) | ~69.000 Queries | Anteil mit AIO; Klickverhalten | ~18 %; weniger Klicks |

Warum Reasoning strukturierte Evidenz bevorzugt – und wie man Inhalte dafür baut

Reasoning‑Modelle verbinden Informationen aus mehreren Quellen, prüfen Konsistenz und bevorzugen sauber belegte Inhalte. Die Konsequenz: Struktur schlägt Prosa. Seiten mit klarer Methodik (Datumsstempel, Stichproben, Quellenlinks), eindeutigen Entitäten (Organisation, Autor, Produkt) und maschinenlesbaren Repräsentationen (JSON‑LD, Tabellen, Datendownloads) sind zitatwürdiger.

Praktische Bausteine:

- Duale Content‑Formate: Erzählerische Abschnitte für Menschen plus extrahierbare Fragmente – FAQs, nummerierte Schritte, kurze Claim‑Zusammenfassungen, Databoxen.

- Evidenzblöcke: Kurze Kästen mit Methode, Zeitraum, Stichproben und Links (im Fließtext sichtbar), damit interne „Thinking“‑Prozesse eine klare Prüfschiene haben.

- Strukturierte Daten: JSON‑LD für Article, FAQPage, ClaimReview und Dataset. Die Google‑Dokumentation zu AI‑Features und strukturierten Daten ist Ausgangspunkt; siehe Search Central: AI Features (2025). Schema‑Vokabular finden Sie auf Schema.org.

- Datenbereitstellung: Maschinenlesbare Assets (JSON/CSV‑Downloads, öffentliche API‑Endpunkte, tabellarische Zusammenfassungen) erleichtern Tool‑Use und Attribution.

Für die operative Umsetzung lesen Sie gerne den praxisorientierten Leitfaden mit Beispielschritten: Content für AI‑Zitationen optimieren – Schritt‑für‑Schritt.

Plattform‑spezifische Playbooks (Google, Perplexity, ChatGPT)

- Google AI Overviews: Starke Korrelation mit organischen Top‑Quellen bleibt bestehen. Daher Dual‑Optimierung: klassische SEO‑Grundlage plus GEO‑Signale. Konsistenz über Repräsentationen (On‑Page, JSON‑LD, ggf. Dataset/API) erhöht die Verlässlichkeit. Kurze, gut zitierbare Snippets und klare FAQs helfen, „citation‑ready“ Passagen bereitzustellen.

- Perplexity: Das System zeigt standardisiert anklickbare Quellen direkt unter der Antwort an und belohnt transparente, evidenzstarke Inhalte. Halten Sie Ihre Kernaussagen über mehrere glaubwürdige Hosts verfügbar und sorgen Sie für klare Belege, damit Mehrquellen‑Synthese zuverlässig wird.

- ChatGPT (Browsing/Deep Research): Zitationsfrequenz variiert, doch extrahierbare Schritte, FAQs und methodische Notizen werden häufig übernommen. Wenn Deep Research genutzt wird, profitieren strukturierte Datasets und API‑Dokumentationen, weil Agenten diese gezielt referenzieren können.

Messen, monitoren, iterieren

Neue Sichtbarkeit verlangt neue Metriken und Routinen. Ein mögliches KPI‑Set:

- AIO Inclusion Rate: Anteil der relevanten Suchanfragen, bei denen Ihre Domain in der AI Overview als Quelle erscheint.

- AI Citation Frequency: Anzahl der Zitationen Ihrer Marke/Domain in generativen Antworten über eine definierte Prompt‑/Query‑Liste.

- AI Share of Voice: Anteil Ihrer Marke an allen AI‑Erwähnungen in einem Themencluster.

- Sentiment der AI‑Erwähnungen: Tonalität der genannten Passagen (positiv/neutral/negativ) in generativen Antworten.

- Prompt‑Level‑Trigger: Welche Formulierungen/Unterfragen lösen Zitationen aus – und welche nicht?

Cadence und Betrieb:

- Wöchentliche Checks für Kernprompts, 14‑tägige Iterationen der „citation‑ready“ Snippets, monatliche Tests neuer Prompt‑Cluster.

- AI‑Bot‑Traffic getrennt loggen; Änderungen protokollieren; redaktionelle Regeln für Evidenzblöcke und Entitätenführung dokumentieren.

Disclosure: Geneo ist unser Produkt. Als Monitoring‑Beispiel kann ein Tool wie Geneo genutzt werden, um AI‑Erwähnungen und Zitationen plattformübergreifend zu verfolgen, Sentiment zu erfassen und historische Vergleiche zu führen. Für Kontext zu Nutzerverhalten und Messrhythmen siehe auch: AI Search User Behavior 2025 und zur Metrikdefinition den Überblick: Geneo Review – Tracking von AI‑Search‑Visibility.

Risiken, Compliance und wo Zahlen schwanken

- Variabilität der Messwerte: Der Anteil von AI Overviews schwankt je nach Land, Zeitraum und Methodik. Kennzeichnen Sie Zahlen immer mit Quelle und Jahr und prüfen Sie regelmäßige Updates.

- Crawler‑Signale: 2025 gibt es keinen breit anerkannten llms.txt‑Standard. Steuerung erfolgt primär über robots.txt und anbieter‑spezifische User‑Agents (etwa GPTBot, ClaudeBot, PerplexityBot). Hintergrund und Praxisempfehlungen bietet u. a. Cloudflare: Crawler‑Trends 2025 sowie Überblicksartikel zu llms.txt.

- Datenschutz und Recht: Offene Daten, APIs und Bot‑Zugriffe müssen mit DSGVO und vertraglichen Vorgaben vereinbar sein. Prüfen Sie Freigaben, Nutzungsbedingungen und Log‑Analysen.

Fazit: GEO ist Strukturarbeit – Reasoning entscheidet über Zitatwürdigkeit

Think of it this way: Wenn Inhalte wie sauber beschriftete Datenpakete vorliegen – klarer Kontext, belegte Aussagen, maschinenlesbare Repräsentation –, dann haben Reasoning‑Modelle weniger Zweifel und greifen eher zu. Für Marken bedeutet das: Dual optimieren (SEO + GEO), Evidenz sichtbar machen, strukturiert publizieren und konsequent messen. Wer diese Arbeit tut, verbessert die Chancen, in AI Overviews und generativen Antworten nicht nur aufzutauchen, sondern als verlässliche Quelle zu gelten.