Kurzform vs. Longform Content: KI-Antworten & Sichtbarkeit 2025

Vergleich Kurzform vs. Longform: Welche Content-Länge überzeugt 2025 bei generativer Suche (Google AI Overviews, Perplexity, ChatGPT)? Zitationsrate, Traffic, Struktur & Effizienz im Check.

by

Tony Yan

TL;DR

- Länge allein gewinnt nicht. Entscheidend sind Klarheit, Vollständigkeit, Struktur und Intent-Fit – bestätigt durch Googles Qualitätsprinzipien rund um „Helpful Content“ (03/2024) in den Google Search Central Richtlinien.

- Für komplexe, mehrteilige Informations-Intents erhöht Longform die Zitationschance in AI Overviews; extrahierbare Module (TL;DR, Key Facts, FAQs) sind dabei der Hebel. Häufigkeit und Trigger-Muster zu AOs zeigen aktuelle Analysen von SEMrush (03/2025) und SE Ranking (11/2024).

- Traffic verschiebt sich: Unter AO-Präsenz fällt die CTR des organischen #1-Ergebnisses deutlich (US-Daten 2025) laut Search Engine Journal Übersicht (05/2025) und dem Ahrefs-Analysebeitrag (2025). Zero-Click steigt.

- Perplexity/ChatGPT: Präferieren klare, autoritative, gut strukturierte Quellen; robuste Prozentwerte zur Überlappung mit Google fehlen. Einordnung bietet der ComputerBase-Vergleichstest (2025) und die RTR-Studie (2025).

- Best of both worlds: Kombiniere Longform (für Tiefe und Abdeckung von Unterfragen) mit snippetfreundlichen Kurzmodulen pro Abschnitt.

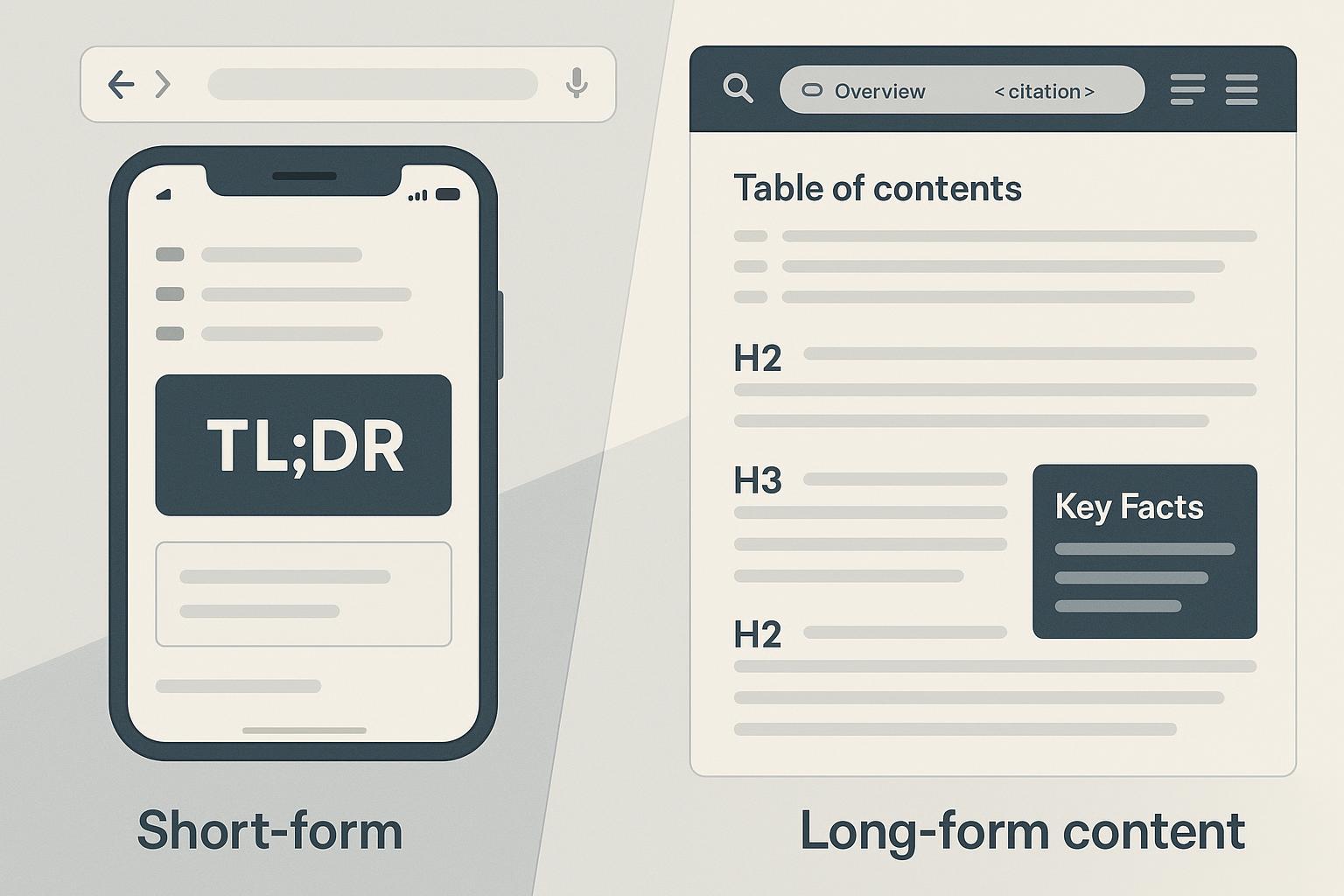

Was meinen wir mit Kurzform und Longform?

- Kurzform-Content: bis ca. 700–800 Wörter; fokussiert, knapp, klare Antwort, Listen/Schritte, FAQs.

- Longform-Content: ab ca. 1.500–2.500+ Wörter; umfangreich, mehrere Unterfragen, Inhaltsverzeichnis, Daten/Belege, Abschnitte.

Wichtig: Google hat keine Längenvorgabe; „Wortanzahl ist kein Rankingfaktor“. Entscheidend ist, ob Inhalte Menschen helfen und den Intent treffen – vgl. Google Search Central zum Core Update & „Helpful Content“ (03/2024).

Wie generative Suche Discovery verändert

- Google AI Overviews (AOs): Sichtbare Antwortboxen über der klassischen SERP. Auftretensrate schwankte 2024–2025, mit Informations-Queries als Haupttreiber; vgl. SE Ranking Recap 2024 und die US-Zeitreihe in der SEMrush AO-Studie (03/2025).

- Perplexity: Aggregiert Antworten mit Quellenangaben; Qualitäts- und Zuordnungsfragen werden diskutiert. Praxisnahe Einordnung liefert der ComputerBase-Test (2025).

- ChatGPT (Browsing): Liefert Antworten mit Links, häufig auf populäre Wissensquellen; robuste, quantifizierte Domänen-Anteile fehlen. Überblick zur Mediennutzung in der RTR-Studie 2025.

Konsequenz: Inhalte, die leicht zu „extrahieren“ sind (klare Überschriften, definierte Antworten, Tabellen/Listen), werden häufiger herangezogen – unabhängig von Länge.

Kurzform vs. Longform: Schneller Überblick nach Entscheidungskriterien

| Dimension | Kurzform-Content (≤ ~800 W.) | Longform-Content (≥ ~1.500 W.) |

|---|---|---|

| Zitationschance in AI Overviews | Gut bei eindeutigen, konkreten Fragen mit präziser Antwort; starke Snippet-Tauglichkeit | Stark bei komplexen Intents mit Unterfragen; zusätzlich Kurzmodule (TL;DR, Key Facts) erhöhen Extrahierbarkeit |

| Traffic/CTR | Eher geeignet, wenn Nutzer schnelle Antwort wollen; geringere Scrolltiefe, schnelle Zufriedenheit | Besser für Themen, die Recherche-Tiefe verlangen; kann trotz AO Klicks ziehen, wenn als zitierte Quelle gelistet |

| Struktur/Extrahierbarkeit | Listen, Schritt-für-Schritt, FAQs, definitorische Passagen | Inhaltsverzeichnis, H2/H3-Logik, Abschnitts-Summaries, Tabellen, Datenkästen |

| Aktualität/Frische | Schnell aktualisierbar, gut für News/Änderungen | Erfordert Update-Routine und Versionierung, besonders bei Evergreen-Assets |

| E-E-A-T | Kompakte Autor- und Quellenangaben ausreichend | Ausführliche Belege, Originaldaten, Autorprofil, Methodikabschnitt stärken Vertrauen |

| Intent-Passung | „Was ist…?“, How-to, Produkt-FAQ, Preis/Feature-Fragen | „Vergleich/Analyse/Studie“, Leitfäden, komplexe Entscheidungen |

| Aufwand & Pflege | Schnell produziert, häufigere Iteration | Höherer Initialaufwand, dafür deckt viele Subintents ab |

| Messbarkeit | Gut für schnelle Experimente (A/B-Varianten) | Mehr KPIs pro Seite (Scrolltiefe, Abschnitts-Engagement, Zitier-Cluster) |

Beweisgestützte Vertiefung der wichtigsten Unterschiede

1) Zitationsmuster in Google AI Overviews

- Informations- und komplexe Queries triggern AOs überdurchschnittlich häufig. Das zeigen die 2024/2025-Analysen von SE Ranking (11/2024) und die US-Entwicklung laut SEMrush-Studie (03/2025).

- Harte Zahlen, wie oft AOs Quellen jenseits der Top-10 zitieren, sind öffentlich kaum dokumentiert. Branchenbeobachtungen deuten auf eine breite Quellenauswahl hin; saubere Primärstudien fehlen. Daher: Longform für Tiefe plus snippetfreundliche Kurzmodule, um die Chancen bei komplexen Queries zu erhöhen.

2) Klickverhalten und Zero-Click-Effekt

- Unter AO-Präsenz sinkt die CTR des organischen #1-Ergebnisses signifikant (US-Daten 2025). Siehe die Zusammenfassung bei Search Engine Journal (05/2025) und die Einordnung im Ahrefs-Beitrag (2025).

- Publisher verzeichnen insgesamt weniger Klicks bei AO-Präsenz, wie die Branchenanalyse von Digital Content Next (05/2025) berichtet.

- Zero-Click-Trends werden 2024/2025 breit diskutiert; Meta-Zusammenstellungen zu AO-Anteilen liefern z. B. SE Ranking Statistiken (DE-Seite, 2024/2025). Fazit: Planen Sie Inhalte so, dass sie entweder in der AO-Box zitiert werden oder genügend „Unique Value“ bieten, um Klicks zu rechtfertigen.

3) Perplexity und ChatGPT: Quellenpräferenzen

- Perplexity zeigt Quellen standardmäßig an; im Praxisvergleich gibt es Qualitäts- und Zuordnungsunterschiede je nach Query, wie der ComputerBase-Test (2025) dokumentiert.

- Für ChatGPT-Browsing und allgemeine Mediennutzung in KI-Kontexten existieren qualitative Einordnungen, aber wenige belastbare Prozentwerte je Domain. Eine aktuelle Übersicht bietet die RTR-Studie (2025). Ein weiterer Blick auf Quellenlandschaften findet sich in einem Branchenbericht über Chatbot-Quellenabdeckung bei der Economic Times (2025) mit Semrush-Bezug – methodische Details bleiben dort jedoch begrenzt.

4) Strukturierbarkeit/Extrahierbarkeit

- Gute Extrahierbarkeit bedeutet: klare H2/H3-Logik, prägnante Absätze, Listen, Tabellen, definitorische Sätze und Abschnitts-Zusammenfassungen. Best-Practice-Leitfäden verweisen explizit darauf – etwa die Hinweise zu AOs bei SEO.com (2024/2025) und die Schema/FAQ-Empfehlungen von Outreach Monks (2024/2025).

- Interne Verlinkung und Themencluster erhöhen Kontextsignale für umfangreiche Inhalte; vgl. die Praxisanleitungen von timwir (DE) und zu Überschriften von Indexlift (DE) bzw. seowind (DE).

5) Aktualität und E-E-A-T

- Regelmäßige Updates mit sichtbarem Änderungsdatum und ggf. Versionierung verbessern Wahrnehmung und Vertrauen – im Sinne der Qualitätsprinzipien von Google (vgl. Google Search Central, 03/2024).

- E-E-A-T-Signale (Autorprofil, Quellen, Originaldaten, Methodik) unterstützen Auswahlentscheidungen von KI-Systemen und Nutzern. Konkrete Kausalstudien zur AO-Zitationswahrscheinlichkeit sind selten; dennoch empfehlen Branchen-Guides wie SEO.com zu AOs solche Signale ausdrücklich.

6) Aufwand, Kosten und Pflege

- Öffentliche Benchmarks mit harten Stunden-/Kostenwerten für Kurzform vs. Longform sind rar. Branchenerfahrungen deuten auf 1–3 Stunden für Kurzform und 10–40+ Stunden für tiefe Longforms hin (Schätzkorridor, ohne harte Primärquelle 2024/2025). Konsequenz: Planen Sie Pflege-Routinen für Longform und nutzen Sie Kurzform für schnelle Iterationen.

7) Messbarkeit und KPIs in der generativen Suche

- AI-Referrals identifizieren: In Analytics tauchen u. a. Domains wie chat.openai.com/chatgpt.com (ChatGPT) oder perplexity.ai (Perplexity) auf. Medienanalysen beschreiben den wachsenden Anteil dieser Referrals, z. B. in der Press Gazette (2025).

- GA4-Setups: Praxisguides zeigen, wie man ChatGPT-Referrals sauber trennt – siehe Rankshift Anleitung (2025) – und wie man AI-Traffic allgemein prüft, z. B. der HogTheWeb-Leitfaden (2025).

- Weitere KPIs: AO-Zitier-Rate (SERP-Screenshots/Tracking), SERP-Feature-Impressions, Scrolltiefe, Abschnitts-Engagement.

Playbooks: So kombinieren Sie Kurzform und Longform wirkungsvoll

Entscheidungsbaum (vereinfachte Logik)

- Ist die Nutzerfrage einfach und eindeutig? → Kurzform (Definition, Schritt-Liste, 1–2 prägnante Absätze, FAQ).

- Umfasst der Intent mehrere Unterfragen oder erfordert Belege/Daten? → Longform mit Inhaltsverzeichnis, Abschnitts-Summaries und „Key Facts“-Box.

- Ziel „AO-Zitation“? → Longform + TL;DR am Anfang, FAQ-Block, klare H2/H3, definitorische Sätze, ggf. FAQPage-/HowTo-/Article-Schema.

- YMYL/hoher Vertrauensbedarf? → Longform mit Autorprofil, Quellenapparat, Datum, Methodik.

Onpage-Bausteine, die KI-Systeme lieben

- TL;DR: 3–5 Bulletpoints, 50–90 Wörter – oben platzieren.

- Key Facts: Box mit Definitionen, Zahlen, Formeln, Normen.

- Abschnitts-FAQs: Pro H2 ein Mini-FAQ mit 1–2 Sätzen Antwort.

- Tabellen/Listen: Prozesse, Vor-/Nachteile, Parameter übersichtlich bündeln.

- Schema-Markup: Artikel/HowTo/FAQPage dort einsetzen, wo es semantisch passt.

- Metadaten: Änderungsdatum, Version, Autor:in klar ausweisen.

Szenario-Empfehlungen nach Use Case

- „Schnelle, konkrete Antworten“ (z. B. Produkt-FAQ, Preis, Definition): Kurzform mit definitorischem Einstieg, Liste und FAQ-Block. Ziel: in Perplexity/ChatGPT leicht zitierbar, AO-taugliche Snippets.

- „Komplexe Recherche/Entscheidung“ (z. B. Plattformvergleich, Strategieleitfaden): Longform mit Daten/Belegen, Abschnitten, Tabellen; zusätzlich TL;DR und Key Facts für Extrahierbarkeit.

- „Evergreen-Thema mit Updates“: Longform-Grundgerüst + schlanke Update-Notizen als Kurzform-Abschnitte. Klare Versionierung und Änderungslog.

- „Experiment/Speed-Iterations“: Kurzform-Serien zu eng umrissenen Fragen, um Snippet-Tauglichkeit und AI-Referral-Potenzial schnell zu testen.

KPI-Checkliste (3 Minuten)

- Ist der Intent klar identifiziert (einfach vs. komplex)?

- Gibt es eine präzise Antwort oben (Definition/TL;DR)?

- Sind H2/H3, Listen, Tabellen konsistent und semantisch sinnvoll?

- Sind Quellen/Autor sichtbar und aktuell (Datum/Version)?

- Tracken wir AI-Referrals (ChatGPT/Perplexity) separat in GA4?

- Sammeln wir AO-Zitier-Screenshots und beobachten SERP-Feature-Impressions?

- Prüfen wir Scrolltiefe/Abschnitts-Engagement für Longforms?

Häufige Fehlannahmen (und wie man sie vermeidet)

- „Mehr Wörter = besseres Ranking.“ → Nein. Relevanz, Qualität, Struktur, Intent-Fit zählen – siehe Google Search Central (03/2024).

- „Perplexity/ChatGPT zitieren nur Top-10-Seiten.“ → Nicht belegt. Quellenpräferenzen sind dynamisch; Struktur, Autorität und Klarheit sind der Hebel. Siehe die kontextualisierte Betrachtung in ComputerBase (2025) und RTR (2025).

- „Kurzform funktioniert nicht in AOs.“ → Doch, bei eindeutigen Fragen kann Kurzform sehr gut extrahiert werden – besonders mit definitorischen Sätzen, FAQ und sauberer Überschriftenlogik.

Fazit

- Kurzform überzeugt bei klaren, konkreten Fragen und als modulare Bausteine für Snippets.

- Longform punktet bei komplexen Recherchen – vorausgesetzt, sie enthält snippetfreundliche Kurzmodule.

- Planen Sie Ihre Content-Architektur „AI-first“: Intent bestimmen, Extrahierbarkeit sichern, Aktualität halten, E-E-A-T sichtbar machen, AI-Referrals messen.

Auch interessant: Monitoring für generative Suche

- Geneo hilft Marken und Teams, Erwähnungen und Zitationen in ChatGPT, Perplexity und Google AI Overviews sowie die Stimmungslage und historische Entwicklungen zentral zu beobachten – nützlich, um die oben genannten KPIs (AI-Referrals, Zitier-Rate, Sichtbarkeit) regelmäßig zu prüfen und Maßnahmen abzuleiten.

Disclosure: Geneo ist unser Produkt.

by

Tony Yan