Langfristige GEO-Roadmap: Schritt für Schritt zur KI-Quelle

Erfahren Sie, wie Sie mit unserer Anleitung eine GEO-Roadmap erstellen: praxisnahe Schritte, Messbarkeit, technische Umsetzung und Troubleshooting für KI-Zitationen.

Wenn KI‑Assistenten die erste Anlaufstelle für Antworten sind, entscheidet Ihre Zitierfähigkeit darüber, ob Ihre Marke überhaupt im Gespräch vorkommt. Diese Anleitung zeigt, wie Sie eine belastbare, langfristige GEO‑Roadmap (Generative Engine Optimization) entwickeln, die Messbarkeit, Technik und Content‑Governance zusammenführt – ohne Heilsversprechen, aber mit klaren Schritten.

GEO kurz erklärt – und was sich von SEO unterscheidet

GEO optimiert Inhalte und Entitäten dafür, in generativen Antwortsystemen korrekt erwähnt und verlinkt zu werden – etwa in ChatGPT Search, Perplexity oder Googles AI Overviews. Während SEO Rankings und Klick‑Traffic priorisiert, fokussiert GEO die Präsenz in Antworten (Zitate, Erwähnungen, Linkeinblendungen) und deren Qualität. Offizielle und belastbare Einblicke liefern unter anderem die Ankündigung von ChatGPT Search durch OpenAI in „Introducing ChatGPT Search“, die Hinweise für Publisher zu Googles AI Overviews sowie der Produktüberblick „Perplexity – Getting Started“.

Kurz gesagt: GEO ergänzt SEO. Viele Prinzipien bleiben gleich (Technik, Autorität, eindeutige Aussagen), doch Ihr primäres Ziel ist, in KI‑Antworten als Referenz aufzutauchen – zuverlässig und korrekt.

Was Sie messen müssen: KPIs und Baseline

Ohne Baseline ist jede Roadmap blind. Legen Sie zu Beginn ein repräsentatives Fragen‑/Prompt‑Set pro Engine an (z. B. 30–50 Fragen je Monat) und dokumentieren Sie Zitate, Linkposition, Korrektheit und Tonalität. Eine vertiefende Einführung in Metriken finden Sie im Beitrag „AI Sichtbarkeit KPIs: Best Practices für Marken‑Erwähnungen & Zitierungen“ auf Geneo: AI Sichtbarkeit KPIs 2024 – Best Practices.

| KPI | Warum es zählt | So messen Sie heute |

|---|---|---|

| Citation Frequency / Share (AI Share of Voice) | Zeigt, wie oft Ihre Domain/Marke in Antworten zitiert wird – das GEO‑Pendant zu Rankings. | Manuelles Prompt‑Set je Engine; monatlich zählen und dokumentieren; Veränderung vs. Baseline tracken. |

| Engine Coverage | Prüft, ob Sie in ChatGPT Search, Perplexity und AI Overviews konsistent präsent sind. | Fixes Fragen‑Set engine‑übergreifend; Anteil Antworten mit Zitat/Link je Engine protokollieren. |

| Answer Quality & Sentiment | Korrektheit, Aktualität, Kontextpassung und Tonalität beeinflussen Vertrauen und Downstream‑Effekte. | Qualitätsraster (richtig/falsch/teilweise), Datumsprüfung, Kurzcodes fürs Sentiment (+/0/–). |

| LLM‑Referrals & Downstream‑Conversions | Zeigt Wirkung jenseits der Sichtbarkeit. Attribution ist schwierig, aber möglich. | UTM‑Konventionen (z. B. utm_source=chatgpt/perplexity/ai‑overview); Korrelationen zu Direct/Brand‑Suche; Guidelines wie Adobe Marketo Measure zu UTM‑Parametern. |

So viel zur Theorie – jetzt zur Praxis.

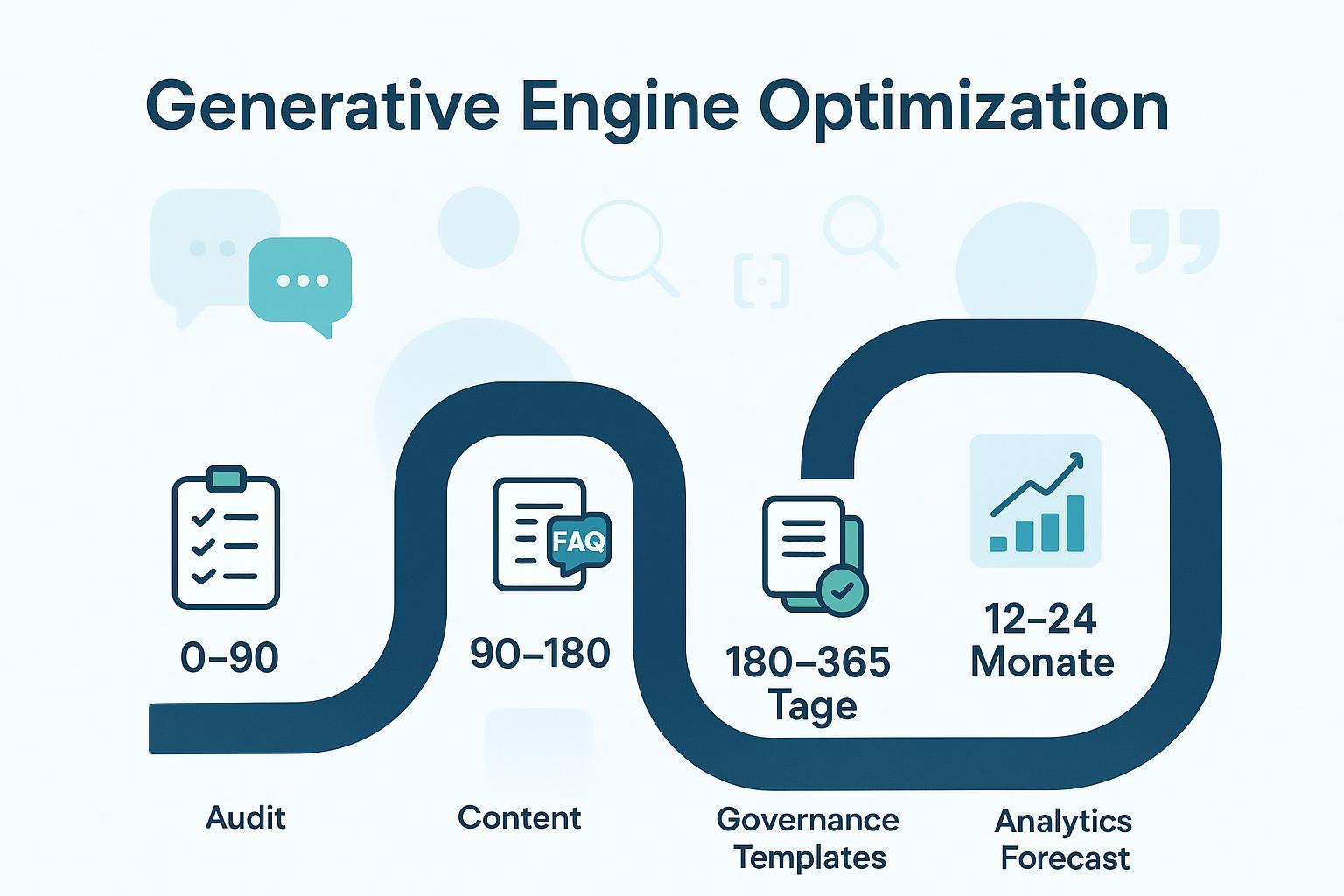

Die Roadmap in vier Phasen

Die folgenden Phasen sind ein praxistaugliches Gerüst. Planen Sie 90‑Tage‑Iterationen mit klaren Hypothesen, Reviews und Änderungsprotokollen.

0–90 Tage: Foundations

Beginnen Sie mit einem GEO‑Audit: Technik (HTTPS, Mobil‑Performance, Indexierbarkeit), strukturierte Daten, Autor:innen‑ und Organisationsseiten, Entitäten (Name, Synonyme, sameAs). Prüfen Sie, ob Inhalte eindeutige, belegte Aussagen liefern – mit klaren Abschnitten (Definitionen, FAQs, How‑tos) und sichtbaren Quellen.

Richten Sie Ihr Messsystem ein: Baseline‑Prompt‑Sets je Engine, KPI‑Definitionen, Dashboard‑Entwurf (Looker Studio/Power BI). Etablieren Sie UTM‑Namenskonventionen und eine einfache Qualitätscodierung für Antworten. Legen Sie eine Logik für Engine Coverage fest (z. B. jeweils 40 Kernfragen pro Monat, quartalsweise Rotation nach Cluster).

Härten Sie die Struktur: Setzen und validieren Sie Schema‑Typen wie Article/BlogPosting, FAQPage, HowTo, Person/Organization. Nutzen Sie Prüfwerkzeuge wie den Google Rich Results Test. Achten Sie darauf, dass Validierung Eignung bedeutet – keine Garantie auf Darstellung oder Zitat.

Stellen Sie Bot‑ und Crawl‑Richtlinien klar: Dokumentieren Sie Opt‑out‑Entscheidungen (z. B. Trainingsbots) und prüfen Sie robots.txt sowie Server‑Logs (mehr dazu unten). Ziel ist Transparenz, nicht pauschale Sperren.

90–180 Tage: Build & Expand

Erstellen und aktualisieren Sie Cluster‑Content mit expliziter Zitierfähigkeit: prägnante Definitionen, Zahlen mit Quellen, eigene Mini‑FAQs pro Seite, Glossarblöcke, Snippets mit eindeutigen Aussagen. Verdichten Sie die interne Verlinkung entlang thematischer Knoten. Aktivieren Sie PR/Comms gezielt für kontextrelevante Erwähnungen auf vertrauenswürdigen Domains (Branchenverbände, Studien, offizielle Stellen).

Experimentieren Sie pro Engine mit Antwortstrukturen: In Perplexity werden nummerierte Quellen angezeigt; testen Sie, welche Snippet‑Längen und Klarheit Ihrer Aussagen häufiger zitiert werden. In AI Overviews spielt Kontextbreite eine Rolle; prüfen Sie, ob Ergänzungen (z. B. Abdeckungsgrad eines Themas) die Auswahl fördern. Für ChatGPT Search verweisen OpenAI’s Einführung und Updates auf Antworten mit Quellen und Seitenleiste – testen Sie dort die Wirkung von klar gekennzeichneten Originaldaten.

180–365 Tage: Scale & Systematize

Standardisieren Sie, was funktioniert: Bibliotheken für Snippets, FAQ‑Bausteine, Zitier‑Vorlagen (inkl. Quellformat). Definieren Sie eine „Definition of Done“ für GEO‑Inhalte: valide Schema‑Prüfung, aktualisierte Autor:innenbox, mindestens ein belegter Fakt mit Quelle, aktualisiertes Veröffentlichungsdatum, interner Link auf das Primär‑Cluster.

Sichern Sie engine‑übergreifende Konsistenz: Stimmen die Kernaussagen und Entitäten über alle Formate überein? Gibt es Widersprüche zwischen Landingpages, Blog, Glossar? Etablieren Sie quartalsweise Reviews und eine Eskalationsroutine bei Qualitätsabweichungen.

12–24 Monate: Maturity

Arbeiten Sie an Attribution und Planung: Ergänzen Sie Ihr Dashboard um kontrollierte Experimente, bei denen definierte UTM‑Links in KI‑Antworten/Profilen vorkommen (wo möglich), und korrelieren Sie mit Brand‑Suche, Direct‑Traffic und Leads. Entwickeln Sie Forecasts auf Basis Ihrer Citation Share‑Trends und Themen‑Pipelines. Skalieren Sie Enablement (Schulungen zu Entitäten, Schema, Qualitätsraster) für Content‑, SEO‑, PR‑ und Legal‑Teams.

Mikro‑Beispiel: Monitoring von Zitierungen und Engine Coverage

Disclosure: Geneo ist unser Produkt. Viele Teams dokumentieren ihr monatliches Prompt‑Set (z. B. 40 Fragen je Engine), erfassen Zitate/Links und das Sentiment und führen Abweichungen zum Vormonat. Mit einem Tool wie Geneo können Sie diese Beobachtungen zentralisieren: Sichtbarkeit über ChatGPT Search, Perplexity und AI Overviews nachfragen, Zitationskontexte einsehen und historische Verläufe vergleichen. Formulieren Sie daraus Hypothesen („FAQ‑Snippet zu Thema X zeigt mehr Zitate in Perplexity“) und planen Sie die nächsten 90‑Tage‑Maßnahmen.

Technische Hygiene & Bots: Schema, Validierung, robots/Opt‑out, Logs

Strukturierte Daten sind kein Selbstzweck, aber ein verlässlicher Anker für Maschinen. Neben dem Rich Results Test hilft der Schema.org‑Validator und die Search Console für Fehlermuster. Halten Sie Autor:innen‑ und Organisationsseiten sauber (klare Rollen, sameAs‑Links, Kontakt und Impressum). Optimieren Sie Performance, insbesondere mobil.

Für Bots und Crawler gilt: Dokumentieren Sie Ihren Standpunkt und setzen Sie ihn korrekt um. Für GPTBot stellt OpenAI Opt‑out‑Informationen und IP‑Richtlinien bereit, siehe OpenAI‑Hilfecenter zu GPTBot/Training‑Opt‑out. Perplexity veröffentlicht User‑Agent und IP‑Liste, siehe PerplexityBot‑Dokumentation. Prüfen Sie Zugriffe per Server‑Logs (UA + IP), überwachen Sie Auffälligkeiten (Frequenz, Header, Cookies) und setzen Sie WAF‑Regeln, Rate‑Limits oder IP‑Sperren im rechtlichen Rahmen. Wichtig: Nicht jeder Opt‑out bezieht sich auf die Anzeige in Such‑/Antwortprodukten; bei Google‑Publisher‑Kontrollen (z. B. Google‑Extended) ist der genaue Einfluss auf AI Overviews nicht eindeutig dokumentiert. Verweisen Sie auf offizielle Suchdokumentation und formulieren Sie Entscheidungen konservativ.

Troubleshooting: Wenn Zitate ausbleiben, Schema fehlschlägt oder Attribution unklar bleibt

Bleiben Zitate in AI Overviews oder Perplexity aus, prüfen Sie zuerst die Zitierfähigkeit: Gibt es klare, eigenständige Aussagen mit Belegen? Sind Quellen sichtbar und aktuell? Enthalten Seiten eine Mini‑FAQ, die typische Nutzerfragen abdeckt? Sind Entitäten gepflegt (sameAs, konsistente Namensführung)? Ist die Seite mobil schnell und sauber indexierbar? Testen Sie alternative Snippets und beobachten Sie 4–6 Wochen.

Scheitert die Schema‑Validierung, gehen Sie systematisch vor: Pflichtfelder, Typkonsistenz, Sichtbarkeit im gerenderten HTML, erneuter Test mit dem Rich Results Test, Abgleich mit Search‑Console‑Fehlern. Halten Sie ein kurzes Debug‑Protokoll je Seite (Fehler → Fix → Retest → Datum), um Muster zu erkennen.

Ist die Attribution dünn, erhöhen Sie die Disziplin: Eindeutige UTM‑Parameter, Landing‑Page‑spezifische Short‑Links, zeitnahe Kampagnensplits, Korrelationen zu Brand‑Suche/Direct‑Traffic. Formulieren Sie Hypothesen, nicht Gewissheiten. Ergebnisse bleiben probabilistisch, aber Trends sind entscheidungsrelevant.

Governance & Cadence: Rollen, Definitionen, Reviews

GEO ist ein Teamsport. Weisen Sie Ownership zu: Strategy (GEO‑Lead), Technical SEO/Engineering, Content/Editorial, PR/Comms, Legal/Compliance, Data/Analytics. Vereinbaren Sie eine Cadence aus 90‑Tage‑Sprints, monatlichen KPI‑Reviews und Quartals‑Retro. Legen Sie Definitionen fest: Wann gilt ein Inhalt als „done“ (z. B. valide Schema‑Prüfung, aktualisierte Autor:innenbox, min. 1 belegter Fakt, interner Link aufs Themen‑Cluster, Quality‑Check)? Und wann ist etwas „ready for experiment“ (z. B. zwei alternative Snippets pro Seite, Prompts definiert, Messfenster 4 Wochen)?

Dokumentation schützt vor Wissensverlust: Halten Sie Backlogs, Änderungsprotokolle, Experiment‑Logs und eine kleine interne Wissensbasis bereit (Vorlagen für Zitier‑Snippets, FAQ‑Bausteine, Schema‑Patterns). Kleine Frage zwischendurch: Wie schnell könnten neue Teammitglieder Ihre GEO‑Standards verstehen? Wenn die Antwort „nicht sofort“ ist, fehlt noch Struktur.

Next Steps

- Starten Sie mit einer 30‑Tage‑Baseline: Fragen‑Set je Engine, Zitat‑Zählung, Qualitäts- und Sentiment‑Codes, UTM‑Konventionen fixieren.

- Schließen Sie Lücken bei Schema/Entitäten und richten Sie regelmäßige Validierung sowie Log‑Monitoring ein.

- Planen Sie die ersten 90‑Tage‑Experimente pro Engine (Snippet‑Varianten, FAQ‑Erweiterungen) und definieren Sie Erfolgskriterien.

- Setzen Sie einen monatlichen GEO‑Review‑Termin mit klaren DOR/DOD‑Standards und einem Update‑Backlog auf.

Wenn Sie die Messung und das Multi‑Engine‑Monitoring nicht manuell pflegen möchten, hilft Geneo beim zentralen Beobachten von Zitierungen, Sentiment und Engine‑Abdeckung – inklusive historischer Vergleiche und Arbeitslisten für die nächsten Iterationen.