12 wichtige GEO-Deliverables, die Kund:innen 2025 erwarten

Erfahren Sie die 12 entscheidenden GEO-Deliverables 2025: Was zählt, wie wird gemessen, worauf sollten Marketing-Teams achten? Jetzt Klarheit sichern!

GEO (Generative Engine Optimization) ist 2025 kein Buzzword mehr, sondern ein Pflichtprogramm für Marken, die in ChatGPT Search, Perplexity, Google AI Overviews (AIO/Gemini) oder Bing Copilot zuverlässig sichtbar und zitierbar sein wollen. Entscheidend ist, dass Deliverables klar definiert, messbar und dokumentiert sind – ansonsten verpuffen Maßnahmen im Tagesgeschäft. Aktuelle deutschsprachige Leitfäden und Testberichte zeigen, wie KI‑Suchoberflächen Antworten zusammenstellen und welche Rolle Struktur, Datenqualität und Evidenz spielen. Praxisnahe Ratgeber zu Google‑KI‑Übersichten (2025) und Vergleichstests zu Google AI, ChatGPT, Perplexity und Copilot (2025) bieten hilfreichen Kontext.

1. GEO/AIO Visibility Audit

Ein Audit bildet die Ausgangsbasis: Wo steht Ihre Marke in generativen Antworten? Welche Inhalte werden zitiert, welche ignoriert?

- Umfang: Plattform‑Mapping (ChatGPT/Perplexity/AIO/Copilot/Gemini), Szenarien (Modus, Sprache, Region), Wettbewerbs‑Benchmarking.

- Prüfpunkte: Mentions vs. Zitationen, Link‑Positionen, Quellenqualität, Intent‑Coverage, Schema‑Status, Crawlability (GPTBot/Bingbot).

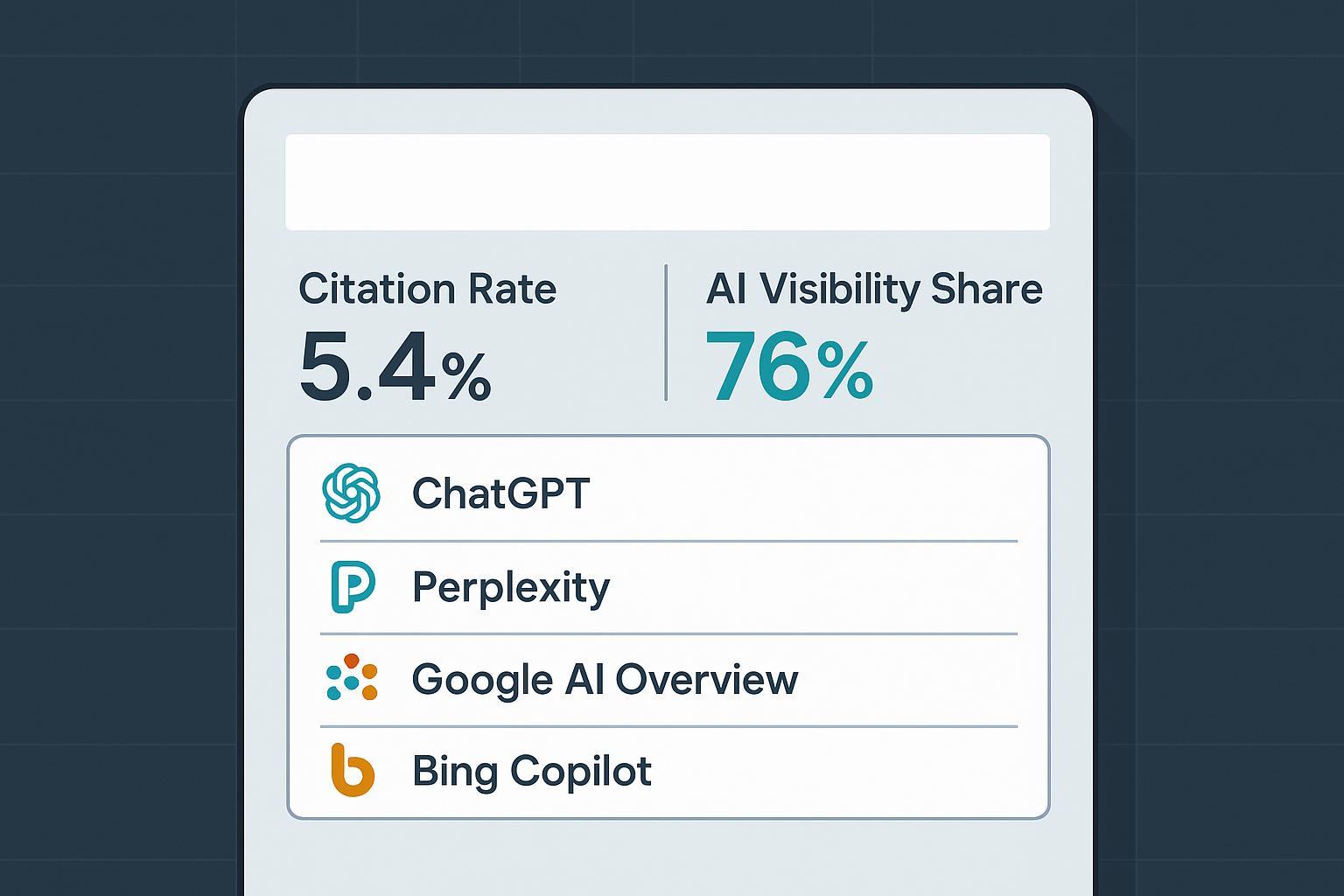

- KPIs und Reporting: AI Mention Rate, Citation Rate, AI Visibility Share, Attribution Quality, Incident‑Logs.

Warum das wichtig ist: Ohne belastbaren Ausgangswert lassen sich Fortschritte nur gefühlt, nicht belegt darstellen. Hinweise zu Messgrenzen und KI‑Sichtbarkeit finden sich in iquals LLMO/GEO‑Überblick (2025).

2. Answer‑ready Content‑Pakete (Q&A/FAQ/TL;DR)

Kund:innen erwarten Inhalte, die Antworten ermöglichen – kurz, präzise, zitierfähig.

- Prinzip: Eine klare Kernantwort in 1–2 Sätzen, ergänzende Kontexte, sichtbare Quellenführung (Autor/Datum/Verlag), FAQ‑Blöcke mit Schema.

- Formate: Q&A‑Snippets (40–60 Wörter), TL;DR‑Abschnitte, Tabellen/Listen zur maschinellen Extraktion.

- Tests: Wöchentliche Promptsets je Thema, Variantenvergleich, Tracking der Zitierhäufigkeit.

Ein solider Rahmen für die Rolle von KI‑Suchmaschinen und AIO ist der KI‑Suchmaschinen‑Ratgeber (2025).

3. Strukturierte Daten & Datenbereitstellung

GEO funktioniert besser, wenn Fakten maschinenlesbar sind.

- Umsetzung: JSON‑LD für Article/FAQ/HowTo/Organization/Dataset, konsistente Entitäten, valide Markup‑Tests.

- Datenquellen: Produktdaten, Studien, Glossare; optional Feeds/APIs für aktualisierbare Fakten.

- Praxisnote: llms.txt ist 2025 experimentell; fokussieren Sie auf sauberes HTML und Schema. Ein deutschsprachiger Überblick beschreibt Schema‑Arten und Einsatzfälle (2025).

4. Technische Optimierungen für KI‑Parsing

Ohne technische Hygiene verpufft gutes Content‑Packaging.

- Crawler‑Steuerung: robots.txt und Header so konfigurieren, dass GPTBot/Bingbot zugreifen dürfen; Logfile‑Analyse regelmäßig.

- Performance: Core Web Vitals, SSR/CSR‑Hybrid, semantisches HTML, saubere Statuscodes.

- Internationalisierung: Canonicals/hreflang korrekt, mobile UX zuverlässig.

Zur Relevanz von GPTBot in Deutschland 2025 berichtet SEO‑Südwest: Crawler‑Statistiken mit GPTBot unter den Top‑Bots.

5. Evidenzbindung & E‑E‑A‑T‑Hygiene

Kund:innen erwarten nachvollziehbare, überprüfbare Inhalte.

- Transparenz: Autor:innenbio, Methodenfenster, Datumsangaben, Quellvielfalt mit Primärquellen.

- Kennzeichnungen: COI/Affiliate‑Hinweise, KI‑Nutzung „human‑reviewed“, klare Werbungstrennung.

- Schema‑Signale: Person, Organization, Article; optional ClaimReview/Speakable je nach Inhalt.

Ein aktueller deutschsprachiger Leitfaden fasst E‑E‑A‑T 2025 zusammen: SEOagentur.de: E‑E‑A‑T Leitfaden (2025).

6. Monitoring & Reporting (GEO‑spezifische KPIs)

Ohne Monitoring bleibt GEO blind. Erwarten Sie Dashboards, die KI‑Sichtbarkeit und Zitationsqualität greifbar machen.

- Kernmetriken: Citation Rate, Mention Rate, AI Visibility Share vs. Wettbewerb, Answer Accuracy Error Rate, Time‑to‑Recognition.

- Visualisierung: Zeitreihen, Competitor‑Share, Accuracy‑Funnel, Attribution‑Tabellen.

- Grenzen: AIO wird in GSC nicht isoliert ausgewiesen; Messung erfolgt über Sampling und Proxy‑Indikatoren.

Deloitte Deutschland skizziert 2025, wie AI Visibility messbar gemacht werden kann.

Disclosure: Geneo ist unser Produkt. Geneo bietet plattformübergreifendes Monitoring (ChatGPT/Perplexity/AIO), Sentiment‑Analyse, historische Query‑Verläufe und Content‑Hinweise – Details auf geneo.app. Zur Begriffsklärung und Metriken empfehlen wir die Grundlagen zu AI Visibility.

7. Iterative Tests & LLMO‑Metriken‑Validierung

Tests sind der Motor für Fortschritt – systematisch, versioniert, mit klaren Qualitätskriterien.

- Vorgehen: Prompt‑Korpus pro Intent/Locale, Kontroll‑ und Stress‑Prompts, Versionierung/Metadaten.

- Bewertung: Accuracy (Faktenkonsistenz), Relevance (semantische Passung), Personalization (Uplift) – ergänzt um Human Review.

- Pipeline: Logging, Scoring‑Services, Alerts, A/B‑Vergleiche.

Methoden und Metriken kompakt im LLMO‑Metriken‑Guide (2025).

8. Thought Leadership & Off‑page‑Signale

Autorität entsteht nicht nur on‑site. Kund:innen erwarten Off‑page‑Signale, die LLMs vertrauen lassen.

- Maßnahmen: Originäre Studien/Whitepaper mit Methodenfenster, maschinenlesbare Metadaten (HTML+PDF+Schema), gezielte PR in Fachmedien.

- Social Proof: LinkedIn‑Team‑Branding, Datenthreads, klare Visuals.

- KPIs: Externe Zitationen, Downloads/Zitate, Engagement‑Raten.

Best Practices zu LinkedIn‑Branding im Kontext KI‑Sichtbarkeit: LinkedIn Team Branding (2025).

9. Plattform‑spezifische Anpassungen (ChatGPT, Perplexity, AIO/Gemini, Copilot)

Nicht jede Plattform „liest“ gleich. Erwartet werden Maßnahmen, die Unterschiede berücksichtigen.

- Perplexity: citation‑first; strukturierte Zitate sind sichtbar – geeignet für faktenbasierte Inhalte.

- ChatGPT Search: dialogorientiert; kurze Snippets und TL;DR funktionieren oft besser.

- Google AIO/Gemini: stützt sich stark auf das Google‑Ökosystem; strukturierte Daten und Entitäten zahlen sich aus.

- Bing Copilot: mischt KI‑Antworten und klassische Links; Tabellen/FAQ‑Formate performen oft gut.

Vergleichende Einblicke liefert der oben zitierte KI‑Suchmaschinen‑Ratgeber; zusätzlich bietet unser Überblick ChatGPT vs. Perplexity vs. Gemini vs. Bing praxisnahe Hinweise.

10. Governance, Richtlinien & Risiko‑Management

GEO braucht Spielregeln – für Transparenz und Fehlerresistenz.

- Richtlinien: COI‑/Affiliate‑Offenlegung, Kennzeichnung von Werbung, YMYL‑Standards mit Fachreview.

- Prozesse: Redaktions‑Checklisten (Fakten, Quellen, rechtlich), Änderungsprotokolle, Incident Response mit Schweregrad.

- Monitoring: Gezielte Nachtests nach Anpassungen, öffentliche Korrekturhinweise, regelmäßige Audits.

Aktuelle Diskussionsbeiträge zum Einfluss von KI‑Modi auf SEO und Vertrauenssignale: BigData‑Insider (2025).

11. Training & Enablement Workshops

Teams müssen befähigt werden, GEO „im Alltag“ zu liefern.

- Formate: Awareness‑Sessions, Hands‑on‑Workshops (Halb-/Ganztag), modulare Inhouse‑Trainings mit Playbooks und Office Hours.

- Inhalte: Funktionsweise KI‑Suche, Intent/Prompt‑Mapping, Answer Pages/Evidence, Schema/Technik, Off‑page/PR, Monitoring/KPIs, Governance.

- Ergebnisse: Gemeinsame Sprache, Checklisten, klare Verantwortlichkeiten.

Anbieter in DACH 2025 beschreiben entsprechende Programme, z. B. AccuraCast GEO‑Workshop (2025).

12. Pricing, Timelines & SLAs

Transparente Rahmen bieten Sicherheit – auch wenn Plattformen dynamisch sind.

- Typische Modelle: Audits (einmalig, 1–6 Wochen). Orientierung: Quick‑Audit ab ca. 500–2.000 €, Standard‑Audit ab ca. 3.000–12.000 €, Enterprise/Deep ab ca. 15.000 € (Änderungen vorbehalten). Retainer für laufende Optimierung; Workshops separat (Halbtag ab ca. 400–1.200 €, Ganztag ab ca. 900–3.500 €, Änderungen vorbehalten).

- SLAs: Reaktionszeiten für Incidents, Reporting‑Frequenz, klar formulierte KPI‑Ziele (z. B. +X% Citation Rate in 6 Monaten; Änderungen vorbehalten).

- Erwartungsmanagement: Attribution zu klassischem Traffic bleibt eingeschränkt; arbeiten Sie mit Proxy‑Metriken und sauberen Methodenfenstern.

Beispiel‑KPIs und typische Nachweise

| KPI | Definition | Beispiel‑Nachweis |

|---|---|---|

| Citation Rate | Anteil der Antworten mit direkter Quelle/Zitation Ihrer Domain | Wöchentliche Stichproben aus ChatGPT/Perplexity, Screenshot‑Archiv |

| AI Visibility Share | Sichtbarkeitsanteil Ihrer Marke vs. Wettbewerb in generativen Antworten | Dashboard mit Query‑Clustern und Plattform‑Filter |

| Answer Accuracy Error Rate | Anteil fehlerhafter Aussagen über Ihre Marke | Incident‑Log mit Korrekturmaßnahmen |

| Time‑to‑Recognition | Zeit bis zur ersten stabilen Erwähnung/Zitation nach Publikation | Zeitreihe zwischen Release und erstem Auftreten |

Zusammenarbeit praktikabel gestalten

Setzen Sie GEO als kontinuierlichen Zyklus auf: Audit → Produktion → Technik → Monitoring → Tests → Off‑page → Governance → Enablement. So bleibt Ihr Programm robust, auch wenn Plattformen neue Funktionen einführen. Wenn Sie Monitoring, Zitations‑KPIs und Plattformunterschiede sauber abdecken wollen, lohnt sich ein Blick auf spezialisierte Lösungen. Geneo unterstützt Teams bei plattformübergreifendem Tracking und Content‑Hinweisen – Details finden Sie auf geneo.app.

Zur Vertiefung: unser Überblick zu Google AI Overview‑Tracking‑Tools (2025).